Pytanie 1

Polecenie Gpresult

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Polecenie Gpresult

W celu konserwacji elementów z łożyskami oraz ślizgami w urządzeniach peryferyjnych wykorzystuje się

Topologia fizyczna sieci, w której wykorzystywane są fale radiowe jako medium transmisyjne, nosi nazwę topologii

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

Aby zapewnić łączność urządzenia mobilnego z komputerem za pośrednictwem interfejsu Bluetooth, konieczne jest

W systemie Windows przypadkowo usunięto konto użytkownika, ale katalog domowy pozostał. Czy możliwe jest odzyskanie niezaszyfrowanych danych z katalogu domowego tego użytkownika?

Włączenie systemu Windows w trybie diagnostycznym umożliwia

W topologii elementem centralnym jest switch

Podczas monitorowania aktywności sieciowej zauważono, że na adres serwera przesyłano tysiące zapytań DNS w każdej sekundzie z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego był atak typu

Jaka liczba hostów może być zaadresowana w podsieci z adresem 192.168.10.0/25?

Jaką kwotę łącznie pochłonie robocizna związana z montażem 20 modułów RJ45 z krawędziowym złączem narzędziowym na przewodach 4-parowych, jeśli stawka godzinowa montera wynosi 15 zł/h, a według tabeli KNR czas montażu pojedynczego modułu to 0,10 r-g?

Która z podanych właściwości kabla koncentrycznego RG-58 sprawia, że obecnie nie jest on używany do tworzenia lokalnych sieci komputerowych?

Protokół poczty elektronicznej, który umożliwia zarządzanie wieloma skrzynkami pocztowymi oraz pobieranie i manipulowanie na wiadomościach przechowywanych na zdalnym serwerze, to

Protokół transportowy bez połączenia w modelu ISO/OSI to

Wskaź na zakres adresów IP klasy A, który jest przeznaczony do prywatnej adresacji w sieciach komputerowych?

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalatora w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

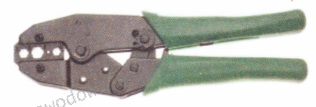

Do jakiego typu wtyków przeznaczona jest zaciskarka pokazana na ilustracji?

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

Jakie jest zadanie programu Wireshark?

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Autorskie prawo osobiste twórcy do programu komputerowego

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

W systemie Linux zarządzanie parametrami transmisji w sieciach bezprzewodowych jest możliwe dzięki

Jakiej kategorii skrętka pozwala na przesył danych w zakresie częstotliwości nieprzekraczającym 100 MHz przy szybkości do 1 Gb/s?

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Liczbie 16 bitowej 0011110010101110 wyrażonej w systemie binarnym odpowiada w systemie szesnastkowym liczba

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Podczas pracy komputera nastąpił samoczynny twardy reset. Przyczyną resetu najprawdopodobniej jest

Jakie narzędzie służy do delikatnego wyginania blachy obudowy komputera oraz przykręcania śruby montażowej w miejscach trudno dostępnych?

Zidentyfikuj urządzenie przedstawione na ilustracji

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Pamięć, która nie traci danych, może być elektrycznie kasowana i programowana, znana jest pod skrótem

Jakim adresem IPv6 charakteryzuje się autokonfiguracja łącza?