Pytanie 1

Przy pomocy testów statycznych okablowania można zidentyfikować

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Przy pomocy testów statycznych okablowania można zidentyfikować

Która czynność nie służy do personalizacji systemu operacyjnego Windows?

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

System S.M.A.R.T. jest używany do nadzorowania funkcjonowania i identyfikowania problemów

Termin określający zdolność do rozbudowy sieci to

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Mimo to po uruchomieniu systemu w standardowym trybie klawiatura funkcjonuje prawidłowo. Co to oznacza?

Program antywirusowy oferowany przez Microsoft bezpłatnie dla posiadaczy legalnych wersji systemu operacyjnego Windows to

Jakie polecenie w systemie Windows dedykowane dla stacji roboczej, umożliwia skonfigurowanie wymagań dotyczących logowania dla wszystkich użytkowników tej stacji roboczej?

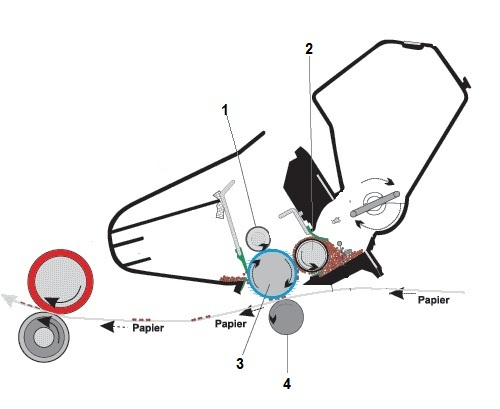

Na przedstawionym schemacie drukarki laserowej wałek światłoczuły oznaczono numerem

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

Który z protokołów w systemach operacyjnych Linux jest używany w sieciach lokalnych?

W dokumentacji technicznej efektywność głośnika podłączonego do komputera wyraża się w jednostce

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

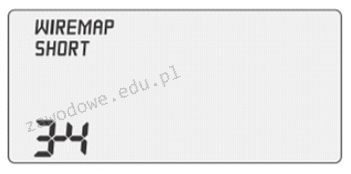

Na ilustracji pokazano wynik pomiaru okablowania. Jaką interpretację można nadać temu wynikowi?

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Na nowym urządzeniu komputerowym program antywirusowy powinien zostać zainstalowany

W doborze zasilacza do komputera kluczowe znaczenie

Jakie polecenie w systemach z rodziny Windows Server umożliwia administratorowi przekierowanie komputerów do określonej jednostki organizacyjnej w ramach usług katalogowych?

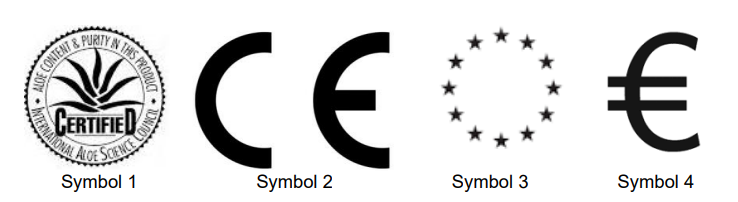

Jakim symbolem powinien być oznaczony sprzęt komputerowy, aby spełniał wymogi prawne konieczne do sprzedaży w Unii Europejskiej?

Jakie oprogramowanie należy zainstalować, aby serwer Windows mógł obsługiwać usługi katalogowe?

Jaką rolę pełni serwer FTP?

Który z protokołów należy do warstwy transportowej, działa bez nawiązywania połączenia i nie posiada mechanizmów weryfikujących poprawność dostarczania danych?

Wskaż zewnętrzny protokół rutingu?

Jaki protokół jest używany przez komendę ping?

W przypadku drukarki igłowej, jaki materiał eksploatacyjny jest używany?

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Aby podłączyć drukarkę z portem równoległym do komputera, który dysponuje jedynie złączami USB, konieczne jest zainstalowanie adaptera

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Jak nazywa się licencja oprogramowania, która pozwala na bezpłatne rozpowszechnianie aplikacji?

Aby sprawdzić minimalny czas ważności hasła w systemie Windows, stosuje się polecenie

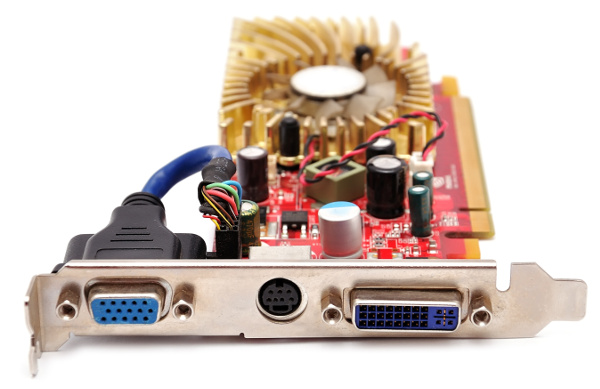

Podczas wymiany uszkodzonej karty graficznej, która współpracowała z monitorem posiadającym jedynie wejście analogowe, jaką kartę należy wybrać?

Aby podłączyć kartę sieciową przedstawioną na rysunku do laptopa, urządzenie musi być wyposażone w odpowiednie gniazdo

Zgodnie z normą EIA/TIA T568B, żyły pary odbiorczej w skrętce są pokryte izolatorem w kolorze

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Możliwość odzyskania listy kontaktów z telefonu komórkowego działającego na systemie Android występuje, gdy użytkownik wcześniej przeprowadził synchronizację danych urządzenia z Google Drive przy użyciu

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Na przedstawionej fotografii karta graficzna ma widoczne złącza

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

Jakie urządzenie powinno być użyte do podłączenia żył kablowych skrętki do gniazda Ethernet?