Pytanie 1

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

W sieci o adresie 192.168.20.0 użyto maski podsieci 255.255.255.248. Jak wiele adresów IP będzie dostępnych dla urządzeń?

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Po wykonaniu podanego skryptu

| echo off |

| echo ola.txt >> ala.txt |

| pause |

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Z jakiej puli adresowej usługa APIPA przypisuje adres IP dla komputera z systemem Windows, jeśli w sieci nie funkcjonuje serwer DHCP?

Jakie polecenie systemu Windows przedstawione jest na ilustracji?

Adres fizyczny Nazwa transportu

===========================================================

00-23-AE-09-47-CF Nośnik rozłączony

00-23-4D-CB-B4-BB Brak

00-23-4D-CB-B4-BB Nośnik rozłączonyJak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?

Który z protokołów umożliwia szyfrowane połączenia?

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

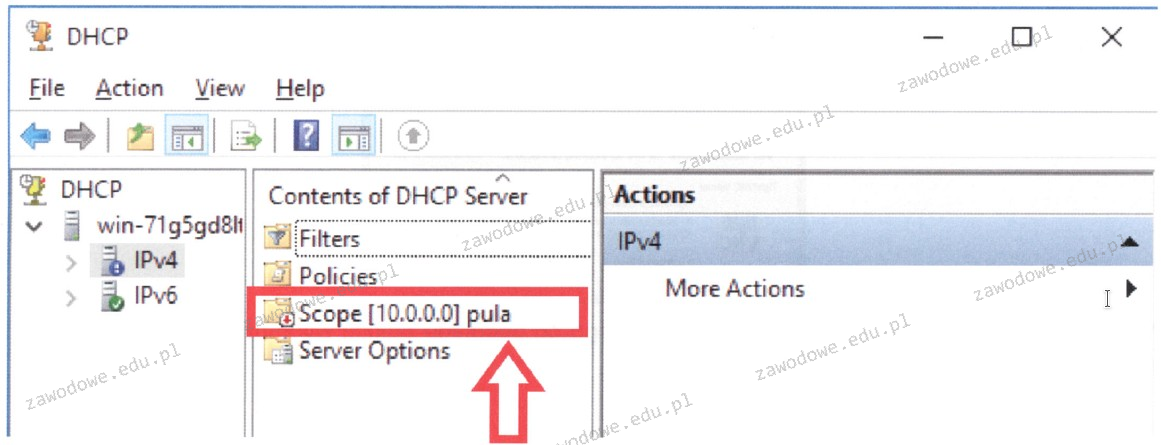

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

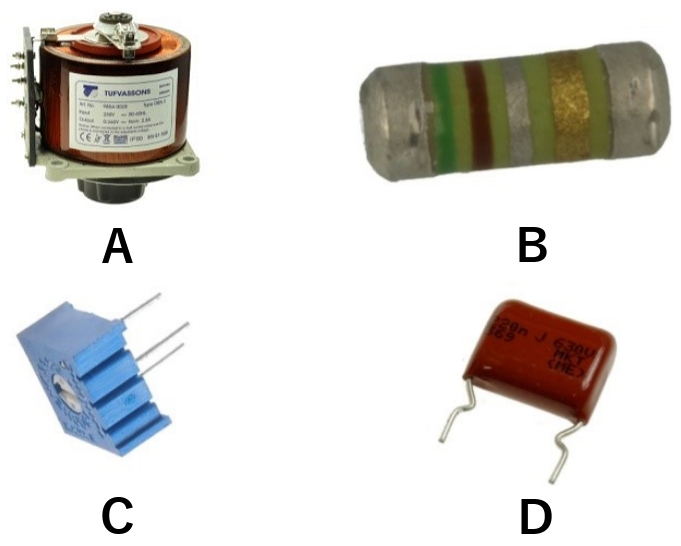

Wskaż ilustrację przedstawiającą kondensator stały?

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

W dokumentacji powykonawczej dotyczącej fizycznej i logicznej struktury sieci lokalnej powinien znajdować się

Pojemność pamięci 100 GiB odpowiada zapisowi

Użytkownik systemu Windows może korzystając z programu Cipher

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

Jaki jest poprawny adres podsieci po odjęciu 4 bitów od części hosta w adresie klasowym 192.168.1.0?

Brak odpowiedzi na to pytanie.

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?

Jakie oprogramowanie powinno być zainstalowane, aby umożliwić skanowanie tekstu z drukowanego dokumentu do edytora tekstu?

Brak odpowiedzi na to pytanie.

Na stronie wydrukowanej przez drukarkę laserową występują jaśniejsze i ciemniejsze fragmenty. W celu usunięcia problemów z jakością oraz nieciągłościami w wydruku, należy

W jakiej topologii sieci komputerowej każdy komputer jest połączony z dokładnie dwoma innymi komputerami, bez żadnych dodatkowych urządzeń aktywnych?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Która z anten cechuje się najwyższym zyskiem mocy i pozwala na nawiązanie łączności na dużą odległość?

Jakim skrótem określa się połączenia typu punkt-punkt w ramach publicznej infrastruktury telekomunikacyjnej?

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Jakie narzędzie należy zastosować w systemie Windows, aby skonfigurować właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę?

Jak w systemie Windows zmienić port drukarki, która została zainstalowana?

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć

Jaki typ routingu jest najbardziej odpowiedni w złożonych, szybko ewoluujących sieciach?

Jakie medium transmisyjne gwarantuje izolację galwaniczną pomiędzy systemami przesyłu danych?

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

Ustal rozmiar klastra na podstawie zamieszczonego fragmentu komunikatu systemu WINDOWS, który pojawia się po zakończeniu działania programu format a:

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

Który z komponentów nie jest zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- maks. 32 GB, 1 x D-SUB, 1x DVI-D, ATX?