Pytanie 1

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

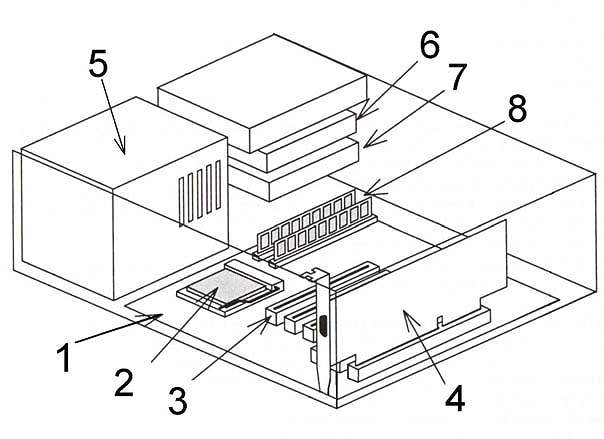

Na ilustracji karta rozszerzeń jest oznaczona numerem

Aby wyświetlić informacje o systemie Linux w terminalu, jakie polecenie należy wprowadzić?

Linux egeg-deeesktop 4.8.0-36-generic #36~16.04.1-Ubuntu SMP Sun Feb 5 09:39:41 UTC 2017 i686 i686 i686 GNU/Linux

Uruchomienie systemu Windows jest niemożliwe z powodu awarii oprogramowania. W celu przeprowadzenia jak najmniej inwazyjnej diagnostyki i usunięcia tej usterki, zaleca się

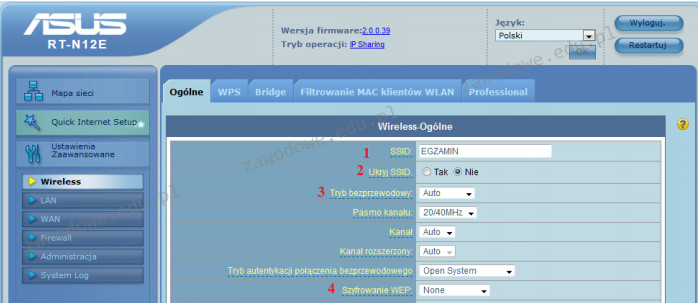

Aby zatuszować identyfikator sieci bezprzewodowej, należy zmodyfikować jego ustawienia w ruterze w polu oznaczonym numerem

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Element drukujący, składający się z wielu dysz połączonych z mechanizmem drukującym, znajduje zastosowanie w drukarce

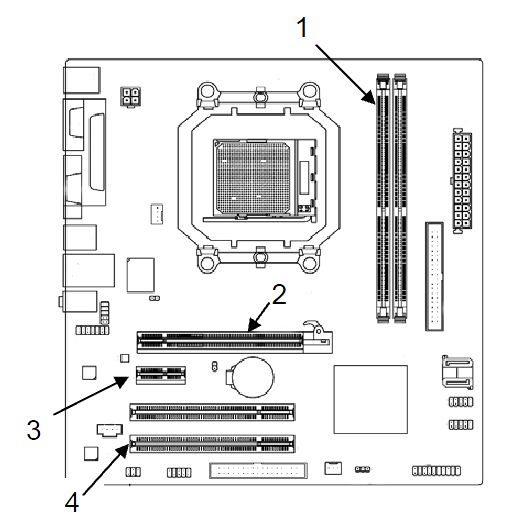

Na schemacie płyty głównej, gdzie można zamontować moduły pamięci RAM, gniazdo oznaczone cyfrą to

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Jakie polecenie w systemie Windows pozwala na wyświetlenie tabeli routingu hosta?

W systemie Windows, który obsługuje przydziały dyskowe, użytkownik o nazwie Gość

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu ustawienia kolejności uruchamiania systemów operacyjnych, konieczna jest modyfikacja zawartości

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

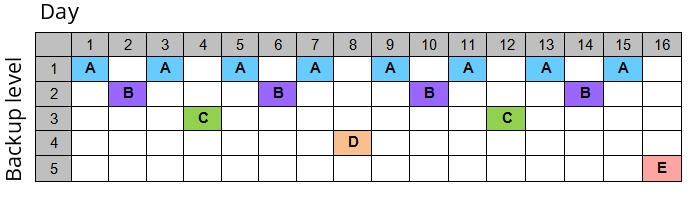

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Aby zrealizować iloczyn logiczny z uwzględnieniem negacji, jaki funktor powinno się zastosować?

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Fizyczna architektura sieci, inaczej określana jako topologia fizyczna sieci komputerowych, definiuje

Oprogramowanie, które wymaga zatwierdzenia na wyświetlanie reklam lub zakupu pełnej licencji, aby usunąć reklamy, jest dystrybuowane na licencji

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

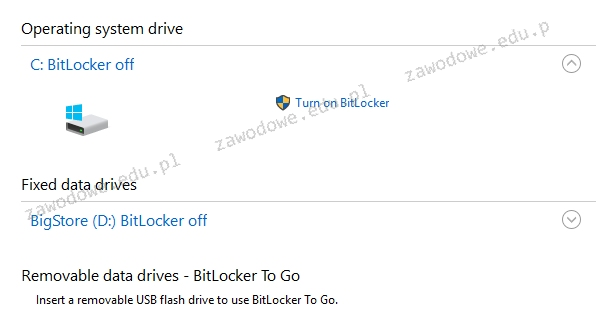

Prezentowane wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate jest przeznaczone do

Aby stworzyć las w strukturze katalogowej AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Jakie medium transmisyjne stosują myszki bluetooth do łączności z komputerem?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Wynikiem poprawnego pomnożenia dwóch liczb binarnych 111001102 oraz 000111102 jest wartość

Moc zasilacza wynosi 450 W, co oznacza, że

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

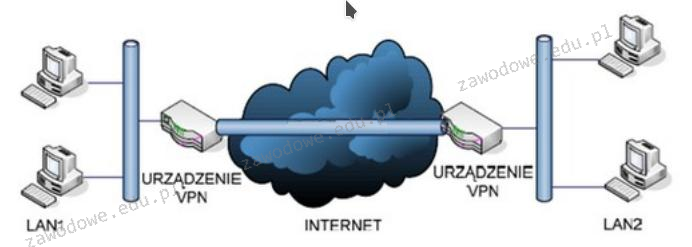

Schemat ilustruje zasadę funkcjonowania sieci VPN o nazwie

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

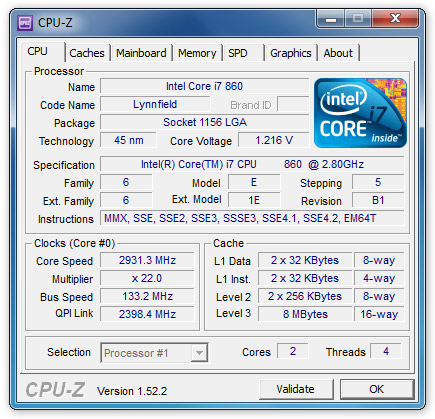

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

Aby przeprowadzić diagnozę systemu operacyjnego Windows oraz stworzyć plik z listą wszystkich ładujących się sterowników, konieczne jest uruchomienie systemu w trybie

Na ilustracji przedstawiono ustawienie karty sieciowej, której adres MAC wynosi

Ethernet adapter VirtualBox Host-Only Network:

Connection-specific DNS Suffix . :

Description . . . . . . . . . . . : VirtualBox Host-Only Ethernet Adapter

Physical Address. . . . . . . . . : 0A-00-27-00-00-07

DHCP Enabled. . . . . . . . . . . : No

Autoconfiguration Enabled . . . . : Yes

Link-local IPv6 Address . . . . . : fe80::e890:be2b:4c6c:5aa9%7(Preferred)

IPv4 Address. . . . . . . . . . . : 192.168.56.1(Preferred)

Subnet Mask . . . . . . . . . . . : 255.255.255.0

Default Gateway . . . . . . . . . :

DHCPv6 IAID . . . . . . . . . . . : 134873127

DHCPv6 Client DUID. . . . . . . . : 00-01-00-01-1F-04-2D-93-00-1F-D0-0C-7B-12

DNS Servers . . . . . . . . . . . : fec0:0:0:ffff::1%1

fec0:0:0:ffff::2%1

fec0:0:0:ffff::3%1

NetBIOS over Tcpip. . . . . . . . : EnabledJakie jest rozgłoszeniowe IP dla urządzenia o adresie 171.25.172.29 z maską 255.255.0.0?

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?

Brak odpowiedzi na to pytanie.

Jaki protokół powinien być ustawiony w switchu sieciowym, aby uniknąć występowania zjawiska broadcast storm?

Brak odpowiedzi na to pytanie.

Na jakich portach brama sieciowa powinna umożliwiać ruch, aby klienci w sieci lokalnej mieli możliwość ściągania plików z serwera FTP?

Brak odpowiedzi na to pytanie.

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Brak odpowiedzi na to pytanie.