Pytanie 1

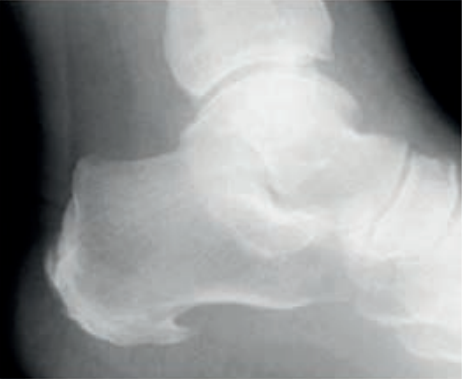

Co zostało uwidocznione na zamieszczonym radiogramie?

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Co zostało uwidocznione na zamieszczonym radiogramie?

Czas połowicznego zaniku jest wykorzystywany

Warstwa półchłonna (WP) służy do obliczania

Podczas badania EEG otwarcie oczu powoduje

Którą metodą i w której płaszczyźnie zostało wykonane badanie stawu kolanowego zobrazowane na zdjęciach?

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

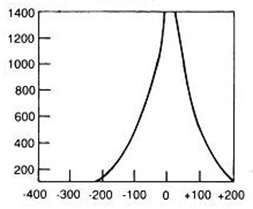

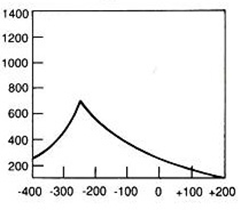

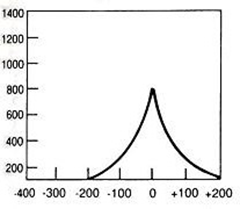

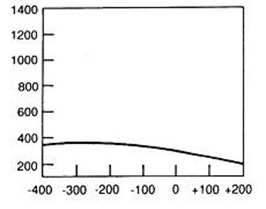

Który wynik badania tympanometrycznego potwierdza, że słuch badanego pacjenta jest w granicach normy?

Jaka jest standardowa odległość OF do wykonania rentgenowskich zdjęć kości i stawów kończyny górnej?

Który radioizotop stosuje się do badania scyntygraficznego kości?

Jaka jest moc dawki pochłoniętej w brachyterapii HDR?

Czym charakteryzuje się późny odczyn popromienny?

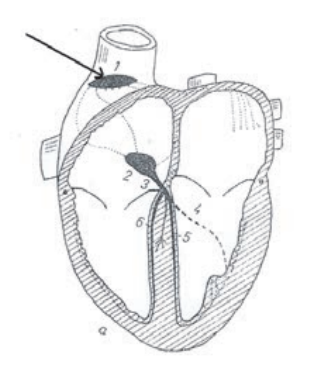

Strzałką na schemacie oznaczono

Pielografia zstępująca umożliwia diagnostykę

Który radioizotop jest stosowany w diagnostyce i terapii raka tarczycy?

W brachyterapii MDR stosowane są dawki promieniowania

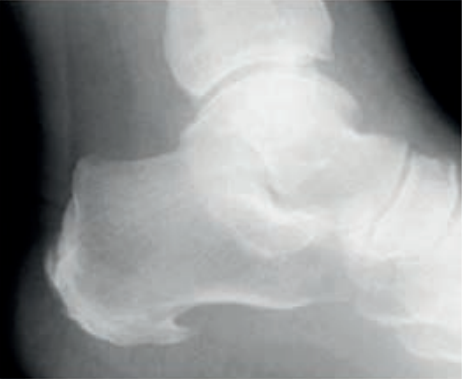

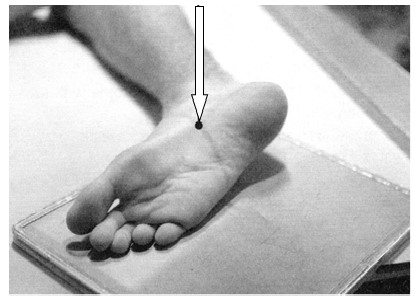

Na radiogramie strzałką oznaczono

Na radiogramie stopy uwidocznione jest złamanie trzonu

Ile razy i jak zmieni się wartość natężenia promieniowania X przy zwiększeniu odległości OF ze 100 cm do 200 cm?

Podczas badania gammakamerą źródłem promieniowania jest

Cholangiografia to badanie radiologiczne

Na ilustracji przedstawiono ułożenie pacjenta do wykonania zdjęcia rentgenowskiego

Na obrazie rezonansu magnetycznego strzałką wskazano patologiczny kręg

W badaniu EEG elektrody referencyjne przymocowane do płatka ucha to

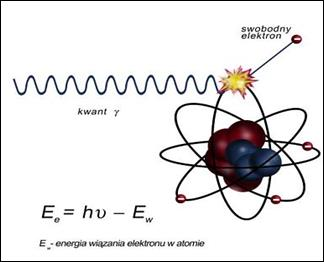

Na ilustracji przedstawiono zjawisko

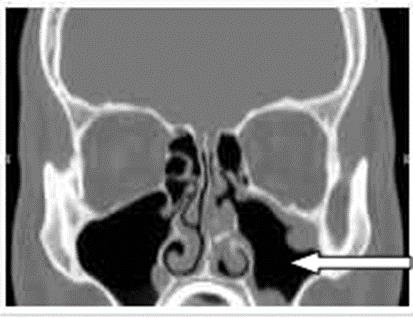

Na zamieszczonym obrazie TK strzałką zaznaczono zatokę

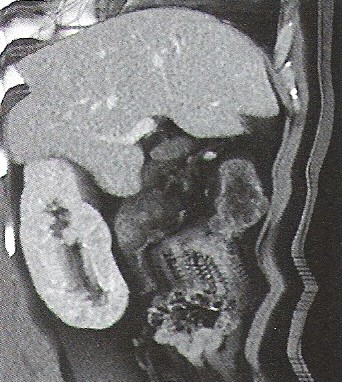

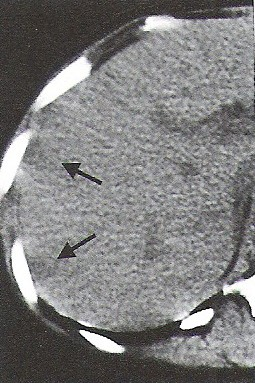

Na którym obrazie TK uwidoczniony jest artefakt spowodowany ruchami oddechowymi pacjenta?

Znak umieszczony w pracowni rezonansu magnetycznego zakazuje wstępu osobom

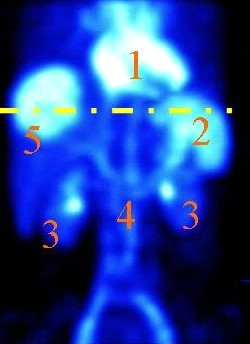

Który narząd na obrazie scyntygrafii znakowanej erytrocytami zaznaczono cyfrą 2?

Który detektor w radiografii wymaga laserowego czytnika obrazu?

Który program wtórnej rekonstrukcji obrazów TK pozwala na odwzorowanie wnętrza jelita grubego, tchawicy i oskrzeli?

Pomiar densytometryczny BMD metodą DXA z kręgosłupa powinien obejmować kręgi

Celem radioterapii paliatywnej nie jest

Więzka promieniowania X to

W scyntygrafii dynamiczne badanie najczęściej rozpoczyna się

Na schemacie oznaczono

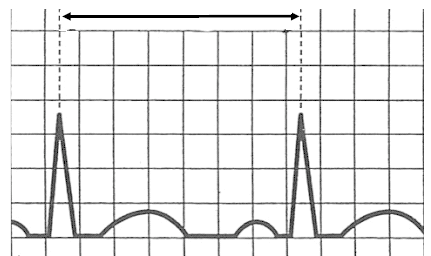

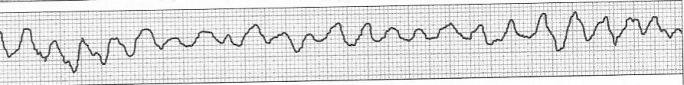

Zamieszczony elektrokardiogram przedstawia

Świeżo wynaczyniona krew na obrazach TK głowy bez podania środka kontrastowego ukazuje się jako obszar

W pozytonowej tomografii emisyjnej PET zostaje zarejestrowane promieniowanie powstające podczas

Chorobą układu oddechowego typu obturacyjnego jest

Na którym obrazie zarejestrowano badanie scyntygraficzne?