Pytanie 1

Transmisję danych w sposób bezprzewodowy umożliwia standard, który zawiera interfejs

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Transmisję danych w sposób bezprzewodowy umożliwia standard, który zawiera interfejs

Ile par przewodów w standardzie 100Base-TX jest używanych do przesyłania danych w obie strony?

SuperPi to aplikacja używana do oceniania

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

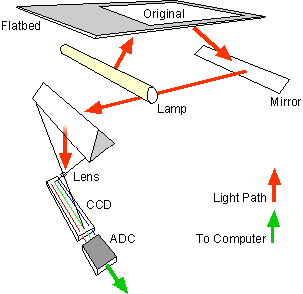

Przedstawiony schemat przedstawia zasadę działania

Z analizy oznaczenia pamięci DDR3 PC3-16000 można wywnioskować, że ta pamięć:

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

SuperPi to aplikacja używana do testowania

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki

Jaką drukarkę powinna nabyć firma, która potrzebuje urządzenia do tworzenia trwałych kodów kreskowych oraz etykiet na folii i tworzywach sztucznych?

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Jakie stwierdzenie o routerach jest poprawne?

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

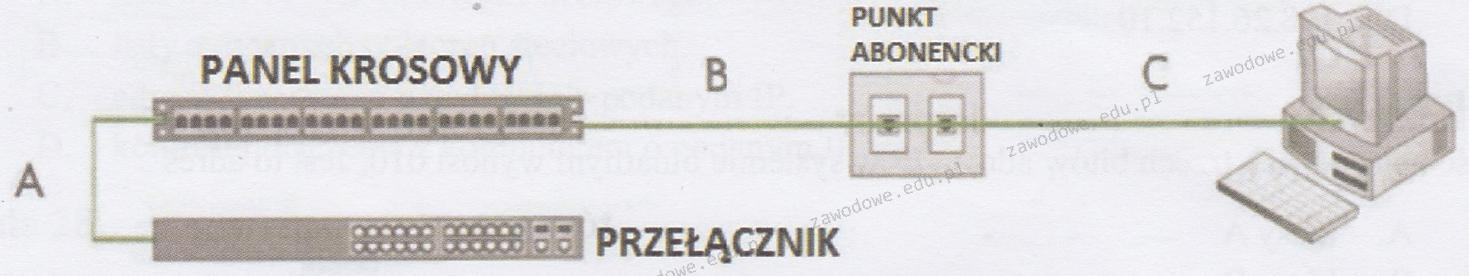

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Aby zapewnić komputerowi otrzymanie konkretnego adresu IP od serwera DHCP, należy na serwerze ustalić

Do bezprzewodowego przesyłania danych pomiędzy dwoma urządzeniami, z wykorzystaniem fal radiowych w paśmie ISM 2,4 GHz, służy interfejs

Jaki jest maksymalny promień zgięcia przy montażu kabla U/UTP kat 5e?

Zgodnie z normą EIA/TIA T568B, żyły pary odbiorczej w skrętce są pokryte izolatorem w kolorze

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Jakie napięcie jest dostarczane przez płytę główną do pamięci typu SDRAM DDR3?

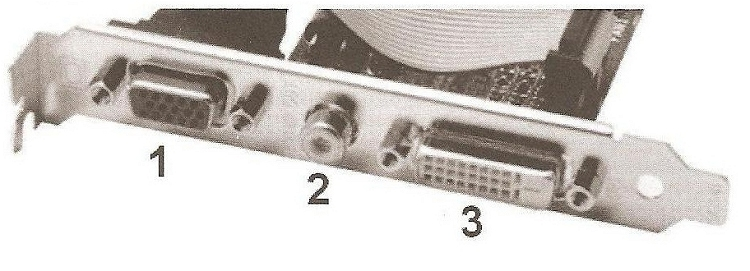

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

Jakie urządzenie stosuje technikę polegającą na wykrywaniu zmian w pojemności elektrycznej podczas manipulacji kursorem na monitorze?

Wartość liczby dziesiętnej 128(d) w systemie heksadecymalnym wyniesie

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Sprzęt, na którym można skonfigurować sieć VLAN, to

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

Co należy zrobić w pierwszej kolejności, gdy dysza w drukarce atramentowej jest zaschnięta z powodu długotrwałych przestojów?

Wtyk przedstawiony na ilustracji powinien być użyty do zakończenia kabli kategorii

Który z materiałów eksploatacyjnych nie jest stosowany w ploterach?

Jak nazywa się standard podstawki procesora bez nóżek?

Użytkownik drukarki samodzielnie i poprawnie napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje się próby drukowania. Co może być przyczyną tej usterki?

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosowany jest mechanizm

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

Termin określający zdolność do rozbudowy sieci to

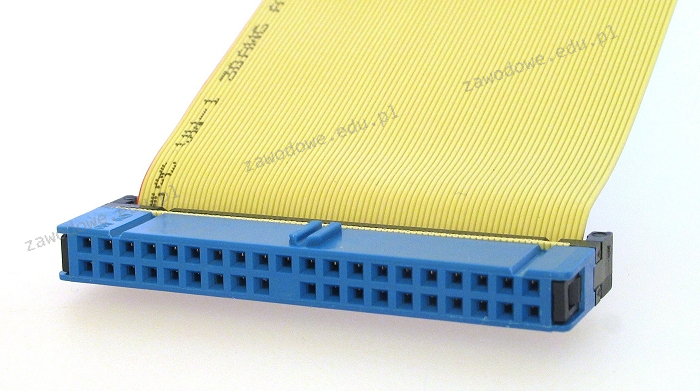

Na ilustracji przedstawiono taśmę (kabel) złącza