Pytanie 1

Jakim materiałem eksploatacyjnym jest ploter solwentowy?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Jakim materiałem eksploatacyjnym jest ploter solwentowy?

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?

Który z protokołów należy do warstwy transportowej, działa bez nawiązywania połączenia i nie posiada mechanizmów weryfikujących poprawność dostarczania danych?

Thunderbolt to interfejs:

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pomocą serwera wydruku w systemie Windows Server. Posiadają oni jedynie uprawnienia do „Zarządzania dokumentami”. Jakie kroki należy podjąć, aby naprawić ten problem?

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i przechowywać o nich informacje w centralnym miejscu, konieczne jest zainstalowanie na serwerze Windows roli

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

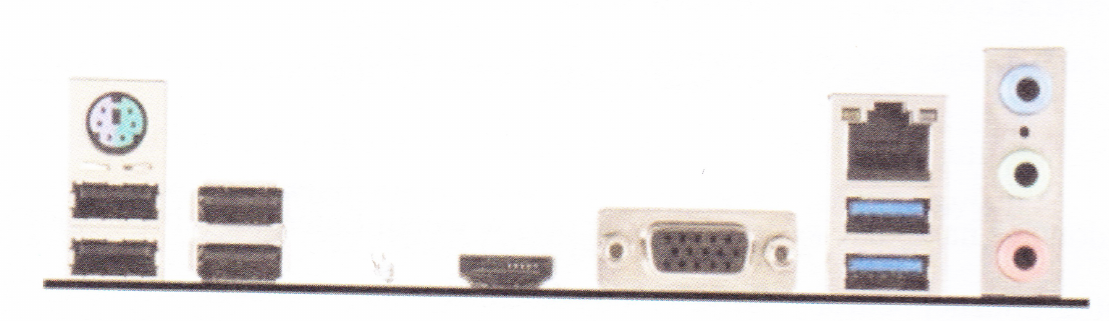

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką normę odnosi się do okablowania strukturalnego?

Wymiana baterii należy do czynności związanych z eksploatacją

W systemie Linux, polecenie usermod -s dla danego użytkownika umożliwia

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Jakie polecenie należy wykorzystać, aby w terminalu pokazać przedstawione informacje o systemie Linux?

Arch Linux 2.6.33-ARCH (myhost) (tty1)

myhost login: root

Password:

[root@myhost ~]#

Linux myhost 2.6.33-ARCH #1 SMP PREEMPT Thu May 13 12:06:25 CEST 2010 i686 Intel

(R) Pentium(R) 4 CPU 2.80GHz GenuineIntel GNU/LinuxKtóre z kont nie jest standardowym w Windows XP?

Jaki instrument służy do określania długości oraz tłumienności kabli miedzianych?

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

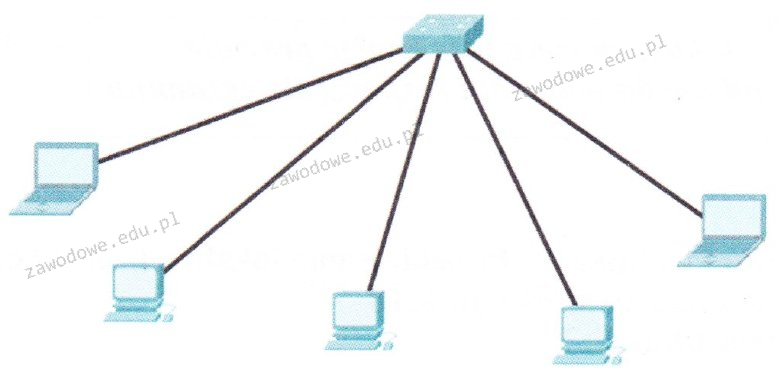

Jaką topologię fizyczną sieci ilustruje zamieszczony rysunek?

Wskaż błędne twierdzenie dotyczące Active Directory?

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Zarządzanie konfiguracją karty sieciowej w systemie Windows 7 realizuje polecenie

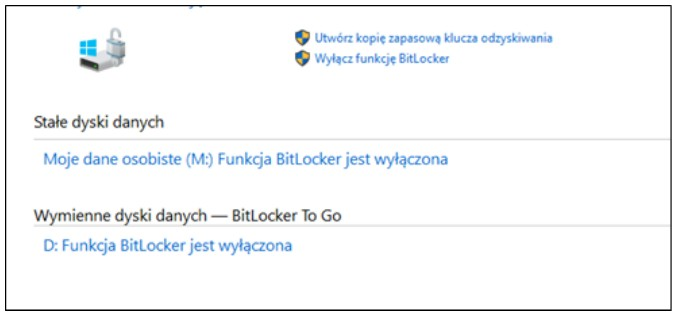

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

Które urządzenie należy wykorzystać do podłączenia urządzenia peryferyjnego, wyposażonego w bezprzewodowy interfejs wykorzystujący do komunikacji fale świetlne w zakresie podczerwieni, z laptopem, który nie ma takiego interfejsu, a ma natomiast interfejs USB?

Jakiego typu kopię zapasową należy wykonać, aby zarchiwizować wszystkie informacje, niezależnie od daty ich ostatniej archiwizacji?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Zainstalowanie serwera WWW w środowisku Windows Server zapewnia rola

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Elementem aktywnym w elektronice jest

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

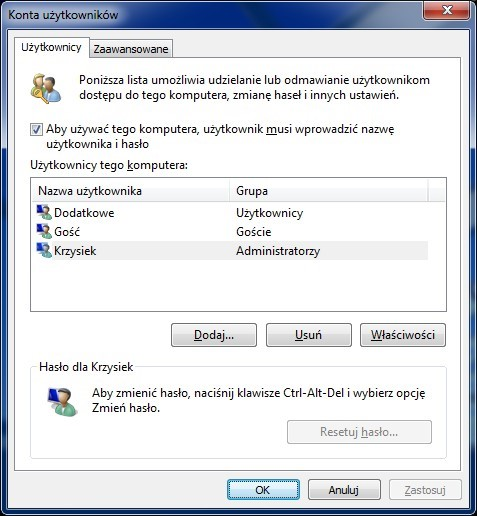

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?