Pytanie 1

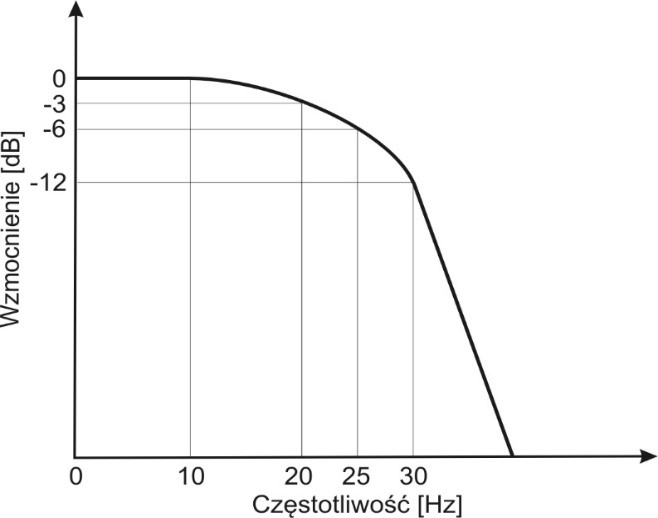

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

W celu przerwania działania funkcji i powrotu do miejsca jej wywołania należy użyć instrukcji

Pojęcie „Architektura Harvardska” odnosi się do

Podczas tworzenia tabeli w bazie danych klucz podstawowy określa się jako

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

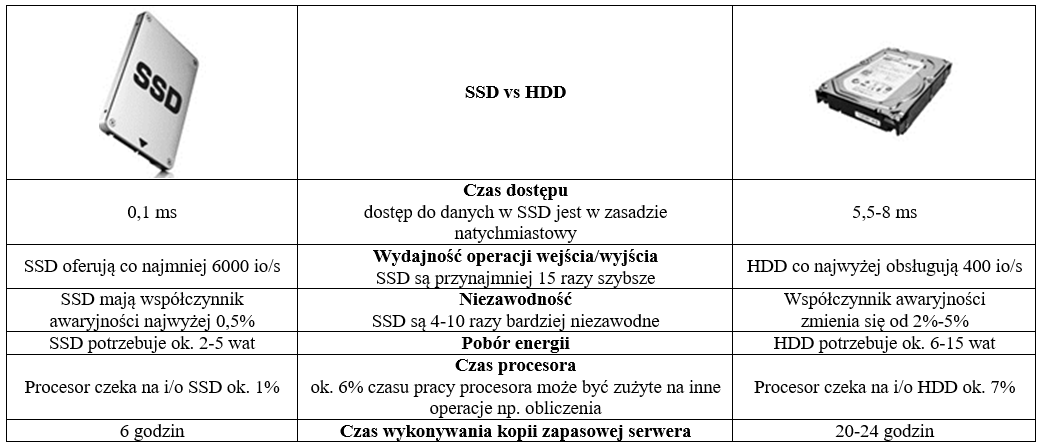

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

Który typ przewodu przedstawiono na rysunku?

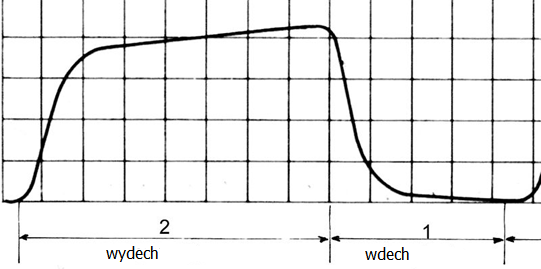

Stężenie którego gazu z wydychanego powietrza prezentuje kapnogram?

Aby zapisać wynik dzielenia dowolnych dwóch liczb różnych od zera, należy użyć zmiennej typu

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Do kruszenia kamieni w pęcherzu moczowym stosowane są fale

Wysłanie obrazów z urządzenia diagnostycznego do serwera PACS odbywa się zgodnie ze standardem

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

W jakim celu stosuje się podział użytkowników na grupy w systemie operacyjnym?

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

Badanie obrazujące fizyczny rozwój płodu wykonywane jest przy użyciu

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

Zaćma fotochemiczna jest wywołana promieniowaniem

Które polecenia są charakterystyczne dla instrukcji iteracyjnych?

Płyta jednostronna dwuwarstwowa DVD pozwala na przechowanie danych o pojemności około

Metoda diagnostyczna, w której rejestruje się rozpad radioizotopu wprowadzonego do organizmu, to

W celu archiwizacji danych w systemie Linux wymagane jest utworzenie archiwum. Korzystając z zamieszczonej w ramce pomocy dobierz odpowiednie polecenie.

| -c, --create | utworzenie nowego archiwum |

| -z, --gzip | filtrowanie archiwum przez gzip |

| -v, --verbose | wypisywanie szczegółów o przetwarzanych plikach |

| -f, --file=ARCHIWUM | użycie pliku lub urządzenia ARCHIWUM |

| -x, --extract | rozpakowanie plików z archiwum |

| -t, --list | wypisanie zawartości archiwum |

| -r, --append | dołączenie plików na końcu archiwum |

| -u, --update | dołączenie tylko plików nowszych niż kopie w archiwum |

Na rysunku przedstawiono badanie za pomocą

Do badania przewodnictwa powietrznego i kostnego służy

Podczas tworzenia bazy danych pacjentów polem unikatowym pełniącym rolę klucza podstawowego jest pole zawierające informacje o

Materiałem eksploatacyjnym w drukarce laserowej jest

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Który przyrząd należy wybrać celem sprawdzenia poprawnej prędkości transmisji danych na łączu RS232 urządzenia elektroniki medycznej?

Które polecenie w systemie Windows tworzy folder Dane?

Technika diagnostyki obrazowej polegająca na badaniu struktur serca i dużych naczyń krwionośnych za pomocą ultradźwięków jest określana skrótem

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?