Pytanie 1

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

Wynik: 37/40 punktów (92,5%)

Wymagane minimum: 20 punktów (50%)

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Według specyfikacji JEDEC standardowe napięcie zasilania modułów RAM DDR3L o niskim napięciu wynosi

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

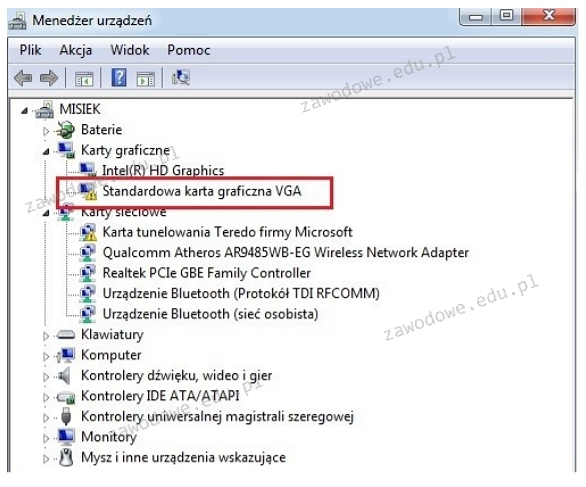

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Liczba 205(10) w zapisie szesnastkowym wynosi

Jakie urządzenie jest kluczowe dla połączenia pięciu komputerów w sieci o strukturze gwiazdy?

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Które z urządzeń może powodować wzrost liczby kolizji pakietów w sieci?

Active Directory w systemach MS Windows Server 2000 oraz MS Windows Server 2003 to

Protokół trasowania wewnętrznego, który wykorzystuje metrykę wektora odległości, to

Poprzez polecenie dxdiag uruchomione w wierszu poleceń Windows można

Norma IEEE 802.11 określa typy sieci

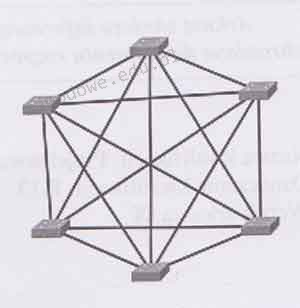

Topologia fizyczna, w której każdy węzeł łączy się z wszystkimi innymi węzłami, to topologia

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

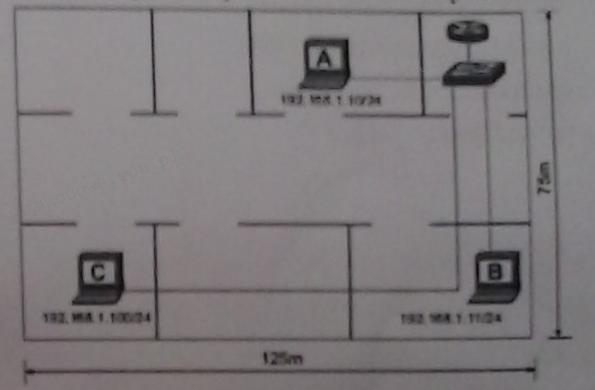

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Fast Ethernet to norma sieci przewodowej, która pozwala na przesył danych z maksymalną szybkością

Kable łączące poziome punkty dystrybucyjne z centralnym punktem dystrybucyjnym określa się jako

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

Najefektywniejszym sposobem dodania skrótu do aplikacji na pulpitach wszystkich użytkowników w domenie będzie

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

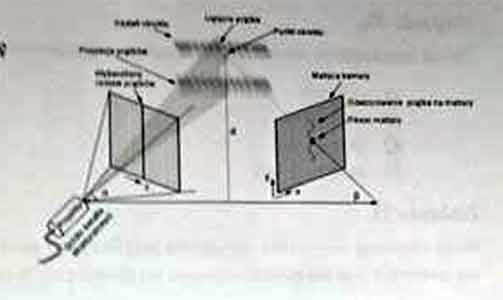

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Do konfiguracji i personalizacji środowiska graficznego GNOME w różnych systemach Linux należy wykorzystać program

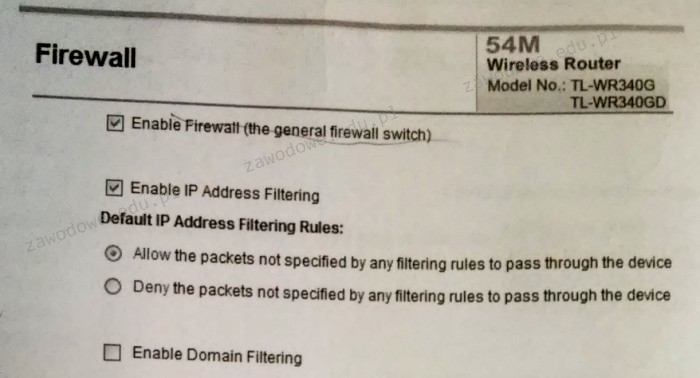

Poniższy rysunek ilustruje ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Jaki wydruk w systemie rodziny Linux uzyskamy po wprowadzeniu komendy

dr-x------ 2 root root 0 lis 28 12:39 .gvfs -rw-rw-r-- 1 root root 361016 lis 8 2012 history.dat -rw-r--r-- 1 root root 97340 lis 28 12:39 .ICEauthority drwxrwxr-x 5 root root 4096 paź 7 2012 .icedtea drwx------ 3 root root 4096 cze 27 18:40 .launchpadlib drwxr-xr-x 3 root root 4096 wrz 2 2012 .local

Aby zrealizować sieć komputerową w pomieszczeniu zastosowano 25 metrów skrętki UTP, 5 gniazd RJ45 oraz odpowiednią ilość wtyków RJ45 niezbędnych do stworzenia 5 kabli połączeniowych typu patchcord. Jaki jest całkowity koszt użytych materiałów do budowy sieci? Ceny jednostkowe stosowanych materiałów można znaleźć w tabeli.

| Materiał | Cena jednostkowa | Koszt |

|---|---|---|

| Skrętka UTP | 1,00 zł/m | 25 zł |

| Gniazdo RJ45 | 5,00 zł/szt. | 25 zł |

| Wtyk RJ45 | 3,00 zł/szt. | 30 zł |

Jakiego rodzaju fizycznej topologii sieci komputerowej dotyczy przedstawiony obrazek?

Kabel typu skrętka, w którym pojedyncza para żył jest pokryta folią, a całość kabla jest osłonięta ekranem z folii i siatki, oznacza się symbolem

Moc zasilacza wynosi 450 W, co oznacza, że

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?