Pytanie 1

Na ilustracji widoczny jest komunikat systemowy. Jaką czynność powinien wykonać użytkownik, aby naprawić występujący błąd?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji widoczny jest komunikat systemowy. Jaką czynność powinien wykonać użytkownik, aby naprawić występujący błąd?

Program firewall nie zapewnia ochrony przed

Serwer WWW o otwartym kodzie źródłowym, który działa na różnych systemach operacyjnych, to

Jaką funkcję pełni serwer ISA w systemie Windows?

Który z poniższych zapisów reprezentuje adres strony internetowej oraz przypisany do niego port?

W drukarce laserowej do stabilizacji druku na papierze używane są

Karta rozszerzeń przedstawiona na ilustracji może być zainstalowana w komputerze, jeśli na płycie głównej znajduje się przynajmniej jeden dostępny slot

Jakie napięcie zasilające mają pamięci DDR2?

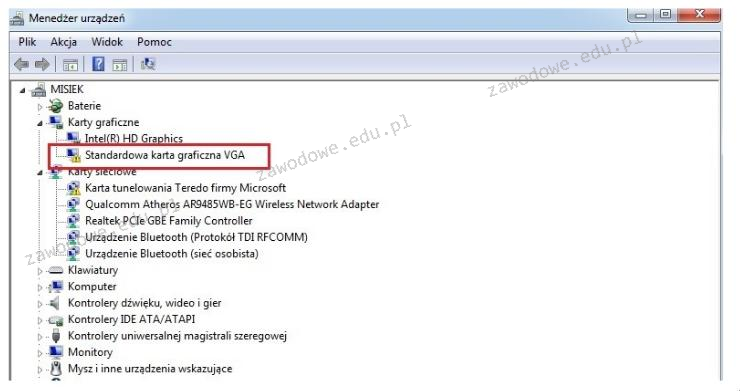

Jakie kroki powinien podjąć użytkownik, aby wyeliminować błąd zaznaczony na rysunku ramką?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie adresy mieszczą się w zakresie klasy C?

Program CHKDSK jest wykorzystywany do

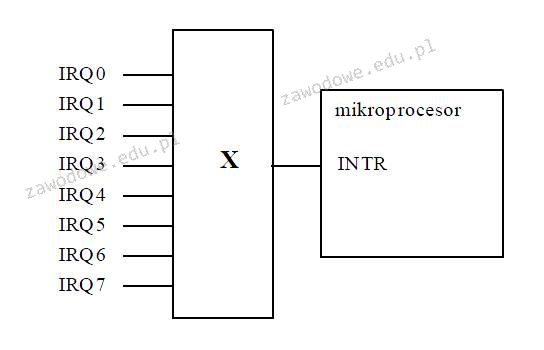

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

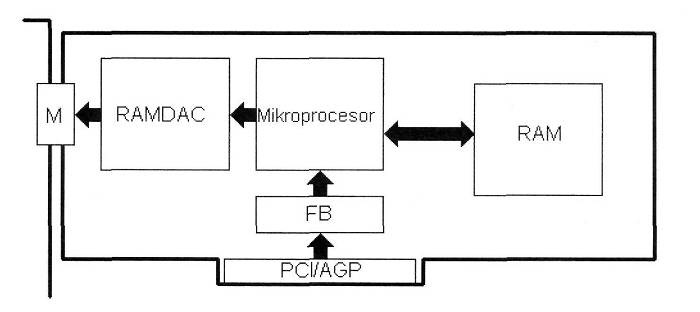

Na schemacie blokowym funkcjonalny blok RAMDAC ilustruje

Jakie są korzyści płynące z użycia systemu plików NTFS?

Osoba odpowiedzialna za zarządzanie siecią komputerową pragnie ustalić, jakie połączenia są aktualnie nawiązywane na komputerze z systemem operacyjnym Windows oraz które porty są wykorzystywane do nasłuchu. W tym celu powinna użyć polecenia

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

Czym charakteryzuje się atak typu hijacking na serwerze sieciowym?

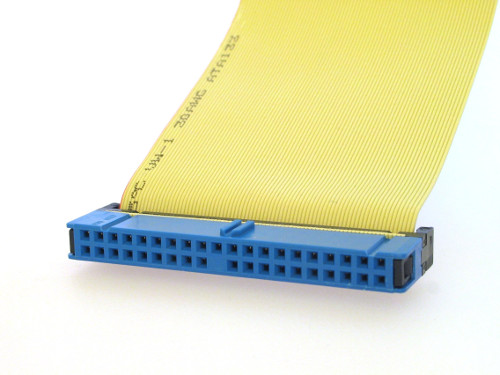

Na ilustracji pokazano wtyczkę taśmy kabel)

Który z interfejsów stanowi port równoległy?

W systemie Linux do obsługi tablic partycji można zastosować komendę

Dane dotyczące błędów w funkcjonowaniu systemu operacyjnego Linux można uzyskać przy użyciu narzędzia

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

Do jakiego celu służy program fsck w systemie Linux?

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Jakie urządzenie powinno się wykorzystać, aby rozszerzyć zasięg sieci bezprzewodowej w obiekcie?

Jakie oprogramowanie jest używane do archiwizacji danych w systemie Linux?

Który z parametrów w poleceniu ipconfig w systemie Windows służy do odnawiania konfiguracji adresów IP?

Brak zabezpieczeń przed utratą danych w wyniku fizycznej awarii jednego z dysków to właściwość

Jakie urządzenie jest kluczowe do połączenia pięciu komputerów w sieci o topologii gwiazdy?

Która z usług odnosi się do centralnego zarządzania tożsamościami, uprawnieniami oraz obiektami w sieci?

Zidentyfikuj urządzenie przedstawione na ilustracji

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

Fast Ethernet to norma sieci przewodowej, która pozwala na przesył danych z maksymalną szybkością

Urządzeniem, które służy do wycinania kształtów oraz grawerowania między innymi w materiałach drewnianych, szklanych i metalowych, jest ploter

Który aplet w panelu sterowania systemu Windows 7 pozwala na ograniczenie czasu korzystania z komputera przez użytkownika?

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Jakim kolorem oznaczona jest izolacja żyły pierwszego pinu wtyku RJ45 w układzie połączeń T568A?