Pytanie 1

Złośliwe programy komputerowe, które potrafią replikować się same i wykorzystują luki w systemie operacyjnym, a także mają zdolność modyfikowania oraz uzupełniania swojej funkcjonalności, nazywamy

Wynik: 34/40 punktów (85,0%)

Wymagane minimum: 20 punktów (50%)

Złośliwe programy komputerowe, które potrafią replikować się same i wykorzystują luki w systemie operacyjnym, a także mają zdolność modyfikowania oraz uzupełniania swojej funkcjonalności, nazywamy

Tworzenie obrazu dysku ma na celu

Ustawa z dnia 14 grudnia 2012 roku dotycząca odpadów zobowiązuje

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że

Oprogramowanie, które jest dodatkiem do systemu Windows i ma na celu ochronę przed oprogramowaniem szpiegującym oraz innymi niechcianymi elementami, to

Jakie oprogramowanie zabezpieczające przed nieautoryzowanym dostępem do sieci powinno być zainstalowane na serwerze, który udostępnia dostęp do internetu?

Narzędzie używane do przechwytywania oraz analizy danych przesyłanych w sieci, to

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Do wykonania obrazu dysku twardego można użyć programu

Jaką funkcjonalność oferuje program tar?

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

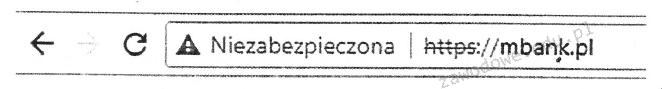

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Który z podanych adresów należy do kategorii publicznych?

Czym jest kopia różnicowa?

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Połączenia typu point-to-point, realizowane za pośrednictwem publicznej infrastruktury telekomunikacyjnej, oznacza się skrótem

Główny księgowy powinien mieć możliwość przywracania zawartości folderów z kopii zapasowej plików. Do jakiej grupy użytkowników w systemie MS Windows XP powinien zostać przypisany?

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Jaki protokół wykorzystuje usługa VPN do hermetyzacji pakietów IP w publicznej sieci?

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

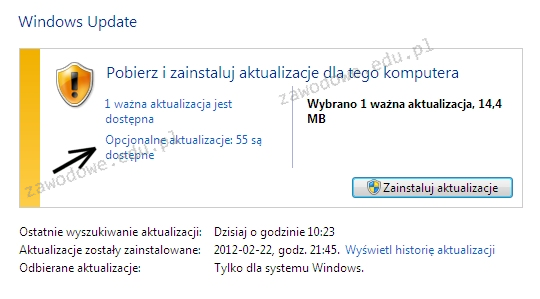

Jeżeli użytkownik zaznaczy opcję wskazaną za pomocą strzałki, będzie miał możliwość instalacji aktualizacji

W systemie Windows 7 narzędzie linii poleceń Cipher.exe jest wykorzystywane do

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Główną metodą ochrony sieci komputerowej przed zagrożeniem z zewnątrz jest zastosowanie

Atak typu hijacking na serwer internetowy charakteryzuje się

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?