Pytanie 1

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Aby uniknąć różnic w kolorystyce pomiędzy zeskanowanymi zdjęciami na wyświetlaczu komputera a ich oryginałami, konieczne jest przeprowadzenie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy:

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Jakie urządzenie wykorzystuje się do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

W projekcie sieci komputerowej przewiduje się użycie fizycznych adresów kart sieciowych. Która warstwa modelu ISO/OSI odnosi się do tych adresów w komunikacji?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Które urządzenie pomiarowe wykorzystuje się do określenia wartości napięcia w zasilaczu?

Jaką maskę domyślną mają adresy IP klasy B?

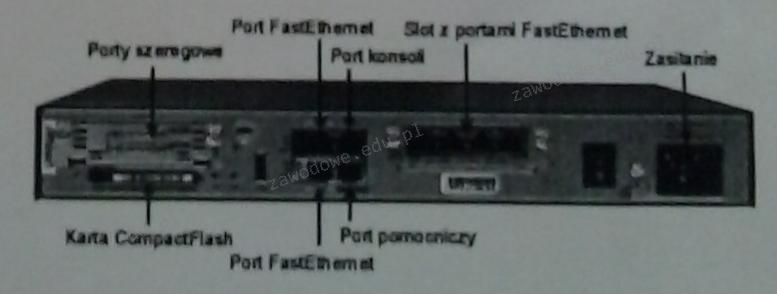

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

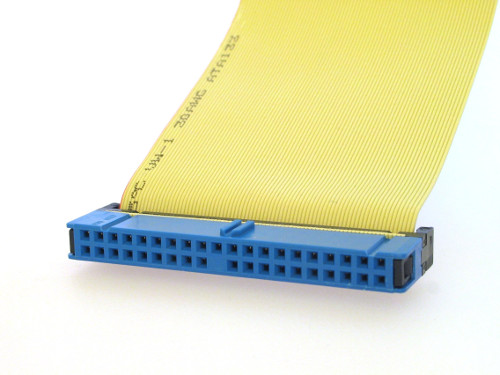

Na ilustracji pokazano wtyczkę taśmy kabel)

Interfejs SLI (ang. Scalable Link Interface) jest używany do łączenia

Główną metodą ochrony sieci komputerowej przed zagrożeniem z zewnątrz jest zastosowanie

Aby bezpiecznie połączyć się z firmowym serwerem przez Internet i mieć dostęp do zasobów firmy, należy wykorzystać odpowiednie oprogramowanie klienckie

Funkcja znana jako: "Pulpit zdalny" standardowo operuje na porcie

Jakim poleceniem w systemie Linux można ustawić powłokę domyślną użytkownika egzamin na sh?

Brak zabezpieczeń przed utratą danych w wyniku fizycznej awarii jednego z dysków to właściwość

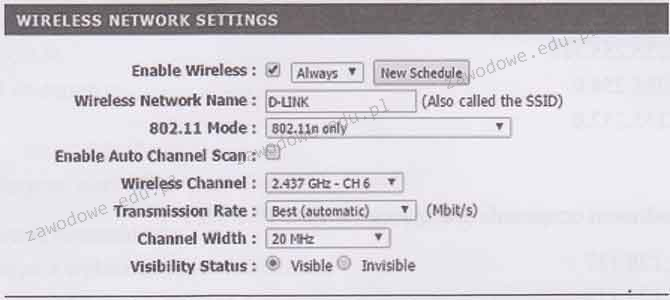

Który z parametrów w ustawieniach punktu dostępowego działa jako login używany podczas próby połączenia z punktem dostępowym w sieci bezprzewodowej?

W systemie Windows harmonogram zadań umożliwia przydzielenie

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Przedstawione na ilustracji narzędzie służy do

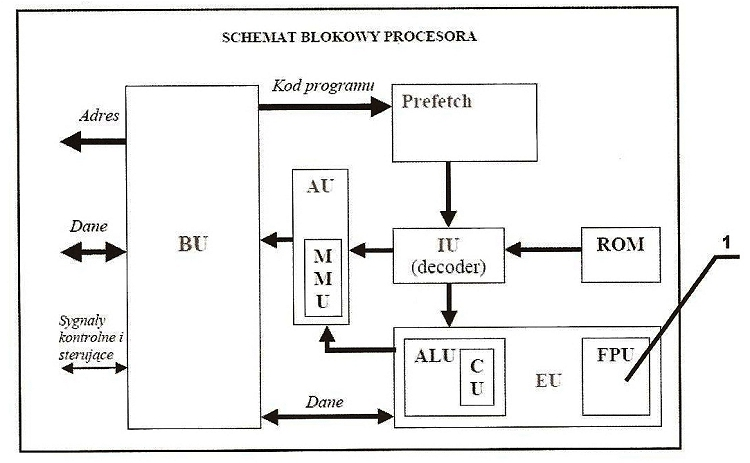

Element oznaczony numerem 1 w schemacie blokowym procesora pełni funkcję

Jakie medium transmisyjne gwarantuje izolację galwaniczną pomiędzy systemami przesyłu danych?

Jeśli sieć 172.16.6.0/26 zostanie podzielona na dwie równe podsieci, to ile adresowalnych hostów będzie w każdej z nich?

Jaki typ grupy jest automatycznie przypisany dla nowo tworzonej grupy w kontrolerze domeny systemu Windows Server?

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN wskazuje na jej maksymalną przepustowość wynoszącą

Proces zapisywania kluczy rejestru do pliku określamy jako

Wymogi działalności przedsiębiorstwa nakładają konieczność używania systemów plików, które zapewniają wysoki poziom zabezpieczeń oraz umożliwiają szyfrowanie informacji. W związku z tym należy wybrać system operacyjny Windows

Jakie urządzenie jest pokazane na ilustracji?

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

Wskaż złącze, które nie jest stosowane w zasilaczach ATX?

Jak nazywa się protokół używany do przesyłania wiadomości e-mail?

Jakie cechy posiadają procesory CISC?

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?