Pytanie 1

Zastosowanie programu w różnych celach, badanie jego działania oraz wprowadzanie modyfikacji, a także możliwość publicznego udostępniania tych zmian, to charakterystyka licencji typu

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Zastosowanie programu w różnych celach, badanie jego działania oraz wprowadzanie modyfikacji, a także możliwość publicznego udostępniania tych zmian, to charakterystyka licencji typu

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak wygląda liczba 356 w systemie binarnym?

Jaką wartość ma największa liczba 16-bitowa?

Jakie zakresy częstotliwości określa klasa EA?

Jak nazywa się standard podstawki procesora bez nóżek?

Co jest głównym zadaniem protokołu DHCP?

Sprawdzenie ilości wolnego miejsca na dysku twardym w systemie Linux umożliwia polecenie

Informacja zawarta na ilustracji może wskazywać na

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Wydanie komendy chmod 400 nazwa_pliku w systemie Linux spowoduje, że właściciel pliku

Podczas instalacji systemu operacyjnego Linux należy wybrać odpowiedni typ systemu plików

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

Najlepszym narzędziem służącym do podgrzania znajdującego się na karcie graficznej elementu SMD, który ma zostać usunięty, jest

Jaki procesor powinien być zastosowany przy składaniu komputera osobistego z płytą główną Asus M5A78L-M/USB3 AMD760G socket AM3+?

Jaki jest adres rozgłoszeniowy w sieci mającej adres IPv4 192.168.0.0/20?

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

W systemie Windows, który obsługuje przydziały dyskowe, użytkownik o nazwie Gość

W serwerach warto korzystać z dysków, które obsługują tryb Hot plugging, ponieważ

Który adres IPv4 odpowiada adresowi IPv6 ::1?

Jakie znaczenie ma parametr NEXT w kontekście pomiarów systemów okablowania strukturalnego?

Aby komputery mogły udostępniać dane w sieci, NIE powinny mieć tych samych

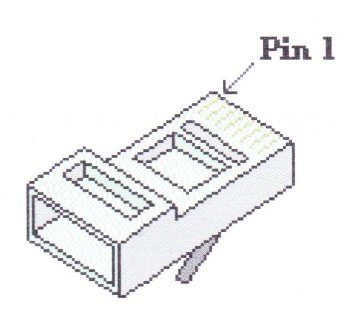

Jak wygląda układ przewodów w złączu RJ45 zgodnie z kolejnością połączeń T568A?

Jakie oprogramowanie zabezpieczające przed nieautoryzowanym dostępem do sieci powinno być zainstalowane na serwerze, który udostępnia dostęp do internetu?

Element trwale zamontowany, w którym znajduje się zakończenie okablowania strukturalnego poziomego dla abonenta, to

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 jest zapisany w formacie

Jakie środowisko powinien wybrać administrator sieci, aby zainstalować serwer dla stron WWW w systemie Linux?

Jaka jest maska podsieci dla adresu IP 217.152.128.100/25?

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

W systemie NTFS do zmiany nazwy pliku konieczne jest posiadanie uprawnienia

Jaką szerokość ma magistrala pamięci DDR SDRAM?

Który z komponentów nie jest zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- maks. 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

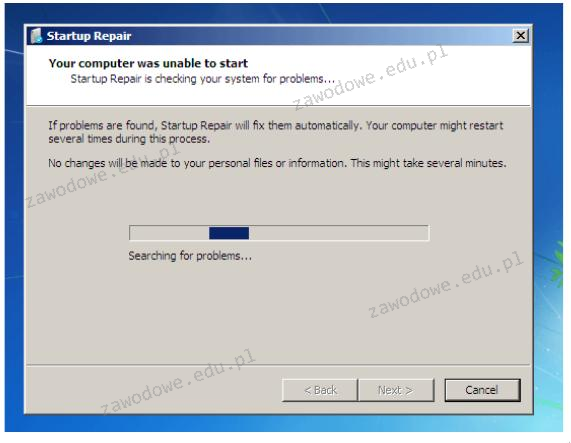

Komunikat, który pojawia się po uruchomieniu narzędzia do naprawy systemu Windows, może sugerować

Programem wiersza poleceń w systemie Windows, który umożliwia kompresję oraz dekompresję plików i folderów, jest aplikacja

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

Jaki typ matrycy powinien być zastosowany w monitorze modernizowanego komputera, aby zapewnić wysoką jakość obrazu oraz szerokie kąty widzenia zarówno w poziomie, jak i w pionie?