Pytanie 1

W systemach operacyjnych Windows konto z najwyższymi uprawnieniami domyślnymi przynależy do grupy

Wynik: 35/40 punktów (87,5%)

Wymagane minimum: 20 punktów (50%)

W systemach operacyjnych Windows konto z najwyższymi uprawnieniami domyślnymi przynależy do grupy

Złocenie styków złącz HDMI ma na celu

Włączenie systemu Windows w trybie diagnostycznym umożliwia

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Jaką maskę domyślną posiada adres IP klasy B?

Który z protokołów umożliwia szyfrowanie połączenia?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby chronić sieć Wi-Fi przed nieupoważnionym dostępem, należy m.in.

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

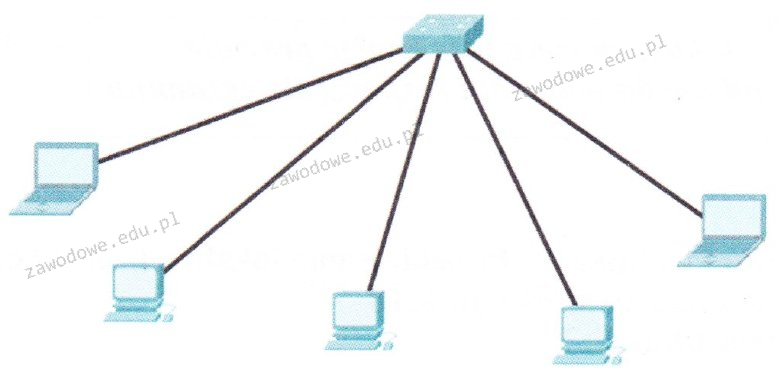

Jaką topologię fizyczną sieci ilustruje zamieszczony rysunek?

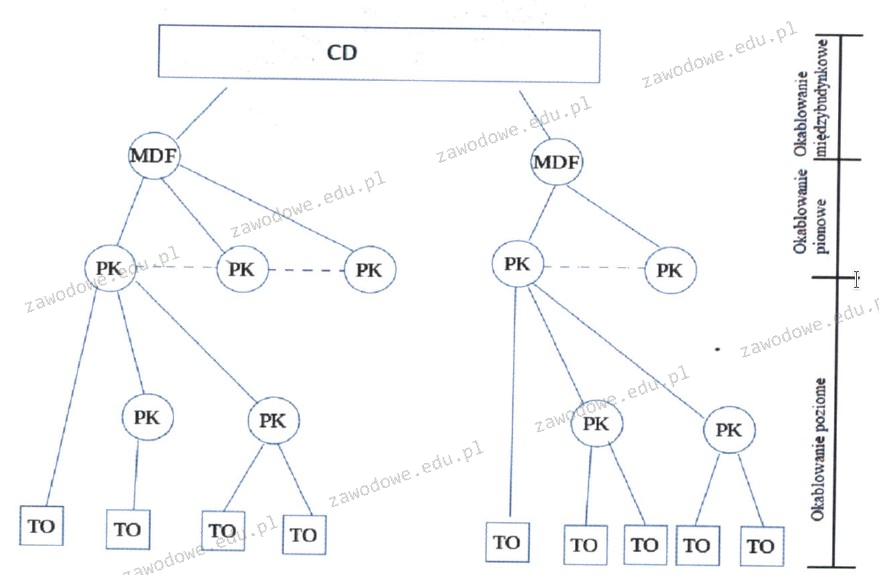

Na zaprezentowanym schemacie logicznym sieci przedstawiono

Mysz komputerowa z interfejsem bluetooth pracującym w klasie 2 ma teoretyczny zasięg do

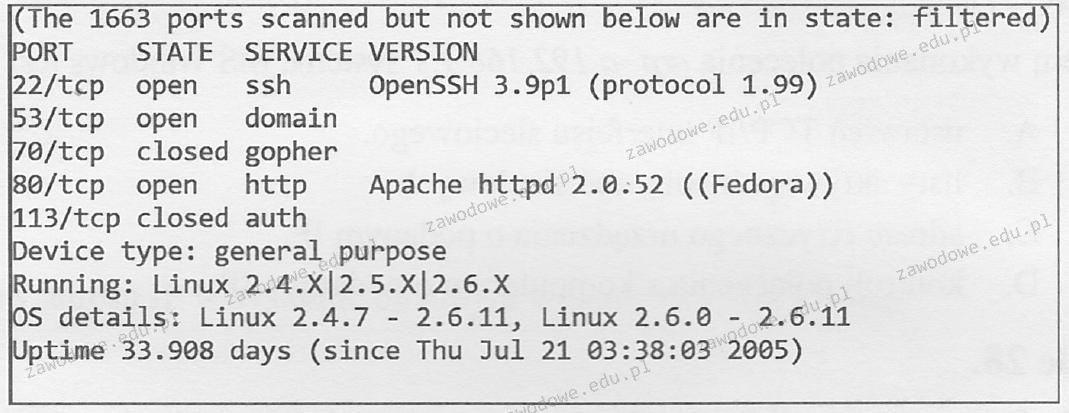

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?

Do ilu sieci należą komputery o adresach IP i maskach sieci przedstawionych w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Jakie oprogramowanie jest zabronione do użytku na sprzęcie instytucji rządowych lub edukacyjnych?

Protokół, który pozwala na bezpieczną, zdalną obsługę serwera, to

Jakiego rodzaju złącze powinna mieć płyta główna, aby umożliwić zainstalowanie karty graficznej przedstawionej na rysunku?

Minimalna zalecana ilość pamięci RAM dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Skrypt o nazwie wykonaj w systemie Linux zawiera: echo -n "To jest pewien parametr " echo $? Wykonanie poleceń znajdujących się w pliku spowoduje wyświetlenie podanego tekstu oraz

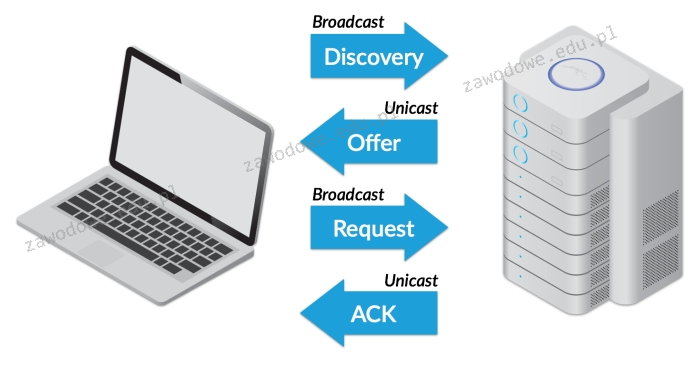

Którego protokołu działanie zostało zaprezentowane na diagramie?

Unity Tweak Tool oraz narzędzia dostrajania to elementy systemu Linux, które mają na celu

Czym jest odwrotność bezstratnego algorytmu kompresji danych?

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Jakim standardem posługuje się komunikacja między skanerem a aplikacją graficzną?

Jakie jest rozgłoszeniowe IP dla urządzenia o adresie 171.25.172.29 z maską 255.255.0.0?

Główną metodą ochrony sieci komputerowej przed zagrożeniem z zewnątrz jest zastosowanie

Jakie oprogramowanie nie jest przeznaczone do diagnozowania komponentów komputera?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

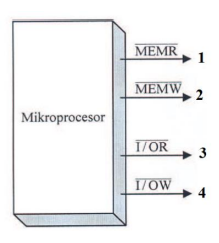

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji