Pytanie 1

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

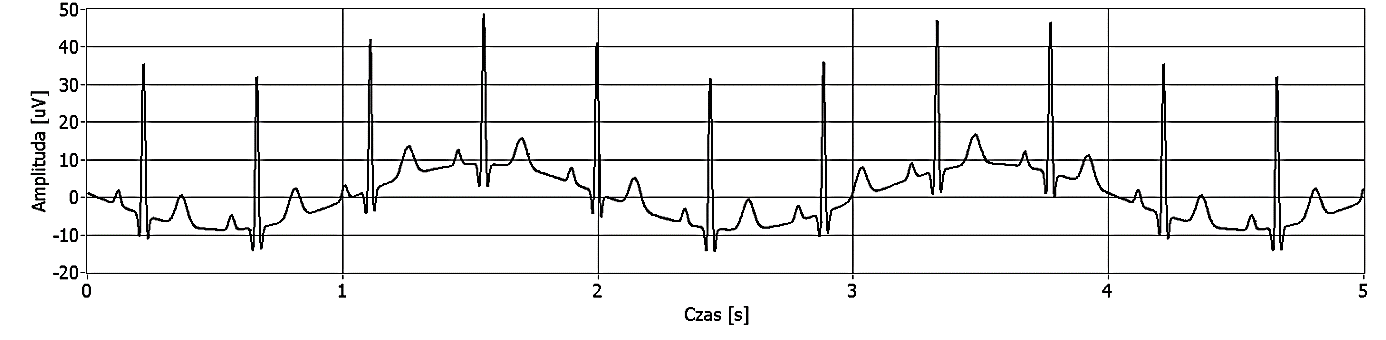

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Technologia OLED znajduje zastosowanie w

Promieniowanie IR jest wykorzystywane w

Jaki wpływ na organizm ludzki ma krioterapia?

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

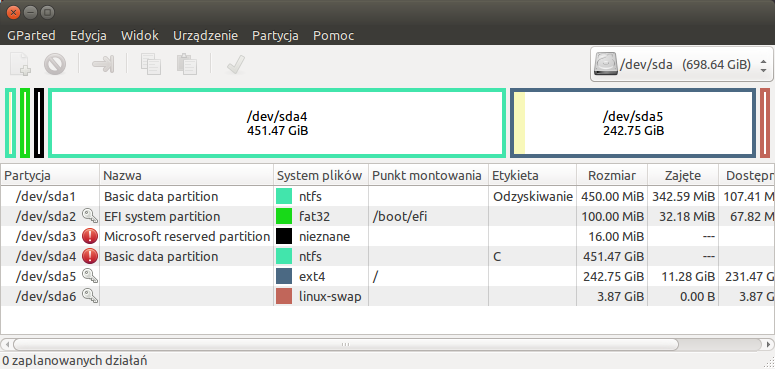

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

Proces, w którym w bazie danych są usuwane nadmiarowe dane, jest określany jako

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

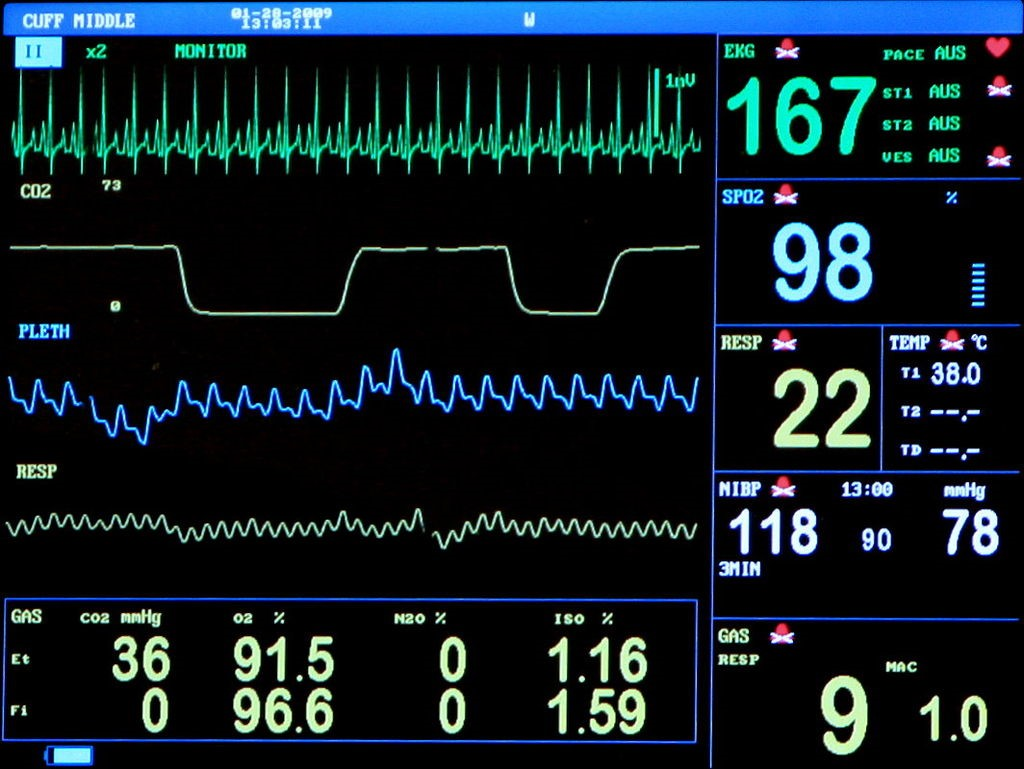

Z ekranu urządzenia wynika, że pełni ono między innymi funkcję

Pierwszym krokiem podczas prac serwisowych wymagających modyfikowania rejestru w systemie Windows jest wykonanie

Podczas pracy z układami elektronicznymi CMOS na stanowisku montażowym należy stosować

Jeżeli procesor graficzny wykonuje także operacje arytmetyczne, oznacza to, że pracuje w architekturze

Która magistrala służy do szeregowej transmisji danych?

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

Który system montażu urządzeń przedstawiono na rysunku?

Konserwacja oprogramowania nie obejmuje

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

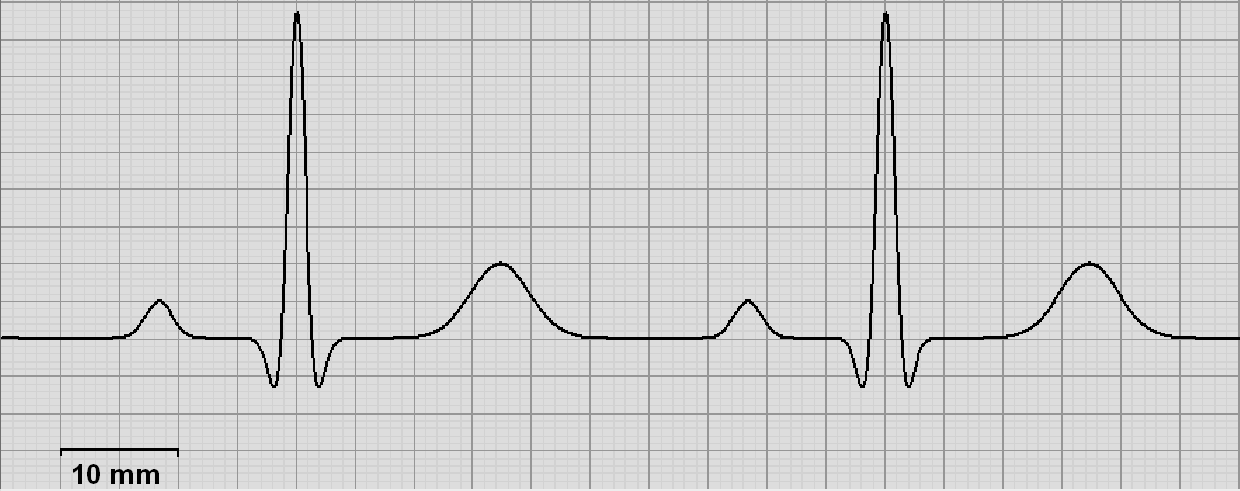

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

Które ustawienie należy wybrać na multimetrze w celu pomiaru napięcia 12 V w obwodzie prądu stałego?

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

Przedstawione na rysunku i opisane w ramce narzędzie służy do ściągania izolacji

| Stripper posiada trzy otwory. Pierwszy pozwala na ściągnięcie płaszcza 250 μm do 125 μm. Drugi otwór przeznaczony jest do ściągania powłoki 900 μm do płaszcza o średnicy 250 μm. Trzeci służy do ściągania powłoki z kabli o średnicy 2 mm ÷ 3 mm do ścisłej tuby o średnicy 900 μm. |

W tabeli przedstawiono fragment dokumentacji testera

| Zakres | ±500 mm Hg 20 °C |

| Dokładność | ±1% odczytu + 0.5 mm Hg) |

| Zakres | 80, 94 bpm (synch. z EKG) |

| Dokładność sygnału | ±1% |

| Inwazyjne: | |

| Statyczne ciśnienie | -10, -5, 0, 20, 40, 50, 60, 80, 100, 150, 160, 200, 240, 250, 300, 320, 400 mm Hg |

| Dokładność | ±(1% zakresu ±1mm Hg) or ±(2% nastawy + 2mm Hg) |

| Impedancja | 300 Ohm (±10% dokładności) |

| Czułość | 5 do 40 μV/V/mm Hg |

Na rysunku przedstawiono przyrząd, którym przeprowadza się test i kontrolę

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Zapis w dokumentacji technicznej elektrokardiografu określający V1, V2, …V6 dotyczy odprowadzeń

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Podczas tworzenia tabeli w bazie danych klucz podstawowy określa się jako

Który system informatyki medycznej umożliwia archiwizację obrazów?

Który z przedstawionych przyrządów służy do testowania połączeń w sieci LAN?

Do zaktualizowania rekordu tabeli należy zastosować polecenie

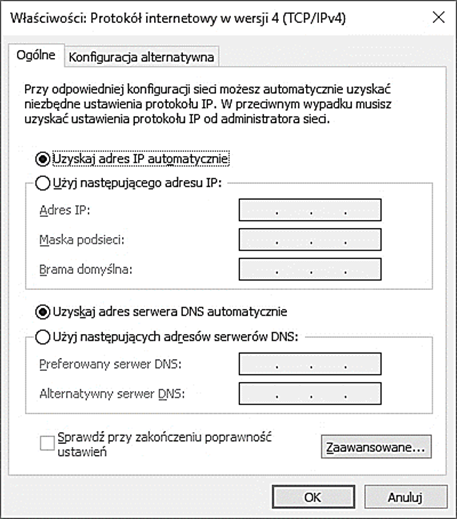

Aby karta sieciowa automatycznie uzyskiwała adres IP, ruter musi mieć włączony serwer

Na rysunku przedstawiono urządzenie z dodatkową kartą pamięci. Który rodzaj karty może zostać zastosowany w urządzeniu?