Pytanie 1

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

W systemie Linux do bieżącego śledzenia działających procesów wykorzystuje się polecenie:

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Do konserwacji elementów łożyskowanych oraz ślizgowych w urządzeniach peryferyjnych stosuje się

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Jakie czynności nie są realizowane przez system operacyjny?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

Jakie narzędzie w systemie Windows pozwala na ocenę wpływu poszczególnych procesów i usług na wydajność procesora oraz na obciążenie pamięci i dysku?

Urządzenie przedstawione na ilustracji oraz jego dane techniczne mogą być użyte do pomiarów rodzaju okablowania

Czym jest OTDR?

W celu zabezpieczenia komputerów w sieci lokalnej przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

W systemie Windows harmonogram zadań umożliwia przydzielenie

Jaką rolę odgrywa ISA Server w systemie operacyjnym Windows?

Jakie urządzenie ilustruje zamieszczony rysunek?

Jakie polecenie w systemie Linux umożliwia wyświetlenie listy zawartości katalogu?

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Zjawiskiem typowym, które może świadczyć o nadchodzącej awarii twardego dysku, jest wystąpienie

Oprogramowanie, które często przerywa działanie przez wyświetlanie komunikatu o konieczności dokonania zapłaty, a które spowoduje zniknięcie tego komunikatu, jest dystrybuowane na podstawie licencji

Obniżenie ilości jedynek w masce pozwala na zaadresowanie

Jakie zadanie pełni router?

Zgodnie z KNR (katalogiem nakładów rzeczowych), montaż na skrętce 4-parowej modułu RJ45 oraz złącza krawędziowego wynosi 0,07 r-g, a montaż gniazd abonenckich natynkowych to 0,30 r-g. Jaki będzie całkowity koszt robocizny za zamontowanie 10 pojedynczych gniazd natynkowych z modułami RJ45, jeśli wynagrodzenie godzinowe montera-instalatora wynosi 20,00 zł?

Wydanie w systemie Windows komendy ```ATTRIB -S +H TEST.TXT``` spowoduje

Czym jest prefetching?

Element, który jest na stałe zainstalowany u abonenta i zawiera zakończenie poziomego okablowania strukturalnego, to

Symbol graficzny przedstawiony na ilustracji oznacza złącze

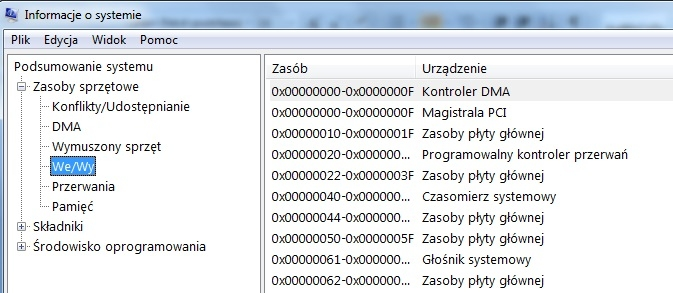

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Administrator sieci komputerowej pragnie zweryfikować na urządzeniu z systemem Windows, które połączenia są aktualnie ustanawiane oraz na jakich portach komputer prowadzi nasłuch. W tym celu powinien użyć polecenia

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

SuperPi to aplikacja używana do oceniania

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

Podaj adres rozgłoszeniowy sieci, do której przynależy host o adresie 88.89.90.91/6?

Który z wymienionych adresów należy do klasy C?

Który z poniższych adresów IP należy do grupy C?