Pytanie 1

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Czym jest układ RAMDAC?

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

Którego programu nie można użyć do przywrócenia danych w systemie Windows na podstawie wcześniej wykonanej kopii?

Jaki pakiet powinien zostać zainstalowany na serwerze Linux, aby umożliwić stacjom roboczym z systemem Windows dostęp do plików i drukarek udostępnianych przez ten serwer?

SuperPi to aplikacja używana do testowania

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Jan, użytkownik, nie ma możliwości zmiany właściciela drukarki w systemie Windows. Aby zyskał taką opcję, konieczne jest nadanie mu w ustawieniach zabezpieczeń prawa do

Protokół trasowania wewnętrznego, który wykorzystuje metrykę wektora odległości, to

Jaką liczbę adresów IP należy wykorzystać, aby 4 komputery podłączone do switcha mogły się swobodnie komunikować?

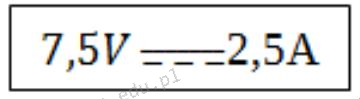

Na urządzeniu zasilanym prądem stałym znajduje się wskazane oznaczenie. Co można z niego wywnioskować o pobieranej mocy urządzenia, która wynosi około

Jakiej kategorii skrętka pozwala na przesył danych w zakresie częstotliwości nieprzekraczającym 100 MHz przy szybkości do 1 Gb/s?

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Co oznacza skrót 'RAID' w kontekście systemów komputerowych?

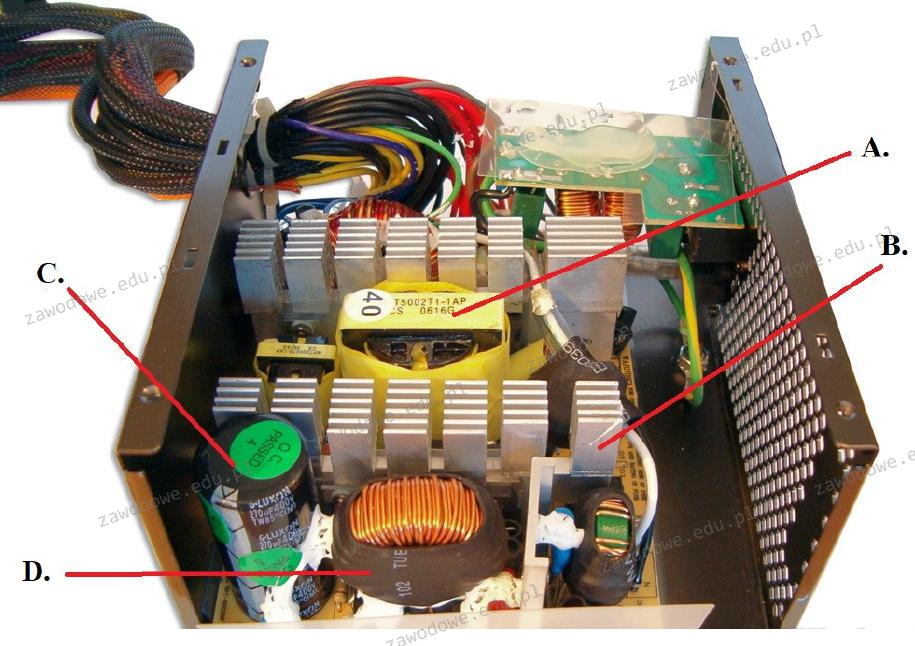

W przedstawionym zasilaczu transformator impulsowy oznaczono symbolami

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

Oprogramowanie komputerowe, które jest dostępne bezpłatnie i bez ograniczeń czasowych, jest dystrybuowane na podstawie licencji typu

W dokumentacji płyty głównej podano informację "wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

W systemie Linux użycie polecenia passwd Ala spowoduje

Do konserwacji elementów optycznych w komputerach zaleca się zastosowanie

Jaką postać ma liczba dziesiętna 512 w systemie binarnym?

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Symbol "LGA 775" obecny w dokumentacji technicznej płyty głównej wskazuje na typ gniazda dla procesorów:

Wskaż program do składu publikacji

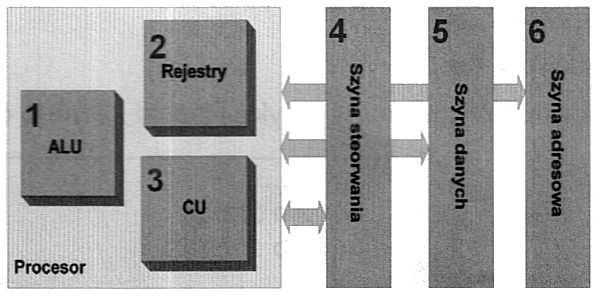

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Do jakiej warstwy modelu ISO/OSI odnosi się segmentacja danych, komunikacja w trybie połączeniowym przy użyciu protokołu TCP oraz komunikacja w trybie bezpołączeniowym z protokołem UDP?

Adresy IPv6 są reprezentowane jako liczby

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

Który z poniższych adresów IP należy do grupy C?

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

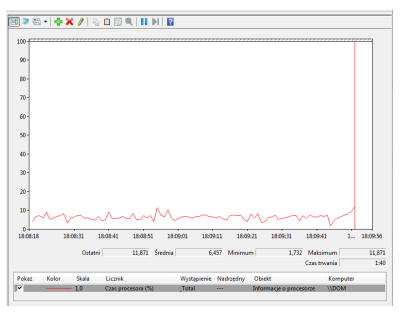

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

W systemie Linux do śledzenia wykorzystania procesora, pamięci, procesów oraz obciążenia systemu wykorzystuje się polecenie