Pytanie 1

Termin "10 W" w dokumentacji technicznej dotyczącej głośnika komputerowego wskazuje na jego

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Termin "10 W" w dokumentacji technicznej dotyczącej głośnika komputerowego wskazuje na jego

Jakie narzędzie w wierszu poleceń służy do testowania oraz diagnostyki serwerów DNS?

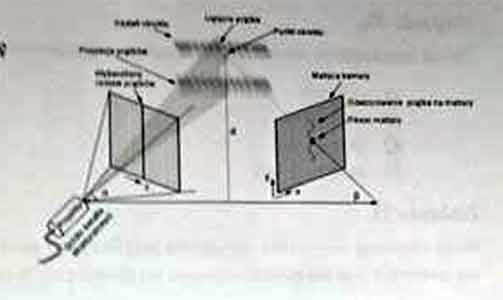

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Kiedy użytkownik wpisuje w przeglądarkę adres www.egzamin.pl, nie ma on możliwości otwarcia strony WWW, natomiast wpisujący adres 211.0.12.41 zyskuje dostęp do tej strony. Problem ten wynika z nieprawidłowej konfiguracji serwera

Który z protokołów zapewnia bezpieczne połączenie między klientem a witryną internetową banku, zachowując prywatność użytkownika?

Jednym z programów ochronnych, które zabezpieczają system przed oprogramowaniem, które bez zgody użytkownika zbiera i przesyła jego dane osobowe, numery kart kredytowych, informacje o odwiedzanych stronach WWW, hasła oraz używane adresy e-mail, jest aplikacja

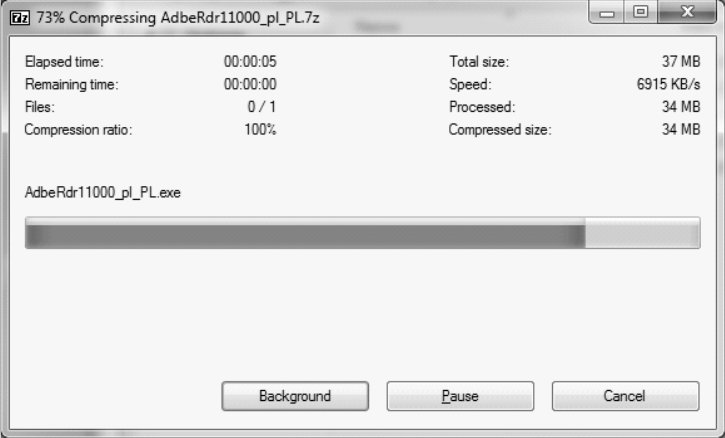

Na dołączonym obrazku ukazano proces

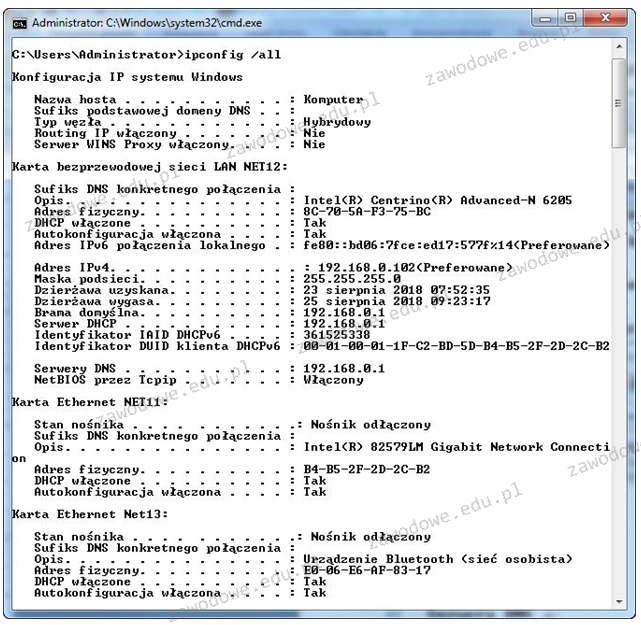

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

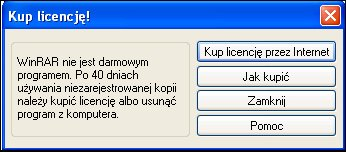

Program WinRaR zaprezentował okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencji na program używał do tej pory użytkownik?

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Jakie narzędzie w systemie Windows pozwala na ocenę wpływu poszczególnych procesów i usług na wydajność procesora oraz na obciążenie pamięci i dysku?

Komputer z BIOS-em firmy Award wyświetlił komunikat o treści Primary/Secondary master/slave hard disk fail. Co taki komunikat może sugerować w kontekście konieczności wymiany?

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

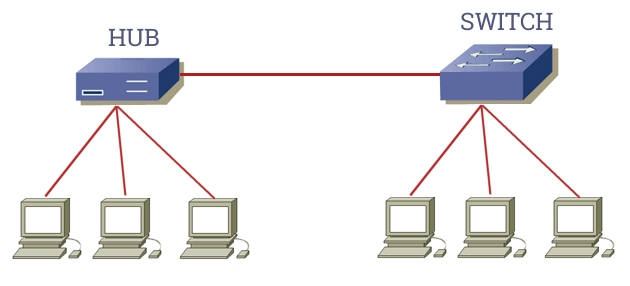

Ile kolizji domenowych występuje w sieci przedstawionej na ilustracji?

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

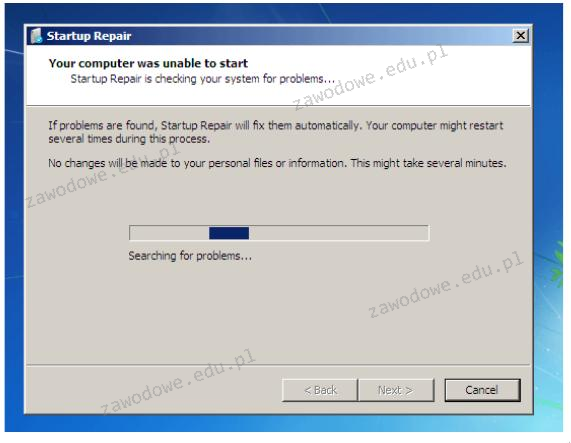

Komunikat, który pojawia się po uruchomieniu narzędzia do naprawy systemu Windows, może sugerować

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?

Wskaż najkorzystniejszą trasę sumaryczną dla podsieci IPv4?

| 10.10.168.0/23 |

| 10.10.170.0/23 |

| 10.10.172.0/23 |

| 10.10.174.0/24 |

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można wymienić na model z gniazdem, nie zmieniając procesora i pamięci

W systemie Linux narzędzie fsck umożliwia

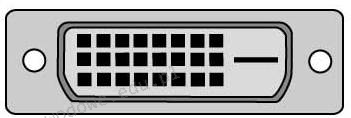

Jak brzmi nazwa portu umieszczonego na tylnym panelu komputera, który znajduje się na przedstawionym rysunku?

Posiadacz notebooka pragnie zainstalować w nim dodatkowy dysk twardy. Urządzenie ma jedynie jedną zatokę na HDD. Możliwością rozwiązania tego wyzwania może być użycie dysku z interfejsem

W układzie SI jednostką, która mierzy napięcie, jest

Program firewall nie zapewnia ochrony przed

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

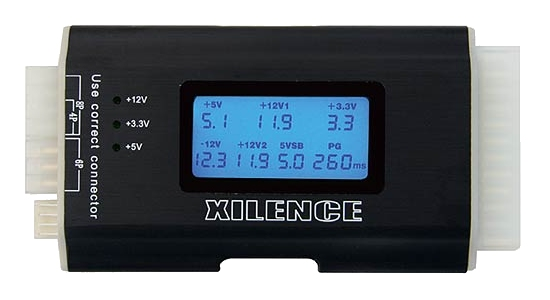

Przy użyciu urządzenia przedstawionego na ilustracji można sprawdzić działanie

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

Jak nazywa się rodzaj licencji, który sprawia, że program jest w pełni funkcjonalny, ale można go uruchomić jedynie określoną, niewielką liczbę razy od momentu instalacji?

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

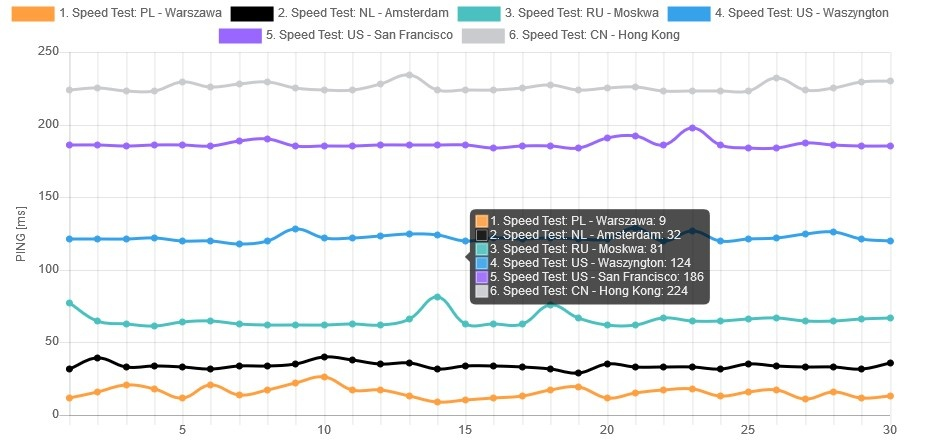

Na podstawie przedstawionego na ilustracji okna aplikacji do monitorowania łącza internetowego można określić

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Podczas monitorowania aktywności sieciowej zauważono, że na adres serwera przesyłano tysiące zapytań DNS w każdej sekundzie z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego był atak typu

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

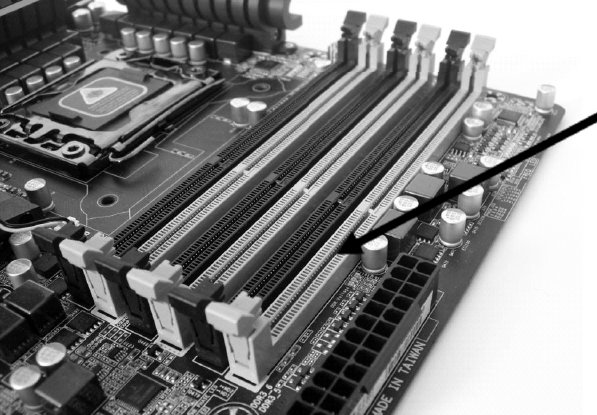

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?