Pytanie 1

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Kluczowy sposób zabezpieczenia danych w sieci komputerowej przed nieautoryzowanym dostępem to

Ataki mające na celu zakłócenie funkcjonowania aplikacji oraz procesów działających w urządzeniu sieciowym określane są jako ataki typu

Wskaż aplikację w systemie Linux, która służy do kompresji plików.

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Wskaż zakres adresów hostów w sieci 172.16.4.0/24?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Medium transmisyjne oznaczone symbolem S/FTP wskazuje na skrętkę

Wynikiem dodawania liczb \( 33_{(8)} \) oraz \( 71_{(8)} \) jest liczba

Dane z twardego dysku HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Jakie pole znajduje się w nagłówku protokołu UDP?

Jakie urządzenie zapewnia zabezpieczenie przed różnorodnymi atakami z sieci i może również realizować dodatkowe funkcje, takie jak szyfrowanie danych przesyłanych lub automatyczne informowanie administratora o włamaniu?

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Sekwencja 172.16.0.1, która reprezentuje adres IP komputera, jest zapisana w systemie

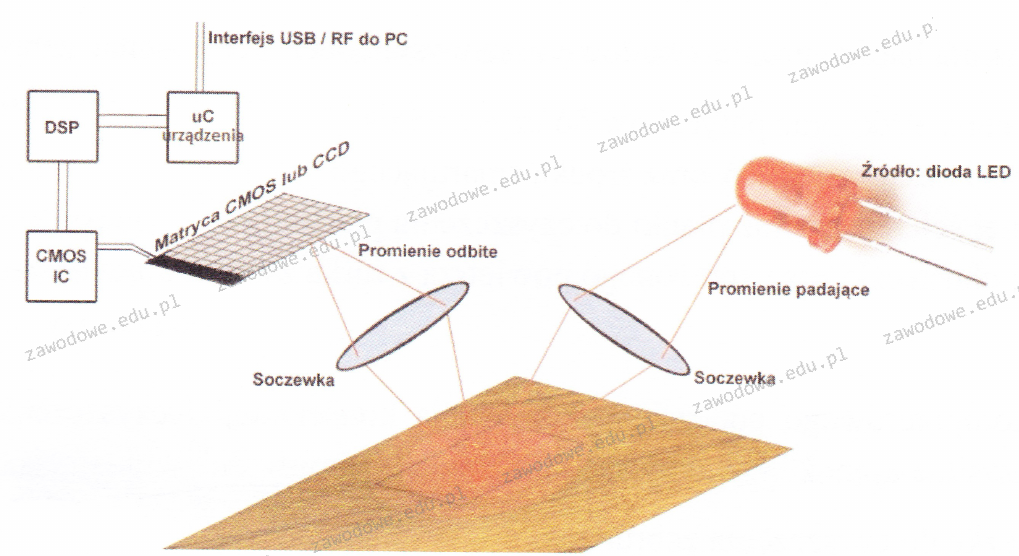

Zilustrowany schemat przedstawia zasadę funkcjonowania

Firma Dyn, której serwery DNS zostały zaatakowane, przyznała, że część tego ataku … miała miejsce z użyciem różnych urządzeń podłączonych do sieci. Ekosystem kamer, czujników i kontrolerów określany ogólnie jako 'Internet rzeczy' został wykorzystany przez cyberprzestępców jako botnet − sieć maszyn-zombie. Jakiego rodzaju atak jest opisany w tym cytacie?

Jaki procesor powinien być zastosowany przy składaniu komputera osobistego z płytą główną Asus M5A78L-M/USB3 AMD760G socket AM3+?

Przypisanie licencji oprogramowania do pojedynczego komputera lub jego komponentów stanowi charakterystykę licencji

Okablowanie pionowe w sieci strukturalnej łączy jakie elementy?

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo zabrudzone. W celu ich oczyszczenia, należy zastosować

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Aby mieć możliwość tworzenia kont użytkowników, komputerów oraz innych obiektów, a także centralnego przechowywania informacji o nich, konieczne jest zainstalowanie na serwerze Windows roli

W dokumentacji technicznej głośników komputerowych producent może zamieścić informację, że największe pasmo przenoszenia wynosi

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Drugi monitor CRT, który jest podłączony do komputera, ma zastosowanie do

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

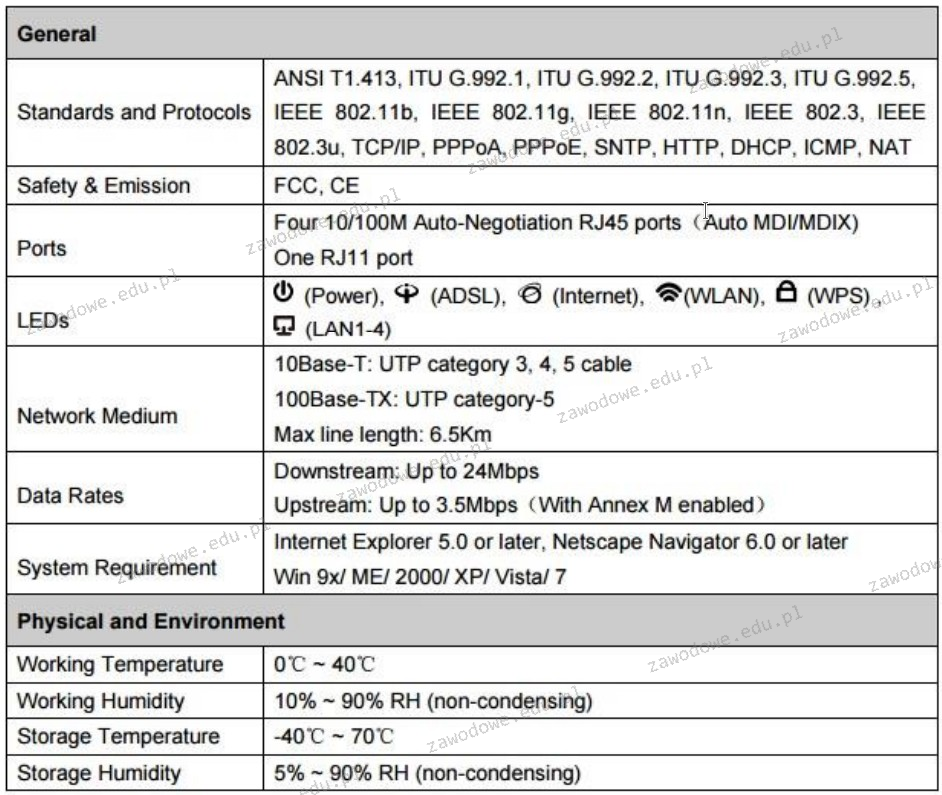

Przedstawiona specyfikacja techniczna odnosi się do

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

Ile minimalnie pamięci RAM powinien mieć komputer, aby możliwe było uruchomienie 32-bitowego systemu operacyjnego Windows 7 w trybie graficznym?

Aby zablokować oraz usunąć złośliwe oprogramowanie, takie jak exploity, robaki i trojany, konieczne jest zainstalowanie oprogramowania

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem