Pytanie 1

Jakie polecenie w systemie operacyjnym Linux służy do prezentowania konfiguracji interfejsów sieciowych?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie w systemie operacyjnym Linux służy do prezentowania konfiguracji interfejsów sieciowych?

Jakiego narzędzia wraz z parametrami, należy użyć w systemie Windows, aby wyświetlić przedstawione informacje o dysku twardym?

| ST950420AS | |||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator dysku | : A67B7C06 | ||||||||||||||||||||||||||||||||||||||||||||||

| Typ | : ATA | ||||||||||||||||||||||||||||||||||||||||||||||

| Stan | : Online | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Element docelowy | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator jednostki LUN | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka lokalizacji | : PCIROOT(0)#ATA(C00T00L00) | ||||||||||||||||||||||||||||||||||||||||||||||

| Bieżący stan tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Rozruchowy | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików stronicowania | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików hibernacji | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk zrzutów awaryjnych | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk klastrowany | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| |||||||||||||||||||||||||||||||||||||||||||||||

Wskaż poprawną wersję maski podsieci?

Jakie właściwości posiada topologia fizyczna sieci opisana w ramce?

Jednym z rezultatów wykonania poniższego polecenia jest:

sudo passwd -n 1 -x 5 test

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Nieprawidłowa forma zapisu liczby 778 to

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Aby zrealizować wymianę informacji między dwoma odmiennymi sieciami, konieczne jest użycie

Diagnozowanie uszkodzonych komponentów komputera przez sprawdzenie stanu wyjściowego układu cyfrowego umożliwia

Chusteczki namoczone w płynie o działaniu antystatycznym są używane do czyszczenia

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Transmisja danych typu półduplex to transmisja

Napięcie dostarczane przez płytę główną dla pamięci typu SDRAM DDR3 może wynosić

Jakie polecenia należy zrealizować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Wykonanie polecenia net use z:\\192.168.20.2\data /delete, spowoduje

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Jakie zagrożenia eliminują programy antyspyware?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

W normie PN-EN 50174 nie znajdują się wytyczne dotyczące

Jakiego typu dane są przesyłane przez interfejs komputera osobistego, jak pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Celem złocenia styków złącz HDMI jest

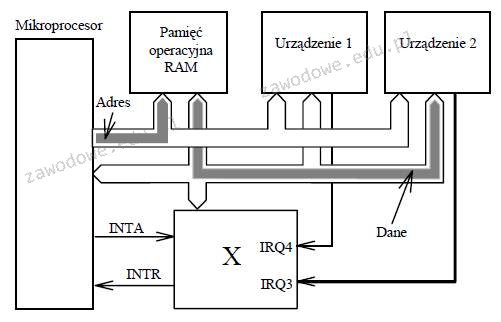

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

Interfejs SATA 2 (3 Gb/s) gwarantuje prędkość transferu

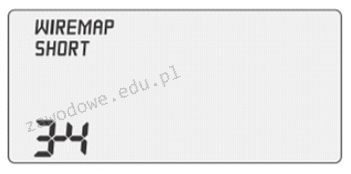

Na ilustracji pokazano wynik pomiaru okablowania. Jaką interpretację można nadać temu wynikowi?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Na jakich portach brama sieciowa powinna umożliwiać ruch, aby klienci w sieci lokalnej mieli możliwość ściągania plików z serwera FTP?

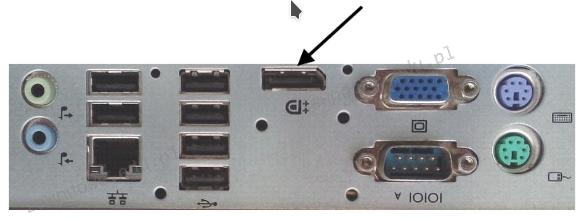

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Który adres IPv4 identyfikuje urządzenie działające w sieci z adresem 14.36.64.0/20?

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

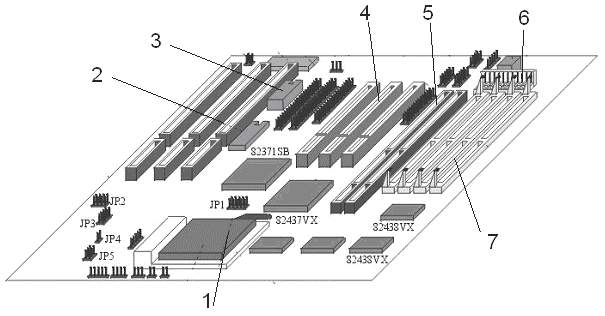

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem