Pytanie 1

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Aby uzyskać optymalną wydajność, karta sieciowa w komputerze stosuje transmisję szeregową.

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

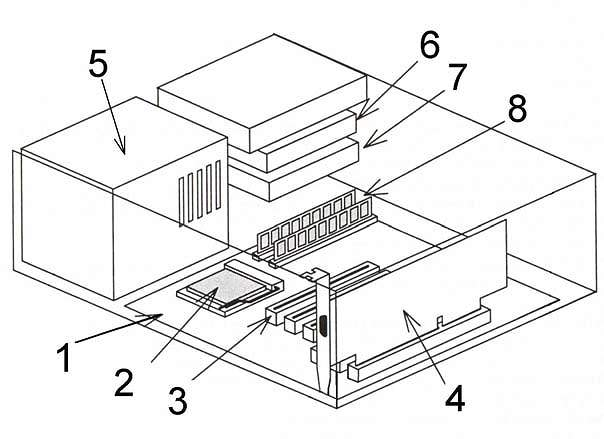

Schemat ilustruje fizyczną strukturę

Na jakich portach brama sieciowa powinna umożliwiać ruch, aby klienci w sieci lokalnej mieli możliwość ściągania plików z serwera FTP?

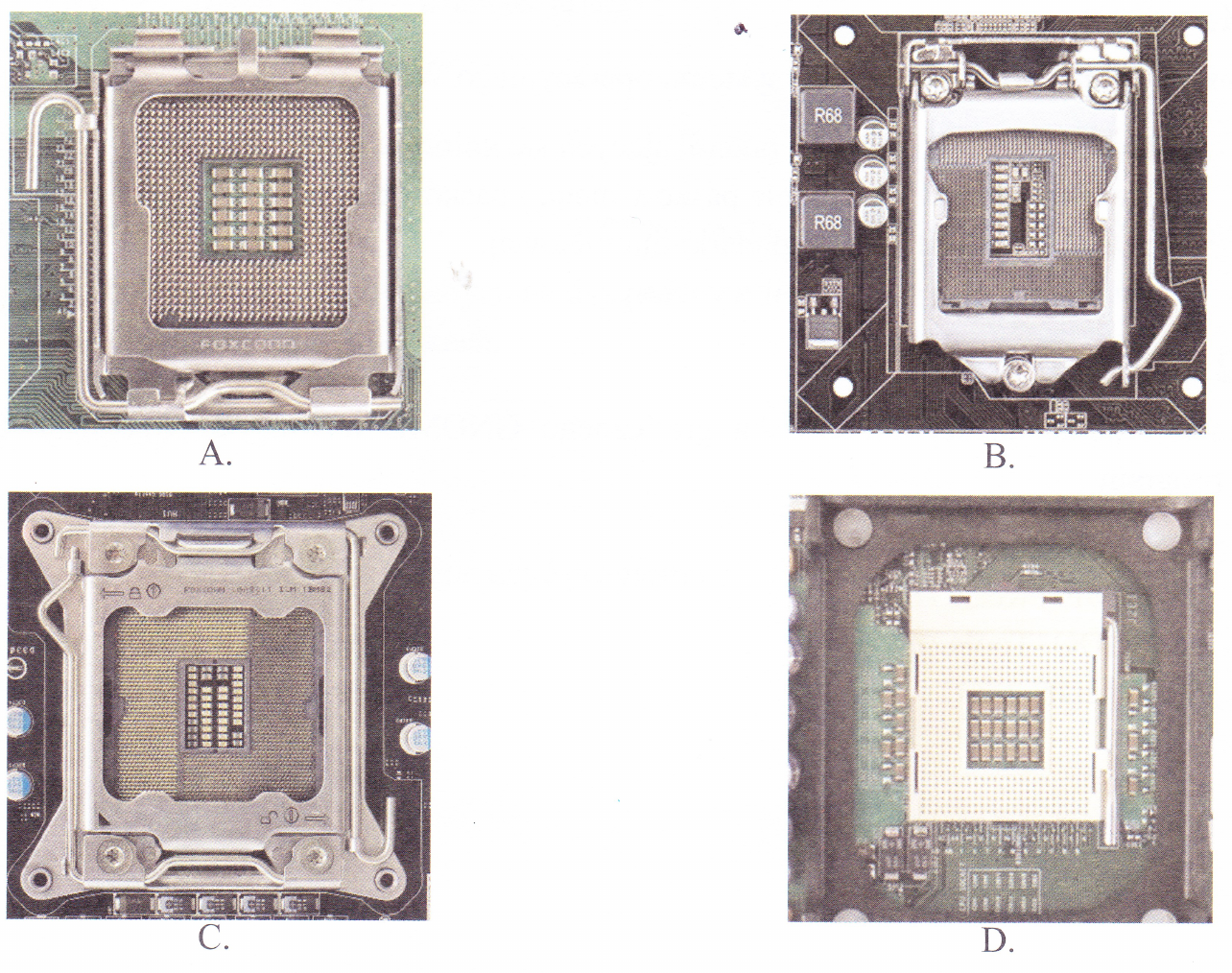

W jakim gnieździe należy umieścić procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Na ilustracji procesor jest oznaczony liczbą

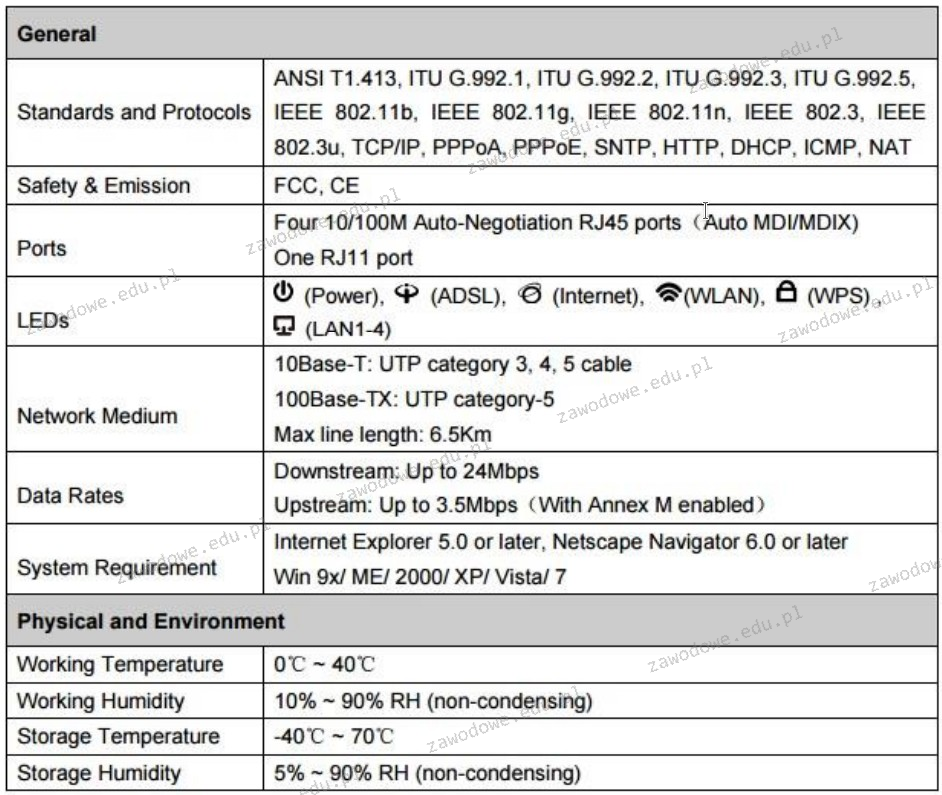

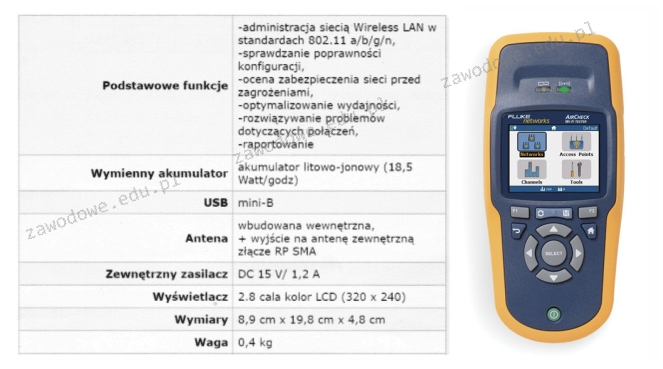

Przedstawiona specyfikacja techniczna odnosi się do

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

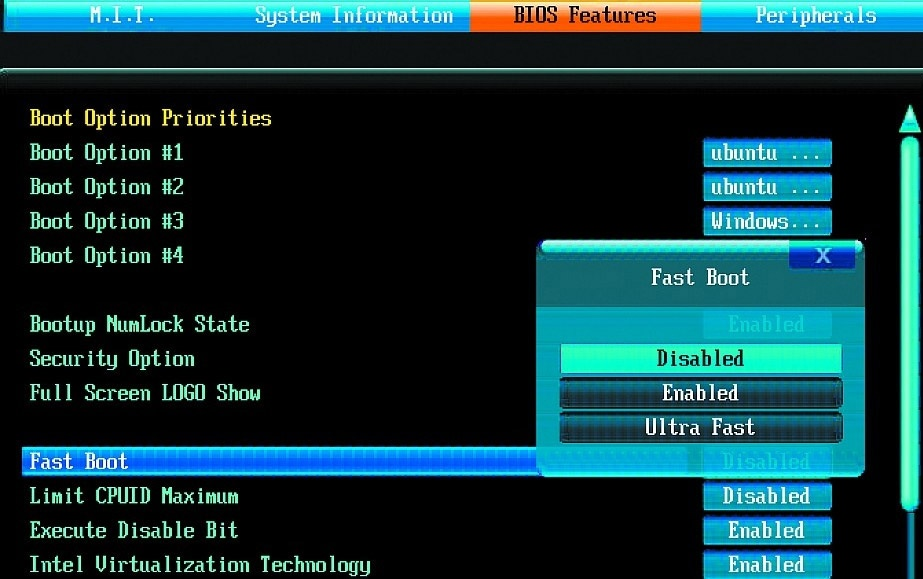

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

Jakie urządzenie diagnostyczne zostało zaprezentowane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Podczas próby zapisania danych na karcie SD wyświetla się komunikat „usuń ochronę przed zapisem lub skorzystaj z innego nośnika”. Najczęstszą przyczyną takiego komunikatu jest

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

Jakie adresy mieszczą się w zakresie klasy C?

Wskaż zakres adresów hostów w sieci 172.16.4.0/24?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

To narzędzie może być wykorzystane do

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Jak nazywa się serwer Windows, na którym zainstalowano usługę Active Directory?

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?

W systemie Linux komenda, która pozwala na wyświetlenie informacji o aktywnych procesach, to

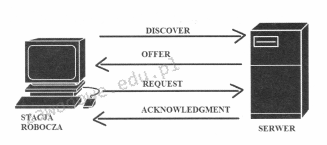

Którego protokołu działanie zostało zobrazowane na załączonym rysunku?

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

W dokumentacji płyty głównej znajduje się informacja "Wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

Jakie narzędzie służy do delikatnego wygięcia blachy obudowy komputera i przykręcenia śruby montażowej w trudno dostępnych miejscach?

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

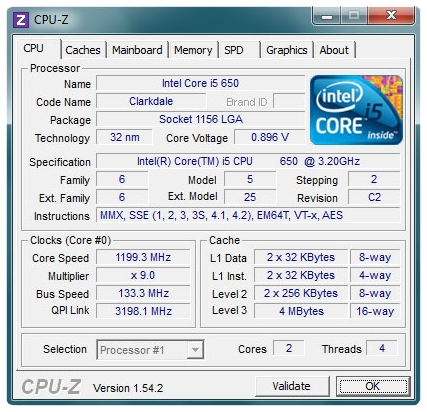

W dokumentacji technicznej procesora producent zamieścił wyniki analizy zrealizowanej przy użyciu programu CPU-Z. Z tych informacji wynika, że procesor dysponuje

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Jak zapisuje się liczbę siedem w systemie ósemkowym?

Który symbol przedstawia przełącznik?

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Hosty A i B nie mają możliwości komunikacji z hostem C. Natomiast komunikacja między hostami A i B przebiega poprawnie. Jakie może być źródło problemu w komunikacji pomiędzy hostami A i C oraz B i C?

Określ adres sieci, do której przypisany jest host o adresie 172.16.0.123/27?

Aplikacją, która umożliwia wyświetlenie listy aktywnych urządzeń w sieci LAN, jest

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i przechowywać o nich informacje w centralnym miejscu, konieczne jest zainstalowanie na serwerze Windows roli

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer