Pytanie 1

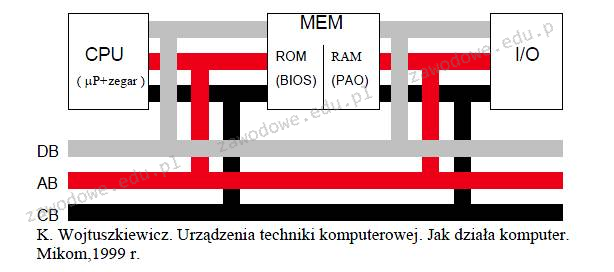

Który z komponentów komputera, gdy zasilanie jest wyłączone, zachowuje program inicjujący uruchamianie systemu operacyjnego?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Który z komponentów komputera, gdy zasilanie jest wyłączone, zachowuje program inicjujący uruchamianie systemu operacyjnego?

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Jakie materiały eksploatacyjne wykorzystuje się w rzutniku multimedialnym?

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?

Jakie jest maksymalne dozwolone promień gięcia przy układaniu kabla U/UTP kat.5E?

Na nowym urządzeniu komputerowym program antywirusowy powinien zostać zainstalowany

Złącze SC powinno być zainstalowane na przewodzie

Narzędzie pokazane na ilustracji jest używane do weryfikacji

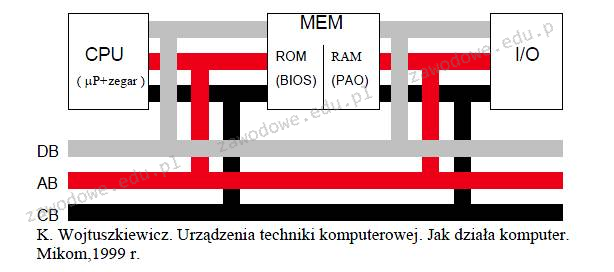

Zaprezentowany diagram ilustruje zasadę funkcjonowania

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Do wyświetlenia daty w systemie Linux można wykorzystać polecenie

W systemie Linux komenda ps wyświetli

Która funkcja systemu Windows Server pozwala na m.in. uproszczoną, bezpieczną oraz zdalną instalację systemów operacyjnych Windows na komputerach w sieci?

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

Wskaż najkorzystniejszą trasę sumaryczną dla podsieci IPv4?

| 10.10.168.0/23 |

| 10.10.170.0/23 |

| 10.10.172.0/23 |

| 10.10.174.0/24 |

Urządzenie sieciowe działające w trzeciej warstwie modelu ISO/OSI, obsługujące adresy IP, to

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?

W sieci o adresie 192.168.20.0 użyto maski podsieci 255.255.255.248. Jak wiele adresów IP będzie dostępnych dla urządzeń?

Licencja CAL (Client Access License) uprawnia użytkownika do

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

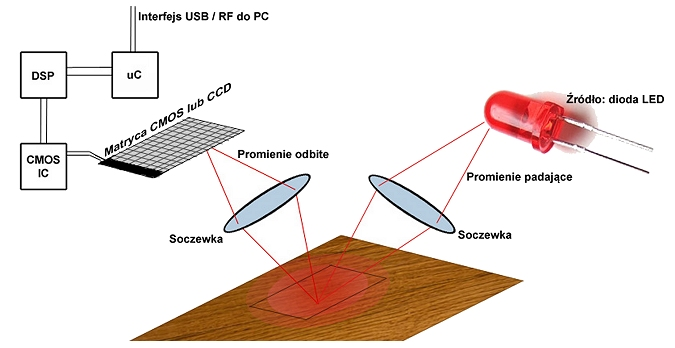

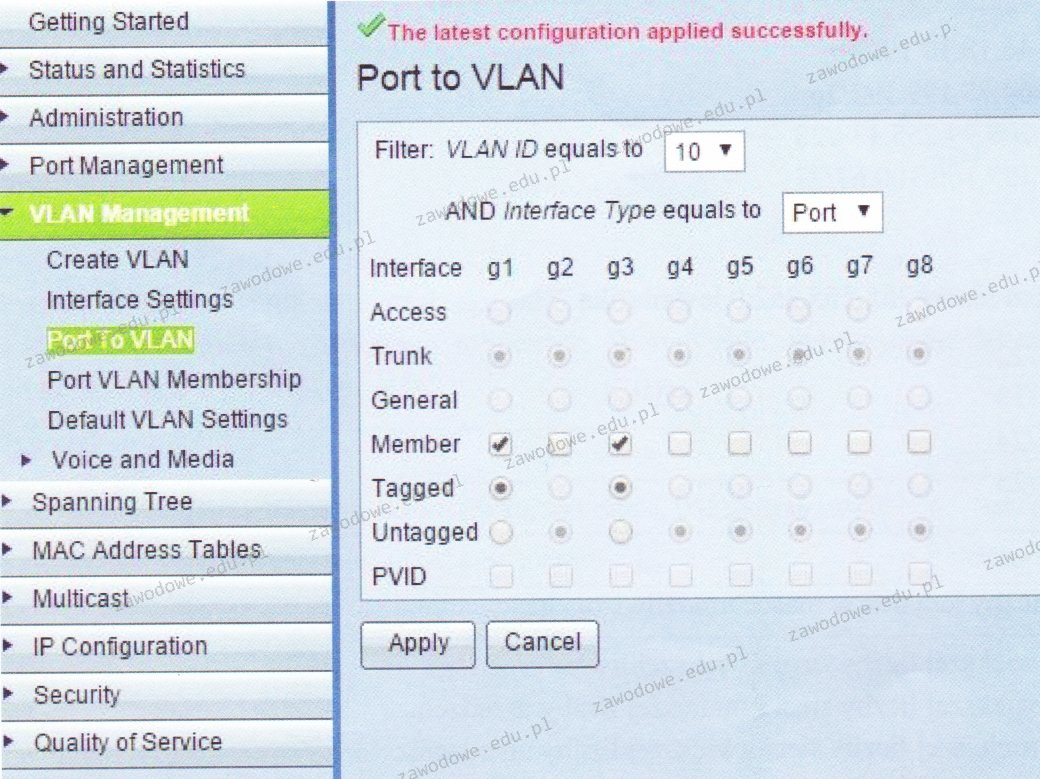

Na ilustracji przedstawiona jest konfiguracja

Ustawa z dnia 14 grudnia 2012 roku dotycząca odpadów zobowiązuje

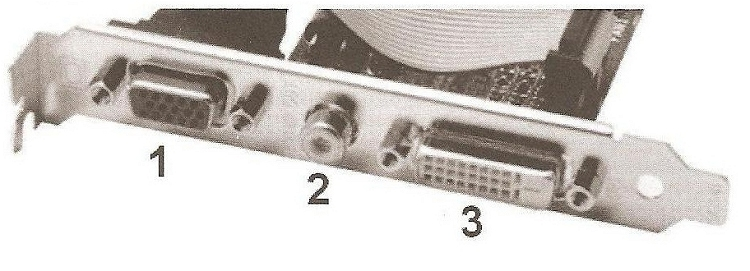

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

Jakie z podanych urządzeń stanowi część jednostki centralnej?

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Administrator sieci komputerowej z adresem 192.168.1.0/24 podzielił ją na 8 równych podsieci. Ile adresów hostów będzie dostępnych w każdej z nich?

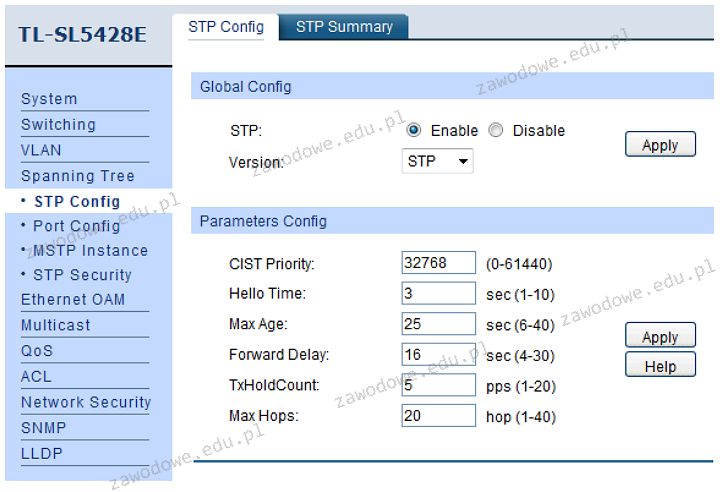

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

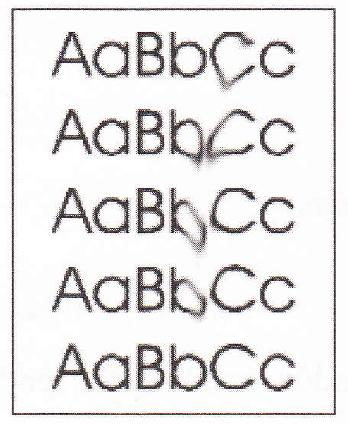

Wskaż efekt działania przedstawionego polecenia.

net user Test /expires:12/09/20

Użytkownik systemu Linux, który pragnie usunąć konto innego użytkownika wraz z jego katalogiem domowym, powinien wykonać polecenie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

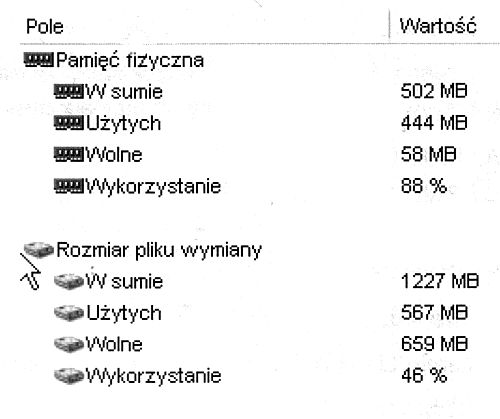

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

W celu doboru właściwej aktualizacji oprogramowania dla punktu dostępowego można skorzystać z identyfikacji

Który z wymienionych systemów operacyjnych nie obsługuje wielozadaniowości?

Który z wymienionych składników stanowi element pasywny w sieci?

Na 16 bitach możemy przechować

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać