Pytanie 1

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Nieprawidłowa forma zapisu liczby 778 to

Aby zabezpieczyć system przed oprogramowaniem o zdolności do samoreplikacji, należy zainstalować

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

W systemie operacyjnym Fedora foldery domowe użytkowników znajdują się w folderze

W systemie Linux plik messages zawiera

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

Którego z poniższych zadań nie wykonują serwery plików?

Port AGP służy do łączenia

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

AC-72-89-17-6E-B2 to adres MAC karty sieciowej zapisany w formacie

Która z poniższych liczb w systemie dziesiętnym poprawnie przedstawia liczbę 101111112?

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

Jaki skrót oznacza rodzaj licencji Microsoft dedykowanej dla szkół, uczelni, instytucji rządowych oraz dużych firm?

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów

Planowana sieć należy do kategorii C. Została ona podzielona na 4 podsieci, z których każda obsługuje 62 urządzenia. Która z poniższych masek będzie odpowiednia do tego zadania?

Zarządzanie konfiguracją karty sieciowej w systemie Windows 7 realizuje polecenie

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

Początkowe znaki heksadecymalne adresu IPv6 przeznaczonego do link-local to

Aby stworzyć partycję w systemie Windows, należy skorzystać z narzędzia

W dokumentacji technicznej wydajność głośnika połączonego z komputerem wyraża się w jednostce:

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

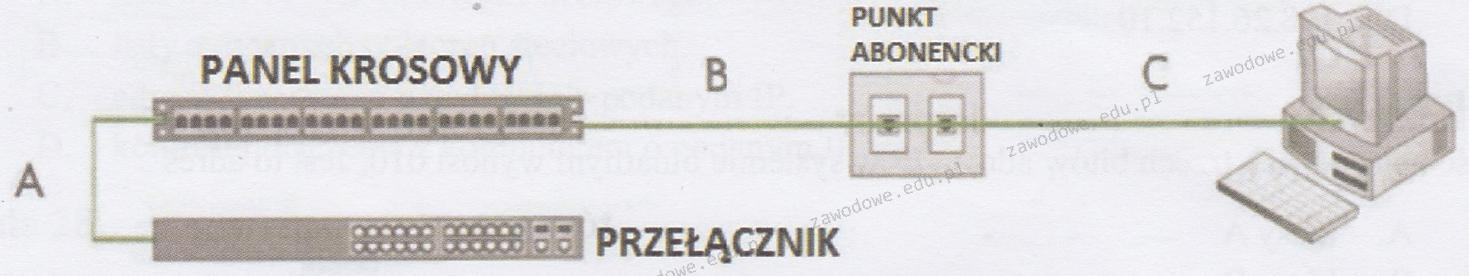

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

Dysk zewnętrzny 3,5" o pojemności 5 TB, służący do przechowywania lub tworzenia kopii zapasowych, posiada obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów należy wykorzystać do połączenia z komputerem, aby uzyskać największą prędkość transmisji?

Autorskie prawo osobiste twórcy do programu komputerowego

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Jakie napięcie zasilające mają moduły pamięci DDR3 SDRAM?

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Zgodnie z normą 802.3u w sieciach FastEthernet 100Base-FX stosuje się

Jaką operację można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, nie przechodząc do trybu uprzywilejowanego, w zakresie dostępu widocznym w ramce?

| Switch> |

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

Który z wymienionych adresów IP nie zalicza się do prywatnych?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Co jest głównym zadaniem protokołu DHCP?