Pytanie 1

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Granice dla obszaru kolizyjnego nie są określane przez porty urządzeń takich jak

W komunikacie o błędzie w systemie, informacja przedstawiana w formacie heksadecymalnym oznacza

Które narzędzie należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Na podstawie wskazanego cennika oblicz, jaki będzie łączny koszt brutto jednego podwójnego natynkowego gniazda abonenckiego w wersji dwumodułowej?

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Na załączonym zdjęciu znajduje się

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

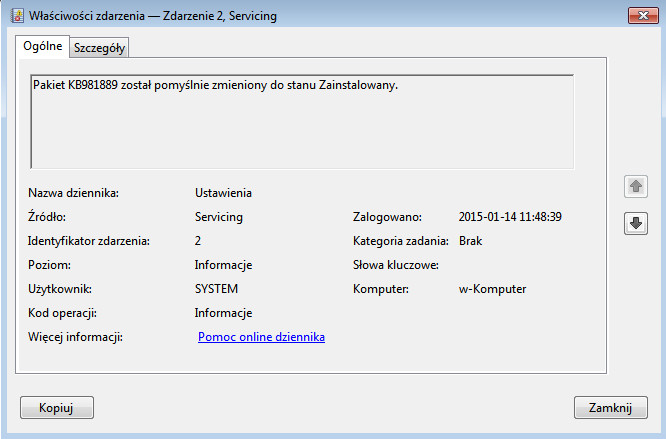

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Na ilustracji zaprezentowano końcówkę wkrętaka typu

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Wykonanie polecenia net localgroup w systemie Windows skutkuje

Jakie czynności nie są realizowane przez system operacyjny?

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

Który z protokołów umożliwia szyfrowane połączenia?

Wykorzystując narzędzie diagnostyczne Tracert, można zidentyfikować trasę do określonego celu. Ile routerów pokonał pakiet wysłany do hosta 172.16.0.99?

Dane przedstawione na ilustracji są rezultatem działania komendy

1 <10 ms <10 ms <10 ms 128.122.198.1 2 <10 ms <10 ms <10 ms NYUGWA-FDDI-2-0.NYU.NET [128.122.253.65] 3 10 ms 10 ms <10 ms ny-nyc-3-H4/0-T3.nysernet.net [169.130.13.17] 4 10 ms 10 ms <10 ms ny-nyc-9-F1/0.nysernet.net [169.130.10.9] 5 <10 ms <10 ms 10 ms ny-pen-1-H4/1/0-T3.nysernet.net [169.130.1.101] 6 <10 ms <10 ms <10 ms sl-pen-11-F8/0/0.sprintlink.net [144.228.60.11] 7 <10 ms 10 ms 10 ms 144.228.180.10 8 10 ms 20 ms 20 ms cleveland1-br2.bbnplanet.net [4.0.2.13] 9 20 ms 30 ms 30 ms cleveland1-br1.bbnplanet.net [4.0.2.5] 10 40 ms 220 ms 221 ms chicago1-br1.bbnplanet.net [4.0.2.9] 11 150 ms 70 ms 70 ms paloalto-br1.bbnplanet.net [4.0.1.1] 12 70 ms 70 ms 70 ms su-pr1.bbnplanet.net [131.119.0.199] 13 70 ms 71 ms 70 ms sunet-gateway.stanford.edu [198.31.10.1] 14 70 ms 70 ms 70 ms Core-gateway.Stanford.EDU [171.64.1.33] 15 70 ms 80 ms 80 ms www.Stanford.EDU [171.64.14.251]

Jaką pamięć RAM można użyć z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, obsługującą maksymalnie 128GB, 4x PCI-E 16x, RAID, USB 3.1, S-2011-V3/ATX?

Do jakiego pomiaru wykorzystywany jest watomierz?

W wyniku wykonania komendy: net user w terminalu systemu Windows, pojawi się

Jaki typ złącza powinien być zastosowany w przewodzie UTP Cat 5e, aby połączyć komputer z siecią?

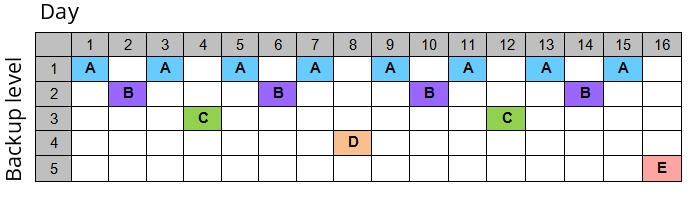

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Według specyfikacji JEDEC standardowe napięcie zasilania modułów RAM DDR3L o niskim napięciu wynosi

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

Jakie narzędzie jest używane do zakończenia skrętki przy pomocy wtyku 8P8C?

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

Jakie adresy mieszczą się w zakresie klasy C?

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

Urządzenie zaprezentowane na ilustracji jest wykorzystywane do zaciskania wtyków:

Do weryfikacji funkcjonowania serwera DNS na systemach Windows Server można zastosować narzędzie nslookup. Jeżeli w poleceniu jako argument zostanie podana nazwa komputera, np. nslookup host.domena.com, to system sprawdzi

Licencja CAL (Client Access License) uprawnia użytkownika do

Na ilustracji zaprezentowano kabel

Który protokół jest wykorzystywany do konwersji między adresami IP publicznymi a prywatnymi?