Pytanie 1

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

Wykorzystanie polecenia net accounts w konsoli systemu Windows, które ustawia maksymalny okres ważności hasła, wymaga zastosowania opcji

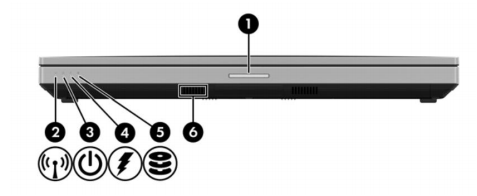

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Kontrola pasma (ang. bandwidth control) w switchu to funkcjonalność

W systemie Windows, który obsługuje przydziały dyskowe, użytkownik o nazwie Gość

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

Aby zatrzymać wykonywanie programu zapisanego w pliku wsadowym Windows do momentu naciśnięcia dowolnego klawisza, należy zastosować komendę

Umowa, na podstawie której użytkownik ma między innymi dostęp do kodu źródłowego oprogramowania w celu jego analizy i ulepszania, to licencja

Diagnostykę systemu Linux można przeprowadzić używając polecenia

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 8 On-line CPU(s) list: 0-7 Thread(s) per core: 2 Core(s) per socket: 4 Socket(s): 1 NUMA node(s): 1 Vendor ID: GenuineIntel CPU family: 6 Model: 42 Stepping: 7 CPU MHz: 1600.000 BogoMIPS: 6784.46 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 256K L3 cache: 8192K NUMA node0 CPU(s): 0-7

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Do obserwacji stanu urządzeń w sieci wykorzystywane jest oprogramowanie operujące na podstawie protokołu

W systemie Windows harmonogram zadań umożliwia przypisanie

Podczas pracy komputera nastąpił samoczynny twardy reset. Przyczyną resetu najprawdopodobniej jest

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

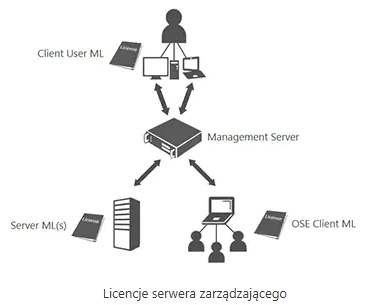

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

NAT64 (Network Address Translation 64) to proces, który dokonuje mapowania adresów

Podaj adres rozgłoszeniowy dla podsieci 86.10.20.64/26?

Serwer DNS pełni rolę

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Dane dotyczące kont użytkowników w systemie Linux są przechowywane w pliku

Liczba 100110011 zapisana w systemie ósemkowym wynosi

Jak nazywa się identyfikator, który musi być jednakowy, aby urządzenia sieciowe mogły współpracować w danej sieci bezprzewodowej?

Czy możesz wskazać, jak wygląda zapis maski podsieci /23 w systemie dziesiętnym, wiedząc, że pierwsze 23 bity z 32-bitowej liczby binarnej to jedynki, a pozostałe to zera? Każdemu z kolejnych 8 bitów odpowiada jedna liczba dziesiętna?

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Komputer K1 jest połączony z interfejsem G0 rutera, a komputer K2 z interfejsem G1 tego samego urządzenia. Na podstawie danych przedstawionych w tabeli, określ właściwy adres bramy dla komputera K2.

| Interfejs | Adres IP | Maska |

|---|---|---|

| G0 | 172.16.0.1 | 255.255.0.0 |

| G1 | 192.168.0.1 | 255.255.255.0 |

Moduł w systemie Windows, który odpowiada za usługi informacyjne w Internecie, to

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Elementem, który umożliwia wymianę informacji pomiędzy procesorem a magistralą PCI-E, jest

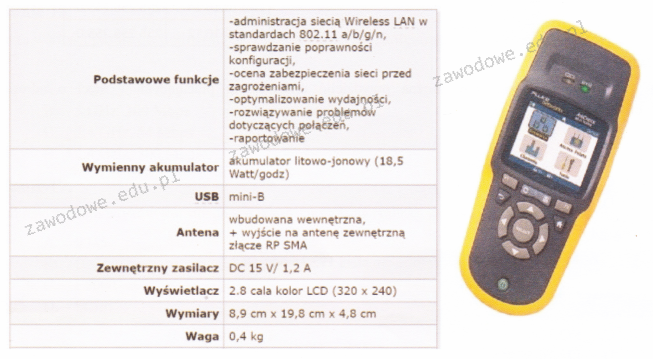

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

Thunderbolt to interfejs