Pytanie 1

W przypadku dłuższego nieużytkowania drukarki atramentowej, pojemniki z tuszem powinny

Wynik: 36/40 punktów (90,0%)

Wymagane minimum: 20 punktów (50%)

W przypadku dłuższego nieużytkowania drukarki atramentowej, pojemniki z tuszem powinny

Która z usług umożliwia centralne zarządzanie identyfikacjami, uprawnieniami oraz zasobami w sieci?

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Aby zintegrować komputer z siecią LAN, należy użyć interfejsu

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

Firma Dyn, której serwery DNS zostały zaatakowane, przyznała, że część tego ataku … miała miejsce z użyciem różnych urządzeń podłączonych do sieci. Ekosystem kamer, czujników i kontrolerów określany ogólnie jako 'Internet rzeczy' został wykorzystany przez cyberprzestępców jako botnet − sieć maszyn-zombie. Jakiego rodzaju atak jest opisany w tym cytacie?

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Narzędzie w systemie Windows umożliwiające monitorowanie prób logowania do systemu to dziennik

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Jaki protokół warstwy aplikacji jest wykorzystywany do zarządzania urządzeniami sieciowymi poprzez sieć?

Pierwszą usługą, która jest instalowana na serwerze, to usługa domenowa w Active Directory. W trakcie instalacji kreator automatycznie poprosi o zainstalowanie usługi serwera.

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Jaki jest pełny adres do logowania na serwer FTP o nazwie ftp.nazwa.pl?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Do jakiego celu służy program fsck w systemie Linux?

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Jednym z programów ochronnych, które zabezpieczają system przed oprogramowaniem, które bez zgody użytkownika zbiera i przesyła jego dane osobowe, numery kart kredytowych, informacje o odwiedzanych stronach WWW, hasła oraz używane adresy e-mail, jest aplikacja

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Numer przerwania przypisany do karty sieciowej został zapisany w systemie binarnym jako 10101. Ile to wynosi w systemie dziesiętnym?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

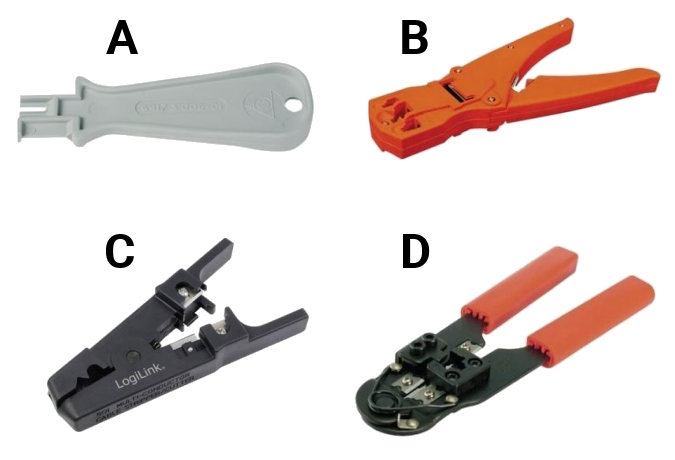

Który z przyrządów służy do usuwania izolacji?

Jak nazywa się protokół używany do przesyłania wiadomości e-mail?

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

Przydzielaniem adresów IP w sieci zajmuje się serwer

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Na ilustracji pokazano tylną część panelu

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

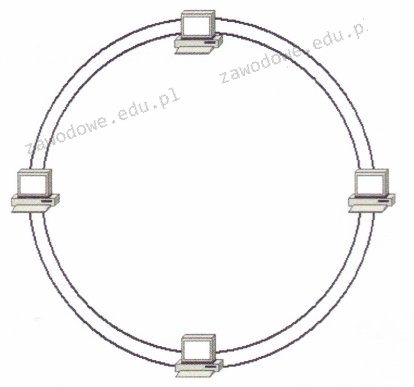

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Wykonanie polecenia fsck w systemie Linux spowoduje

Symbolika tego procesora wskazuje na

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

Tusz w żelu wykorzystywany jest w drukarkach

Administrator sieci LAN dostrzegł przełączenie w tryb awaryjny urządzenia UPS. To oznacza, że wystąpiła awaria systemu

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Aby w systemie Windows Professional ustawić czas pracy drukarki oraz uprawnienia drukowania, należy skonfigurować

Jakie polecenie należy wprowadzić w wierszu polecenia systemów Windows Server, aby zaktualizować dzierżawy adresów DHCP oraz przeprowadzić rejestrację nazw w systemie DNS?