Pytanie 1

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie składniki systemu komputerowego muszą być usuwane w wyspecjalizowanych zakładach przetwarzania ze względu na obecność niebezpiecznych substancji lub chemicznych pierwiastków?

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?

Które z poniższych poleceń w systemie Linux NIE pozwala na przeprowadzenie testów diagnostycznych sprzętu komputerowego?

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Jaką topologię fizyczną charakteryzuje zapewnienie nadmiarowych połączeń między urządzeniami sieciowymi?

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?

Podczas monitorowania aktywności sieciowej zauważono, że na adres serwera przesyłano tysiące zapytań DNS w każdej sekundzie z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego był atak typu

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Aby uporządkować dane pliku na dysku twardym, zapisane w klastrach, które nie sąsiadują ze sobą, tak aby znajdowały się w sąsiadujących klastrach, należy przeprowadzić

Która funkcja przełącznika zarządzalnego umożliwia kontrolę przepustowości każdego z wbudowanych portów?

Funkcja failover usługi DHCP umożliwia

Tester strukturalnego okablowania umożliwia weryfikację

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

Jaką cechę posiada przełącznik sieciowy?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

SuperPi to aplikacja używana do oceniania

Jakie polecenie w systemie Linux rozpoczyna weryfikację dysku oraz pozwala na usunięcie jego usterek?

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |

W systemie Windows dany użytkownik oraz wszystkie grupy, do których on przynależy, posiadają uprawnienia "odczyt" do folderu XYZ. Czy ten użytkownik będzie mógł zrealizować operacje

Jakie polecenie w systemach operacyjnych Windows służy do prezentacji konfiguracji interfejsów sieciowych?

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Na ilustracji ukazano złącze zasilające

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Przedstawiony na ilustracji symbol oznacza

Aby możliwe było przekierowanie drukowanego dokumentu na dysk twardy, należy w opcjach konfiguracyjnych drukarki wybrać drukowanie do portu

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Jakie medium transmisyjne nosi nazwę 100BaseTX i jaka jest maksymalna prędkość danych, która może być w nim osiągnięta?

W systemie Linux do wyświetlania treści pliku tekstowego służy polecenie

W systemie Linux prawa dostępu do katalogu są ustawione w formacie rwx--x--x. Jaką liczbę odpowiadają tę konfigurację praw?

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Typ systemu plików, który nie obsługuje tworzenia wewnętrznego rejestru zmian, zwanego księgowaniem, to

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Klawiatura działa prawidłowo dopiero po wystartowaniu systemu w trybie standardowym. Co to sugeruje?

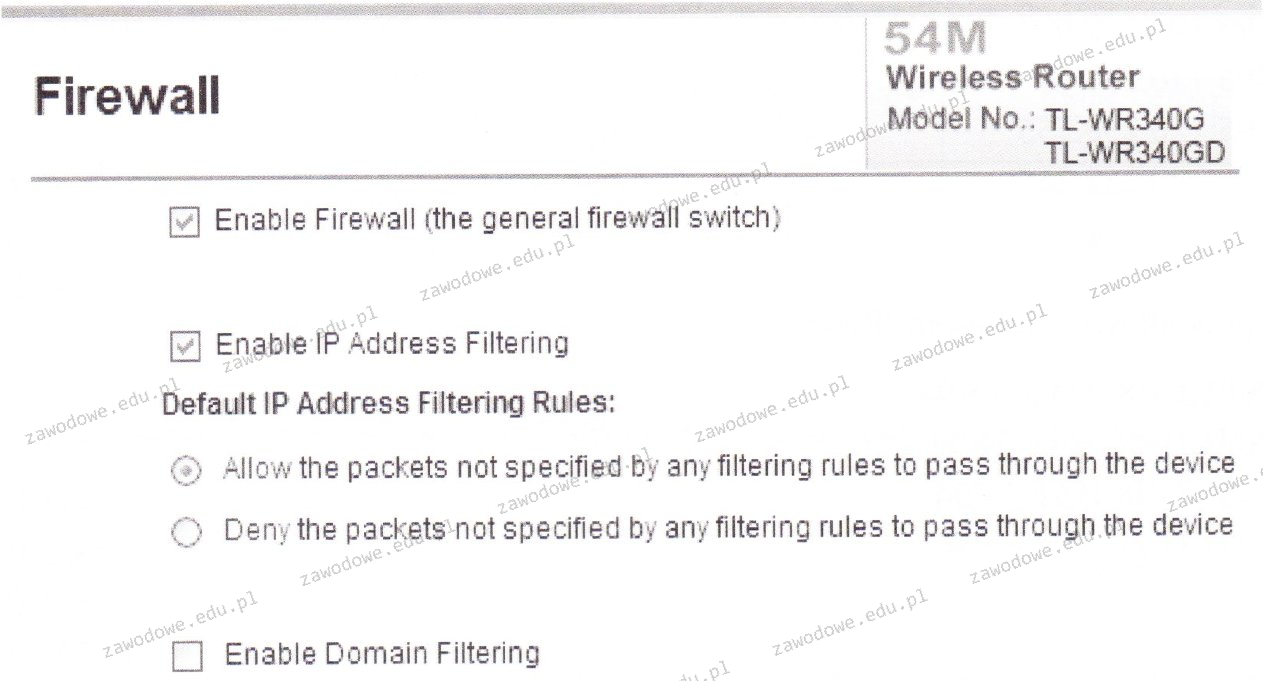

Na rysunku poniżej przedstawiono ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

W standardzie IEEE 802.3af metoda zasilania różnych urządzeń sieciowych została określona przez technologię

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

Przedstawione narzędzie jest przeznaczone do