Pytanie 1

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

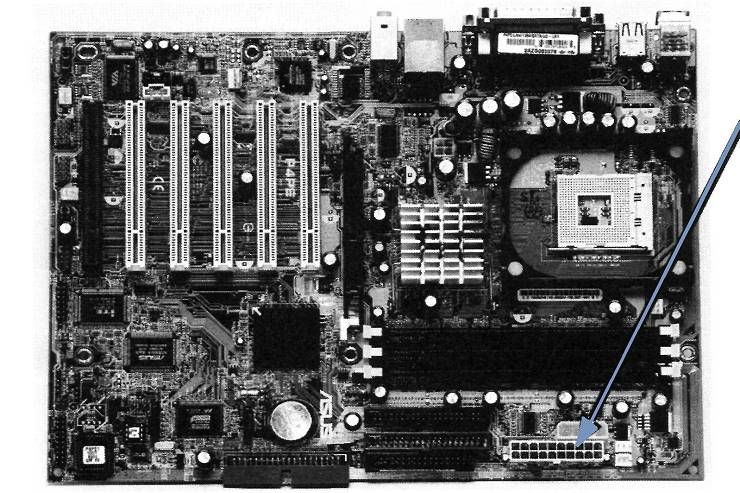

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Czym wyróżniają się procesory CISC?

Jakie narzędzie służy do delikatnego wygięcia blachy obudowy komputera i przykręcenia śruby montażowej w trudno dostępnych miejscach?

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

W serwisie komputerowym dokumentem zawierającym informacje o sprzęcie, opis usterki, datę zgłoszenia i dane klienta jest

Jakie materiały eksploatacyjne wykorzystuje się w drukarce laserowej?

Obudowa oraz wyświetlacz drukarki fotograficznej są mocno zabrudzone. Jakie środki należy zastosować, aby je oczyścić bez ryzyka uszkodzenia?

Licencja Windows OEM nie umożliwia wymiany

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby skonfigurować wolumin RAID 5 w serwerze, wymagane jest co najmniej

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

Wskaż właściwą formę maski podsieci?

Jakie urządzenie ma za zadanie utrwalenie tonera na papierze w trakcie drukowania z drukarki laserowej?

Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

Które z zaleceń jest nieodpowiednie dla konserwacji skanera płaskiego?

Która z macierzy RAID opiera się na replikacji dwóch lub więcej dysków twardych?

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Do wykonania końcówek kabla UTP wykorzystuje się wtyczkę

Do akumulatora w jednostce ALU wprowadzono liczbę dziesiętną 253. Jak wygląda jej reprezentacja binarna?

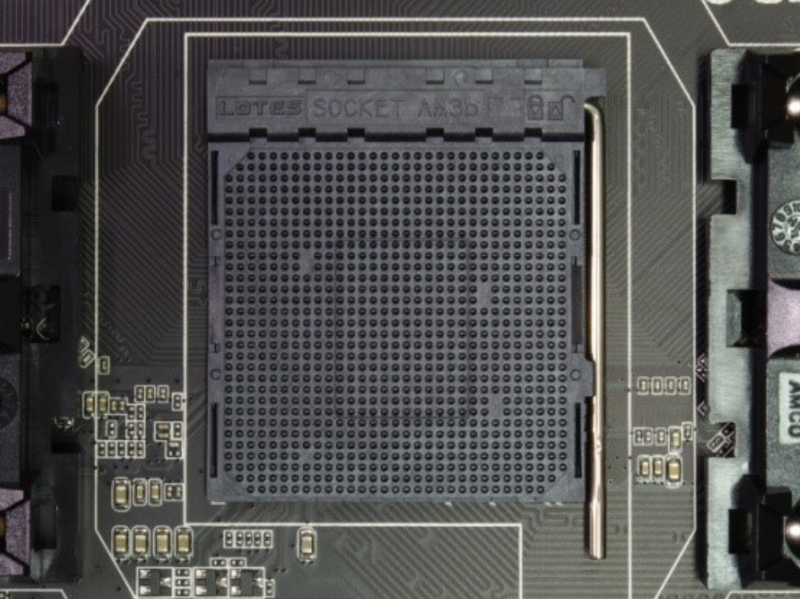

Na płycie głównej wyposażonej w gniazdo przedstawione na zdjęciu można zainstalować procesor

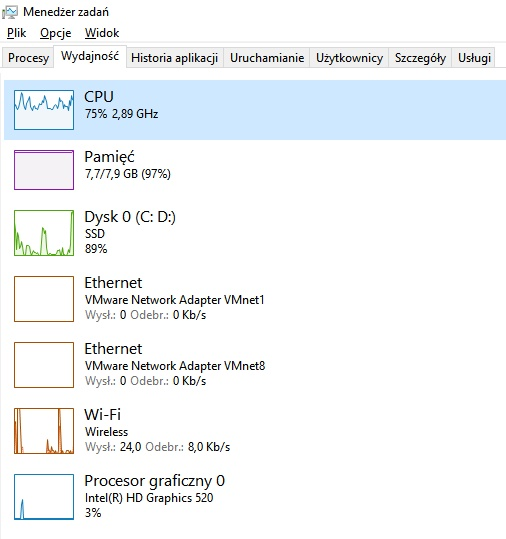

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

Wyjście audio dla słuchawek lub głośników minijack na karcie dźwiękowej oznaczone jest jakim kolorem?

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Na zdjęciu ukazano złącze zasilające

Rysunek obrazuje zasadę działania drukarki

Diagnozowanie uszkodzonych komponentów komputera przez sprawdzenie stanu wyjściowego układu cyfrowego umożliwia

Oblicz całkowity koszt za realizację poniższych czynności serwisowych, przy założeniu, że stawka za jedną roboczogodzinę wynosi 120,00 zł netto, a podatek VAT wynosi 23%.

| LP | Zrealizowane czynności serwisowe | Ilość roboczogodzin |

|---|---|---|

| 1. | Diagnozowanie usterki | 0,2 |

| 2. | Wymiana zasilacza | 0,5 |

| 3. | Przygotowanie drukarki do eksploatacji | 0,6 |

| 4. | Konserwacja urządzenia drukującego | 1,0 |

| 5. | Sprawdzanie po zakończeniu naprawy | 0,2 |

Jakie urządzenie aktywne pozwoli na podłączenie do sieci lokalnej za pomocą kabla UTP 15 komputerów, drukarki sieciowej oraz rutera?

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?