Pytanie 1

Aby zmienić ustawienia konfiguracyjne Menu Start oraz paska zadań w systemie Windows, która przystawka powinna być wykorzystana?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Aby zmienić ustawienia konfiguracyjne Menu Start oraz paska zadań w systemie Windows, która przystawka powinna być wykorzystana?

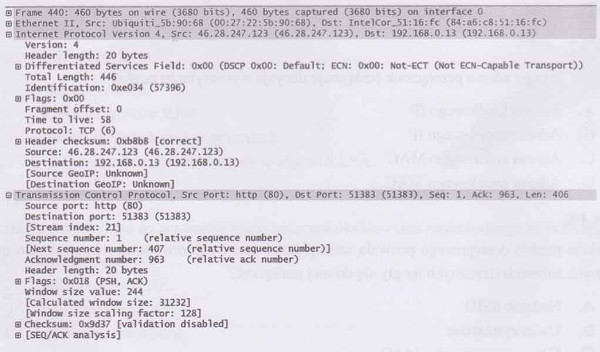

Na podstawie analizy pakietów sieciowych, określ adres IP oraz numer portu, z którego urządzenie otrzymuje odpowiedź?

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

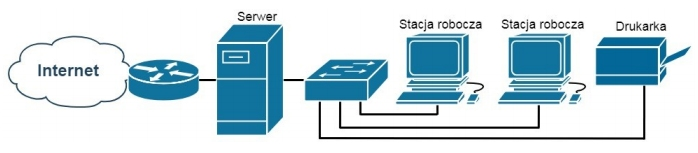

Która funkcja serwera Windows umożliwia użytkownikom końcowym sieci pokazanej na rysunku dostęp do Internetu?

Który program umożliwia sprawdzanie stanów portów i wykonuje próby połączeń z nimi?

Na skutek użycia polecenia ipconfig uzyskano konfigurację przedstawioną na ilustracji. Jaki jest adres IP stacji roboczej, która została poddana testom?

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Realtek RTL8168C(P)/8111C(P)

PCI-E Gigabit Ethernet NIC

Adres fizyczny. . . . . . . . . . : 00-1F-D0-A5-0B-57

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IP. . . . . . . . . . . . . : 192.168.0.11

Maska podsieci. . . . . . . . . . : 255.255.255.0

Brama domyślna. . . . . . . . . . : 192.168.0.1

Serwer DHCP . . . . . . . . . . . : 192.168.0.1

Serwery DNS . . . . . . . . . . . : 62.21.99.95Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Serwer DNS pełni rolę

Aby usunąć konto użytkownika student w systemie operacyjnym Ubuntu, można skorzystać z komendy

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Adres IP urządzenia, zapisany jako sekwencja 172.16.0.1, jest przedstawiony w systemie

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy wyczyścić

Informacja tekstowa KB/Interface error, widoczna na wyświetlaczu komputera podczas BIOS POST od firmy AMI, wskazuje na problem

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Program testujący wydajność sprzętu komputerowego to

Zadania systemu operacyjnego nie obejmują

Aby sprawdzić dostępną przestrzeń na dysku twardym w systemie Linux, można wykorzystać polecenie

Jak nazywa się standard podstawki procesora bez nóżek?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Thunderbolt jest typem interfejsu:

Najbardziej rozwinięty tryb funkcjonowania portu równoległego zgodnego z normą IEEE-1284, który tworzy dwukierunkową szeregę 8-bitową zdolną do przesyłania zarówno danych, jak i adresów z maksymalną prędkością transmisji wynoszącą 2,3 MB/s oraz umożliwia podłączenie do 64 urządzeń, to

Co oznacza oznaczenie kabla skrętkowego U/FTP?

Najbardziej prawdopodobnym powodem niskiej jakości druku z drukarki laserowej, objawiającym się widocznym rozmazywaniem tonera, jest

Standardowe napięcie zasilające dla modułów pamięci RAM DDR4 wynosi

Jaką licencję musi mieć oprogramowanie, aby użytkownik mógł wprowadzać w nim zmiany?

Na ilustracji widoczne jest urządzenie służące do

Liczba 45(H) przedstawiona w systemie ósemkowym jest równa

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Oblicz całkowity koszt kabla UTP Cat 6, który będzie użyty do połączenia 5 punktów abonenckich z punktem dystrybucji, mając na uwadze, że średnia odległość pomiędzy każdym punktem abonenckim a punktem dystrybucji wynosi 8 m oraz że cena za 1 m kabla wynosi 1 zł. W obliczeniach uwzględnij zapas 2 m kabla na każdy punkt abonencki.

Który typ profilu użytkownika zmienia się i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Na ilustracji ukazano złącze zasilające