Pytanie 1

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najuboższym interfejsem graficznym?

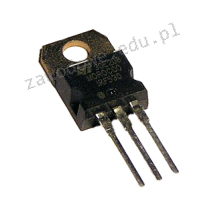

Symbol przedstawiony na ilustracji oznacza produkt

Aby użytkownicy lokalnej sieci mogli korzystać z przeglądarek do odwiedzania stron WWW za pomocą protokołów HTTP i HTTPS, brama internetowa musi umożliwiać ruch na portach

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Jakie polecenie umożliwia wyświetlanie oraz modyfikację tabel translacji adresów IP do adresów fizycznych?

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

Jakie urządzenie wskazujące działa w reakcji na zmiany pojemności elektrycznej?

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

W systemie Linux komenda tty pozwala na

Grupa, w której uprawnienia przypisane członkom mogą dotyczyć tylko tej samej domeny, co nadrzędna grupa lokalna domeny, to grupa

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

Który standard sieci lokalnej określa dostęp do medium w oparciu o token (żeton)?

Podczas skanowania reprodukcji obrazu z magazynu, na skanie obrazu ukazały się regularne wzory, zwane morą. Jakiej funkcji skanera należy użyć, aby usunąć te wzory?

Ile wynosi pojemność jednowarstwowej płyty Blu-ray?

Wskaż błędny sposób podziału dysku MBR na partycje

Jakie medium transmisyjne charakteryzuje się najmniejszym ryzykiem zakłóceń elektromagnetycznych sygnału przesyłanego?

Tusz w żelu wykorzystywany jest w drukarkach

Jakie urządzenie pełni rolę wskaźnika?

Element elektroniczny przedstawiony na ilustracji to:

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Jaki protokół jest stosowany przez WWW?

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W trakcie instalacji systemu Windows Serwer 2022 istnieje możliwość instalacji w trybie Core. Oznacza to, że system zostanie zainstalowany

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Informacja tekstowa KB/Interface error, widoczna na wyświetlaczu komputera podczas BIOS POST od firmy AMI, wskazuje na problem

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Okablowanie pionowe w systemie strukturalnym łączy się

Jeśli jednostka alokacji ma 1024 bajty, to pliki podane w tabeli zajmują na dysku:

Nazwa Wielkość

Ala.exe 50B

Dom.bat 1024B

Wirus.exe 2kB

Domes.exr 350B

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?