Pytanie 1

Które polecenia są charakterystyczne dla instrukcji iteracyjnych?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Które polecenia są charakterystyczne dla instrukcji iteracyjnych?

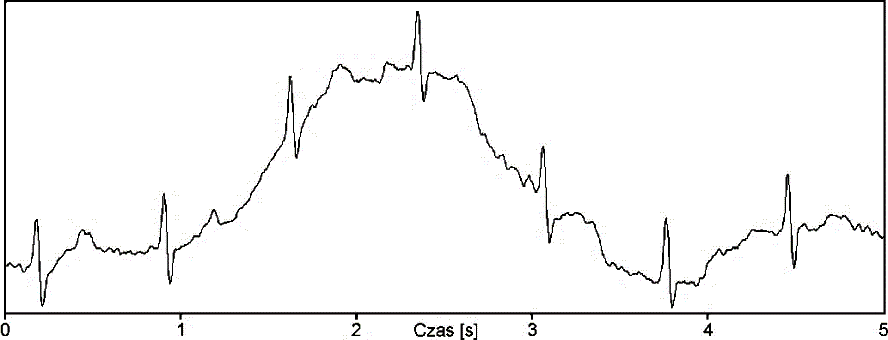

Z elektrokardiogramu wynika, że rytm serca rejestrowany i wskazywany przez elektrokardiograf wynosi

Którego nośnika pamięci należy użyć w komputerze, aby zapewnić najszybsze ładowanie się systemu operacyjnego podczas jego uruchamiania?

Pojęcie „Architektura Harvardska” odnosi się do

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

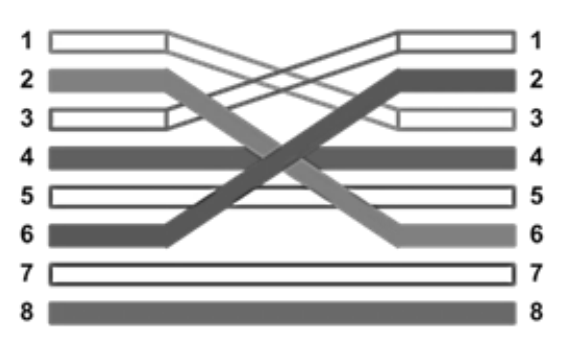

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

Które oznaczenie określa zapis elektryczny aktywności mózgu?

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

Technologie SLI i CrossFire pozwalają na podłączenie dwóch kart

Do kruszenia kamieni w pęcherzu moczowym stosowane są fale

Które polecenie umożliwia śledzenie drogi pakietów w sieci?

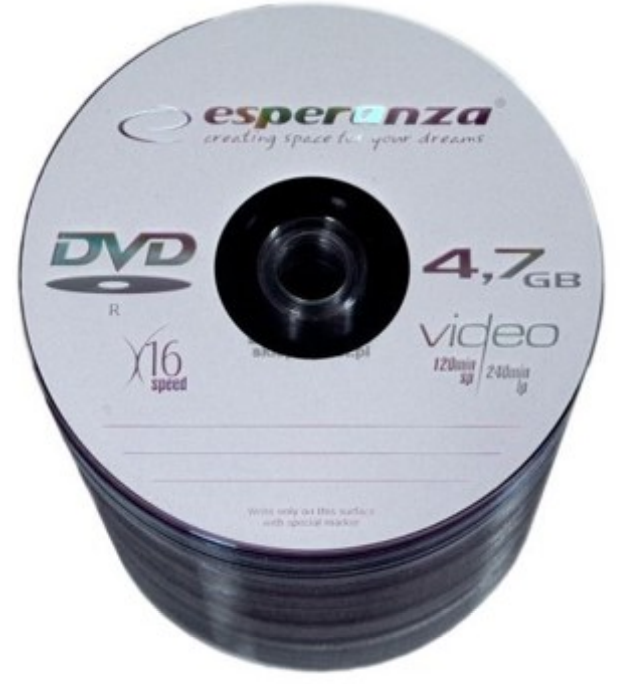

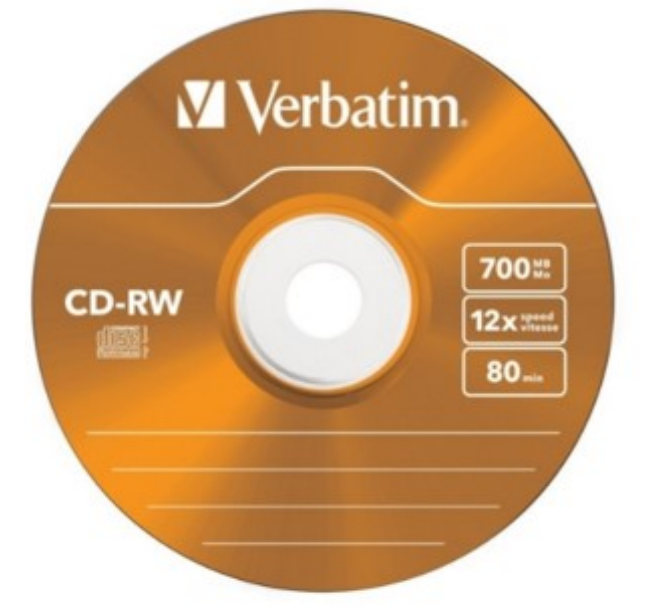

Który z nośników danych umożliwia wielokrotny zapis i ma największą pojemność?

Promieniowanie IR jest wykorzystywane w

Najważniejszą cechą pamięci operacyjnych serwerowych jest ich niezawodność, dlatego powinny być wyposażone w mechanizm kontroli błędów określany skrótem

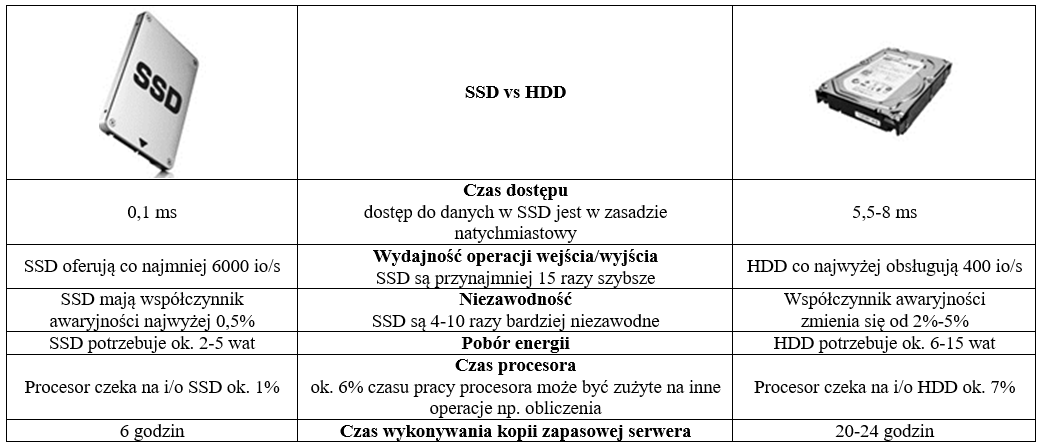

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Urządzenie przedstawione na rysunku jest przeznaczone do

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

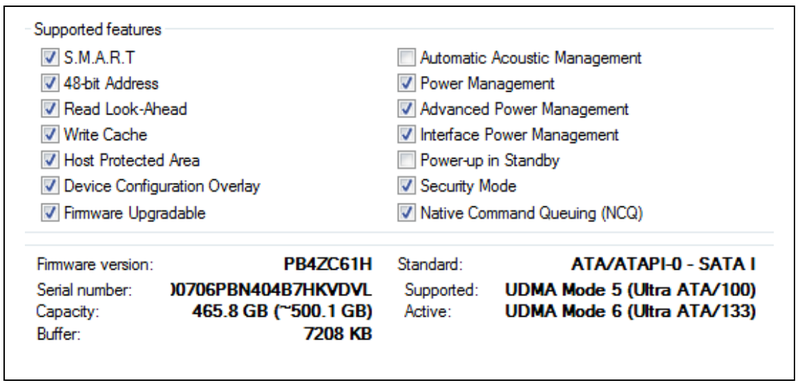

Przedstawiony zrzut ekranu prezentuje parametry

Sterowniki klawiatury, magistral i przerwań są elementami

Technologia dual channel dotyczy pracy dwóch takich samych

W systemie komputerowym przeznaczonym do pracy z dużymi plikami graficznymi należy zwiększyć ilość

Pojedynczy zapis w medycznej bazie danych, zawierający informację na temat jednego pacjenta, nazywa się

| id | imię | nazwisko | adres |

|---|---|---|---|

| 2354 | Konrad | Marek | ul. Kwiatowa15 Krzywodrogi |

| 2355 | Jakub | Warek | ul. Leśna 23 Krzywodrogi |

| 2356 | Krzysztof | Jurek | ul. Polna 14 Krzywodrogi |

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Zaćma fotochemiczna jest wywołana promieniowaniem

Na zdjęciu RTG najjaśniejsze pole stanowi tkanka kostna, przez którą promieniowanie rentgenowskie jest

Do pomiaru częstotliwości rezonansowej generatora kwarcowego w kardiotokografii należy zastosować

Która konsola MMC pozwala na zmianę ważności hasła i ustawienie blokady hasła po określonej liczbie logowań?

Proces, w którym w bazie danych są usuwane nadmiarowe dane, jest określany jako

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w