Pytanie 1

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Na ilustracji zobrazowano

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

W systemie Linux plik posiada uprawnienia ustawione na 765. Grupa przypisana do tego pliku ma możliwość

Do umożliwienia komunikacji pomiędzy sieciami VLAN, wykorzystuje się

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

Jaki jest standardowy port dla serwera HTTP?

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

Podstawowym zadaniem mechanizmu Plug and Play jest

Do czynności konserwacyjnych związanych z użytkowaniem skanera płaskiego należy

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Komenda systemowa ipconfig pozwala na konfigurację

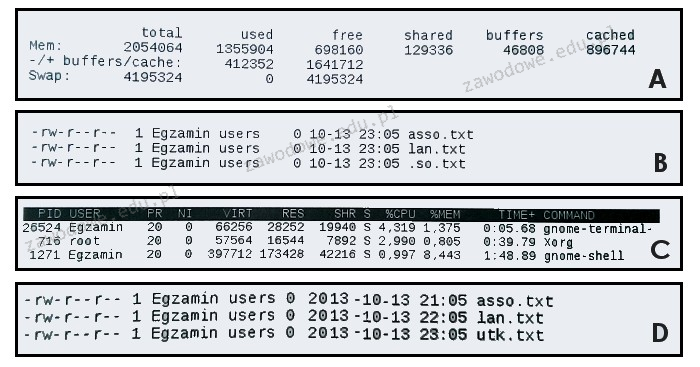

Wynik wykonania polecenia ```ls -l``` w systemie Linux przedstawia poniższy rysunek

W dokumentacji przedstawiono typ systemu plików

| „Zaawansowany system plików zapewniający wydajność, bezpieczeństwo, niezawodność i zaawansowane funkcje niespotykane w żadnej wersji systemu FAT. Na przykład dzięki standardowemu rejestrowaniu transakcji i technikom odzyskiwania danych system gwarantuje spójność woluminów. W przypadku awarii system wykorzystuje plik dziennika i informacje kontrolne do przywrócenia spójności systemu plików." |

Można przywrócić pliki z kosza, korzystając z polecenia

Która z ról w systemie Windows Server umożliwia m.in. zdalną, bezpieczną i uproszczoną instalację systemów operacyjnych Windows na komputerach w sieci?

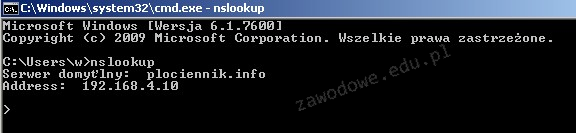

W terminalu systemu operacyjnego wydano komendę nslookup. Jakie dane zostały uzyskane?

Jakie urządzenie peryferyjne komputera służy do wycinania, drukowania oraz frezowania?

Jakim portem domyślnie odbywa się przesyłanie poleceń (command) serwera FTP?

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

Jakie polecenie w systemie Linux przyzna możliwość zapisu dla wszystkich obiektów w /usr/share dla wszystkich użytkowników, nie modyfikując innych uprawnień?

Add-Computer -DomainName egzamin.local -Restart

Przedstawione polecenie jest sposobem dodania stacji roboczej do domeny egzamin.local za pomocą

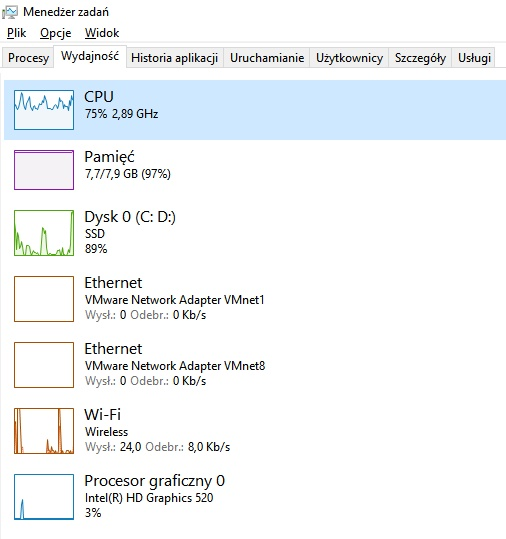

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

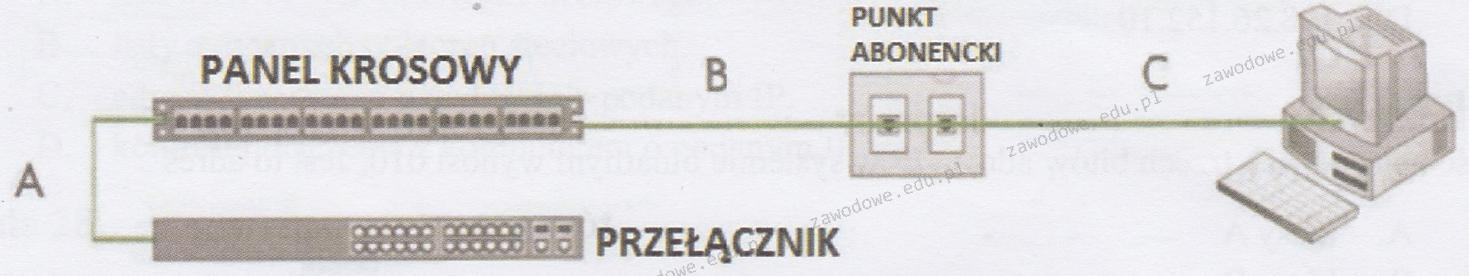

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

Dysk zewnętrzny 3,5" o pojemności 5 TB, służący do przechowywania lub tworzenia kopii zapasowych, posiada obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów należy wykorzystać do połączenia z komputerem, aby uzyskać największą prędkość transmisji?

Jakie znaczenie ma parametr NEXT w kontekście pomiarów systemów okablowania strukturalnego?

Możliwą przyczyną usterki drukarki igłowej może być awaria

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Określ rezultat wykonania zamieszczonego polecenia

| net user Test /expires:12/09/20 |

Wydanie komendy chmod 400 nazwa_pliku w systemie Linux spowoduje, że właściciel pliku