Pytanie 1

Z jakiej puli adresowej usługa APIPA przypisuje adres IP dla komputera z systemem Windows, jeśli w sieci nie funkcjonuje serwer DHCP?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Z jakiej puli adresowej usługa APIPA przypisuje adres IP dla komputera z systemem Windows, jeśli w sieci nie funkcjonuje serwer DHCP?

Czym jest dziedziczenie uprawnień?

Najefektywniejszym sposobem dodania skrótu do aplikacji na pulpitach wszystkich użytkowników w domenie będzie

Licencja na Office 365 PL Personal (na 1 stanowisko, subskrypcja na 1 rok) ESD jest przypisana do

Który z wymienionych protokołów umożliwia nawiązanie szyfrowanego połączenia z witryną internetową?

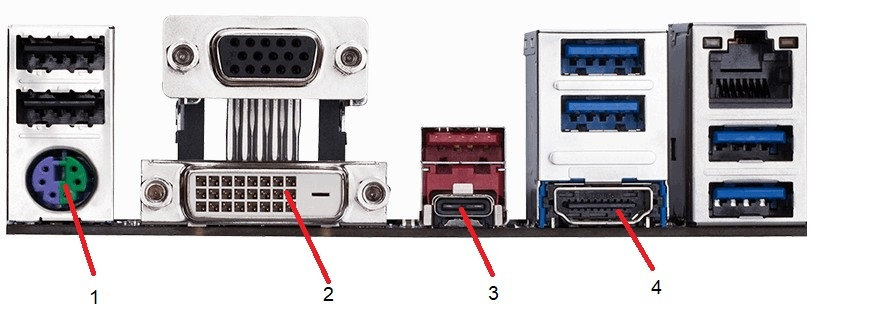

Urządzenie peryferyjne z interfejsem Mini-DIN podłącza się do gniazda oznaczonego na ilustracji

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Jaką kwotę trzeba będzie przeznaczyć na zakup kabla UTP kat.5e do zbudowania sieci komputerowej składającej się z 6 stanowisk, gdzie średnia odległość każdego stanowiska od przełącznika wynosi 9 m? Należy uwzględnić 1 m zapasu dla każdej linii kablowej, a cena za 1 metr kabla to 1,50 zł?

W dokumentacji technicznej głośników komputerowych producent może zamieścić informację, że największe pasmo przenoszenia wynosi

Jaką funkcję należy wybrać, aby utworzyć kopię zapasową rejestru systemowego w edytorze regedit?

IMAP to protokół

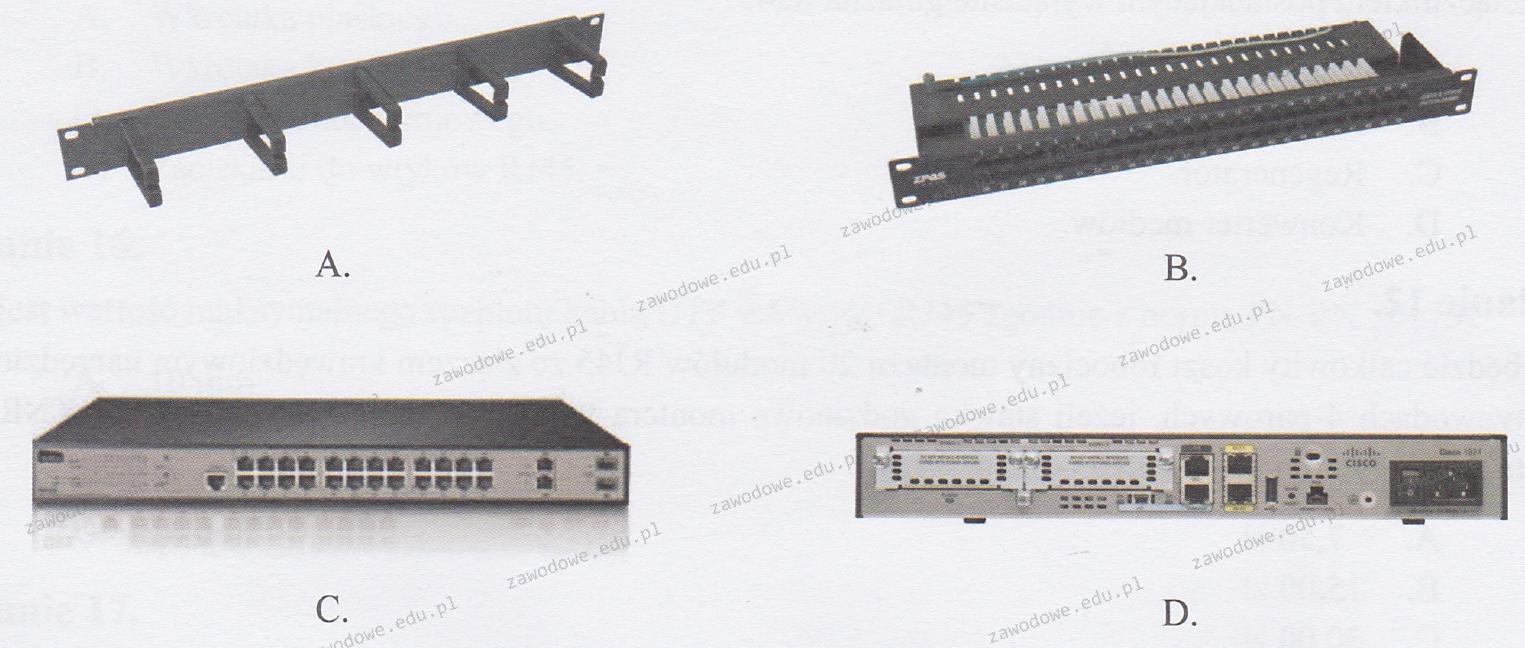

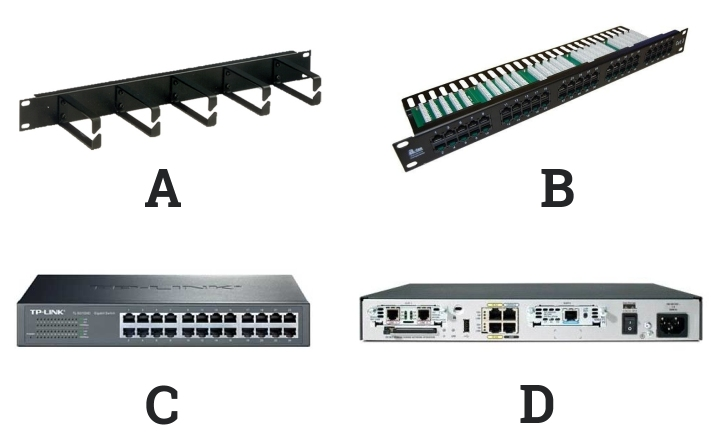

Na którym obrazku przedstawiono panel krosowniczy?

Narzędziem służącym do monitorowania efektywności oraz niezawodności w systemach Windows 7, Windows Server 2008 R2 i Windows Vista jest

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Wskaż program w systemie Linux, który jest przeznaczony do kompresji plików?

AES (ang. Advanced Encryption Standard) to standard szyfrowania, który?

Jakiego materiału używa się w drukarkach tekstylnych?

Tusz w żelu wykorzystywany jest w drukarkach

Urządzenia wykorzystujące port USB 2.0 są zasilane napięciem, którego wartość znajduje się w przedziale

Jak można zaktualizować wprowadzone zmiany w konfiguracji systemu operacyjnego Windows, korzystając z edytora zasad grup?

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

W doborze zasilacza do komputera kluczowe znaczenie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Ile punktów abonenckich (2 x RJ45) powinno być zainstalowanych w biurze o powierzchni 49 m2, zgodnie z normą PN-EN 50167?

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

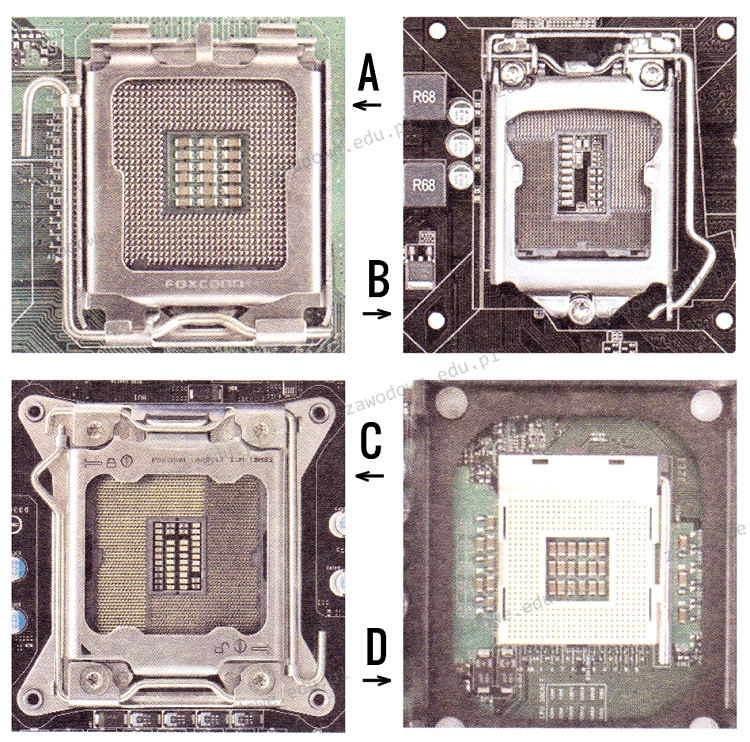

W jakim gnieździe powinien być umieszczony procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Jak nazywa się technika modyfikowania ramek sieciowych polegająca na oznaczaniu ich identyfikatorem sieci VLAN nadawcy według standardu IEEE 802.1Q?

Adapter USB do LPT można zastosować w sytuacji, gdy występuje niezgodność złączy podczas podłączania starszych modeli

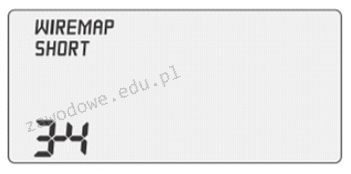

Na ilustracji pokazano wynik pomiaru okablowania. Jaką interpretację można nadać temu wynikowi?

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Na którym schemacie znajduje się panel krosowniczy?

W zestawieniu przedstawiono istotne parametry techniczne dwóch typów interfejsów. Z powyższego wynika, że SATA w porównaniu do ATA charakteryzuje się

| Table Comparison of parallel ATA and SATA | ||

|---|---|---|

| Parallel ATA | SATA 1.5 Gb/s | |

| Bandwidth | 133 MB/s | 150 MB/s |

| Volts | 5V | 250 mV |

| Number of pins | 40 | 7 |

| Cable length | 18 in. (45.7 cm) | 39 in. (1 m) |

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?