Pytanie 1

Zjawisko refleksji sygnału teletransmisyjnego na końcu przewodu nie występuje w przypadku przewodów

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Zjawisko refleksji sygnału teletransmisyjnego na końcu przewodu nie występuje w przypadku przewodów

Średni czas dostępu to miara czasu

Który rodzaj licencji umożliwia użytkownikom uruchamianie programu w dowolnym celu, kopiowanie oraz modyfikowanie i publikowanie własnych poprawionych wersji kodu źródłowego?

Jaki zakres częstotliwości jest stosowany do przesyłania dźwięku w telefonie analogowym w standardowym kanale telefonicznym?

Serwer, który przyjmuje polecenia SIP od klientów i przekazuje odpowiedzi kierujące ich do innych zestawów adresów SIP, to serwer

Który z poniższych protokołów jest klasyfikowany jako protokół wektora odległości?

Jaki parametr długiej linii jest związany z indukcyjnością oraz pojemnością między przewodnikami?

Modulacja, która polega na jednoczesnej zmianie amplitudy oraz fazy sygnału nośnego, gdzie każda modyfikacja fali nośnej koduje czterobitową informację wejściową, definiowana jest jako modulacja

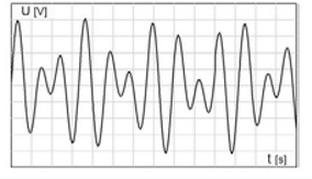

Oscylogram przedstawia sygnalizację

Podczas montażu sieci teleinformatycznej, gdy pracownik wierci otwory w ścianach, powinien on mieć

Jaka jest najwyższa prędkość przesyłu danych w urządzeniach działających według standardu 802.11g?

Orientacja elektrycznego wektora fali radiowej w stosunku do powierzchni ziemi, wynikająca z konstrukcji anteny oraz jej sposobu ustawienia, zwana jest

Jakie urządzenie w pasywnych systemach sieci optycznych pełni rolę multipleksera i demultipleksera?

Na podstawie fragmentu karty katalogowej wskaż szybkość transmisji danych do abonenta, którą oferuje modem/ruter ADSL2+.

| ⊙ Specifications: | |

|---|---|

| Product Description | 150Mbps Wireless N ADSL2+ Modem Router |

| WAN Port | 1 RJ11 DSL Port |

| LAN Ports | 4 10/100Mbps RJ45 LAN Ports |

| IEEE Standards | IEEE 802.11 802.3u |

| ADSL Standards | Full-rate ANSI T1.413 Issue 2, ITU-T G.992.1 (G.DMT) Annex A, ITU-T G.992.2 (G.Lite) Annex A, ITU-T G.994.1 (G.hs) |

| ADSL2 Standards | ITU-T G.992.3 (G.dmt.bis) Annex A/L/M, ITU-T G.992.4 (G.lite.bis) Annex A |

| ADSL2+ Standards | ITU-T G.992.5 Annex A/L/M |

| Data Rates | Downstream: Up to 24Mbps Upstream: Up to 3.5Mbps (with Annex M enabled) |

| ATM / PPP Protocols | ATM Forum UNI 3.1/4.0 PVC (up to 8PVCs) ATM Adaptation Layer Type 5 (AAL5) ATM QoS (Traffic Shaping) Bridged and routed Ethernet encapsulation VC and LLC based multiplexing PPP over Ethernet (RFC2516) PPP over ATM (RFC 2364) |

Aby obliczyć przepływność strumienia cyfrowego generowanego przez pojedynczą rozmowę telefoniczną, należy pomnożyć liczbę bitów przypadających na jedną próbkę przez

Deformacje tłumieniowe są następstwem

Który z poniższych adresów może być zastosowany do komunikacji w sieci publicznej?

Jak odbywa się zasilanie urządzeń różnych kategorii w przypadku braku napięcia, biorąc pod uwagę wymaganą pewność dostarczania energii elektrycznej w serwerowni?

Przy użyciu reflektometru OTDR nie da się określić w włóknach optycznych wartości

Dla jakiej długości fali tłumienność światłowodu osiąga najniższą wartość?

Funkcja CLIR w systemie ISDN pozwala na

Jakie jest zastosowanie programu traceroute w systemach Unix?

Funkcja BIOS-u First/Second/Third/Boot Device (Boot Seąuence) umożliwia określenie kolejności, w jakiej będą odczytywane

Która funkcja w systemie ISDN pozwala na powiadomienie użytkownika o nadchodzącym połączeniu oraz umożliwia jego odebranie po wcześniejszym zakończeniu lub wstrzymaniu bieżącej rozmowy?

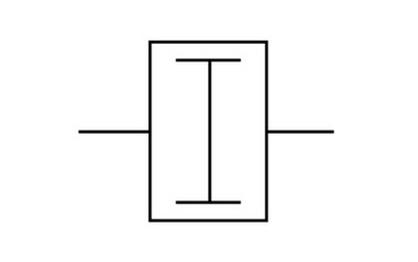

Przedstawiony symbol graficzny jest oznaczeniem

Który z protokołów służy jako protokół sygnalizacyjny w technologii VoIP?

Który rodzaj adresowania jest obecny w protokole IPv4, ale nie występuje w IPv6?

Jaką opcję w menu Setup systemu Phoenix – Award BIOS należy wybrać, aby skonfigurować temperaturę procesora, przy której aktywowane jest ostrzeżenie (warning)?

Umożliwienie użycia fal nośnych o identycznych częstotliwościach w komórkach sieci telefonii komórkowej, które nie sąsiedzą ze sobą, stanowi przykład zastosowania zwielokrotnienia

Nawiązanie połączenia pomiędzy urządzeniami końcowymi przed przesłaniem informacji odbywa się w przypadku komutacji

Który z podanych adresów IP stanowi adres pętli zwrotnej dla komputera?

Jak nazywa się faza procesu konwersji analogowo-cyfrowej, która polega na przyporządkowaniu dyskretnym wartości sygnału wejściowego do określonych wartości ciągłych z ograniczonego zestawu?

Która klasa kabla UTP pozwala na przesył danych z prędkością 1000 Mbit/s?

Przyczyną niekontrolowanego zapełniania przestrzeni dyskowej w komputerze może być

Specyfikacja, którego z komputerów opisanych w tabeli, jest zgodna z konfiguracją zalecaną dla instalacji systemu operacyjnego Windows Vista?

| Komputer | Procesor | Pamięć RAM | Wolne miejsce na dysku |

|---|---|---|---|

| I | 800 MHz | 128 MB | 20 GB |

| II | 2,4 GHz | 2 GB | 2 GB |

| III | 1000 MHz | 1 GB | 50 GB |

| IV | 1,2 GHz | 256 MB | 15 GB |

Na podstawie oferty cenowej pewnej telefonii satelitarnej zaproponuj klientowi, dzwoniącemu średnio 1 000 minut miesięcznie, najtańszą taryfę.

| Plany taryfowe | Taryfa A | Taryfa B | Taryfa C | Taryfa D |

| Taryfa miesięczna | 50 € | 100 € | 250 € | 300 € |

| Pakiet tanszych minut | 100/m | 200/m | 800/m | 1 000/m |

| Opłata za minutę w pakiecie | 0,70 € | 0,50 € | 0,30 € | 0,20 € |

| Opłata za dodatkowe minuty | 1,50 € | 1,00 € | 0,50 € | 0,40 € |

Jaką wartość domyślną ma dystans administracyjny dla sieci bezpośrednio połączonych z routerem?

Protokół SNMP opisuje

Który aplet w panelu sterowania systemu MS Windows 10 pozwala na ręczne zaktualizowanie sygnatur zagrożeń w wbudowanym oprogramowaniu antywirusowym systemu?

Licencja umożliwiająca darmowe udostępnianie oprogramowania zawierającego elementy reklamowe to