Pytanie 1

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Thunderbolt to interfejs

Transmisja danych typu półduplex to transmisja

Twórca zamieszczonego programu pozwala na jego darmowe korzystanie tylko w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W wyniku realizacji podanego polecenia ping parametr TTL wskazuje na

C:\Users\Właściciel>ping -n 1 wp.pl

Pinging wp.pl [212.77.98.9] with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=17ms TTL=54

Ping statistics for 212.77.98.9:

Packets: Sent = 1, Received = 1, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 17ms, Maximum = 17ms, Average = 17msJakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Aby zwiększyć bezpieczeństwo osobistych danych podczas przeglądania stron internetowych, warto dezaktywować w ustawieniach przeglądarki

Kopie listy kontaktów telefonu można odzyskać z pliku o rozszerzeniu

Do czego służy narzędzie 'ping' w sieciach komputerowych?

W celu zabezpieczenia komputerów w sieci lokalnej przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

Urządzenie klienckie automatycznie uzyskuje adres IP od serwera DHCP. W sytuacji, gdy serwer DHCP przestanie działać, karcie sieciowej przydzielony zostanie adres IP z przedziału

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Przedstawiony listing zawiera polecenia umożliwiające:

Switch>enable Switch#configure terminal Switch(config)#interface range fastEthernet 0/1-10 Switch(config-if-range)#switchport access vlan 10 Switch(config-if-range)#exit

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Który adres IP jest przypisany do klasy A?

Aby określić długość prefiksu w adresie IPv4, należy ustalić

Która z konfiguracji RAID opiera się na replikacji danych pomiędzy dwoma lub większą liczbą dysków fizycznych?

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

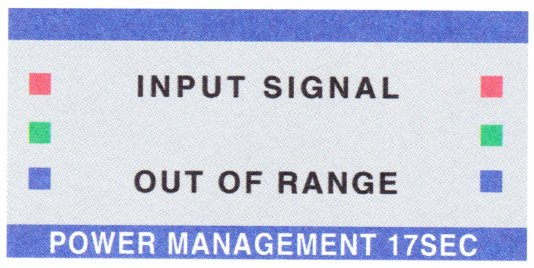

Gdy podłączono sprawny monitor do innego komputera, na ekranie pojawił się komunikat widoczny na rysunku. Co mogło spowodować ten komunikat?

Urządzenie sieciowe działające w drugiej warstwie modelu OSI, które przesyła sygnał do portu połączonego z urządzeniem odbierającym dane na podstawie analizy adresów MAC nadawcy i odbiorcy, to

Jaką rolę pełni protokół DNS?

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Co nie ma wpływu na utratę danych z dysku HDD?

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Internet Relay Chat (IRC) to protokół wykorzystywany do

Jaka będzie suma liczb binarnych 1010 oraz 111, gdy przeliczymy ją na system dziesiętny?

Cienki klient (thin client) to?

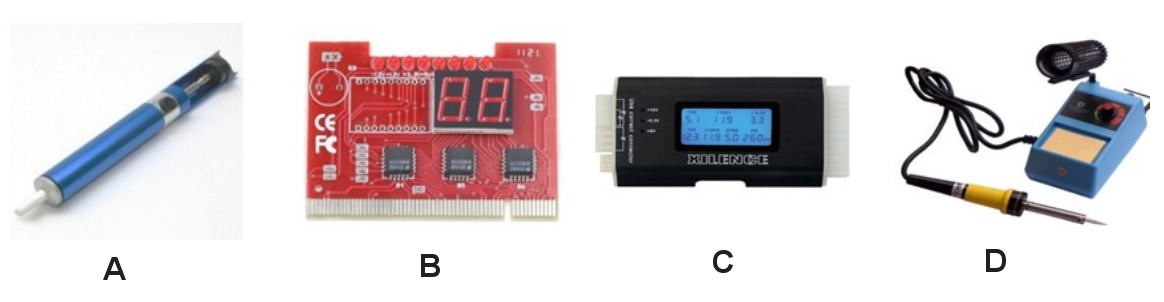

Jakie narzędzie powinno być użyte do uzyskania rezultatów testu POST dla komponentów płyty głównej?

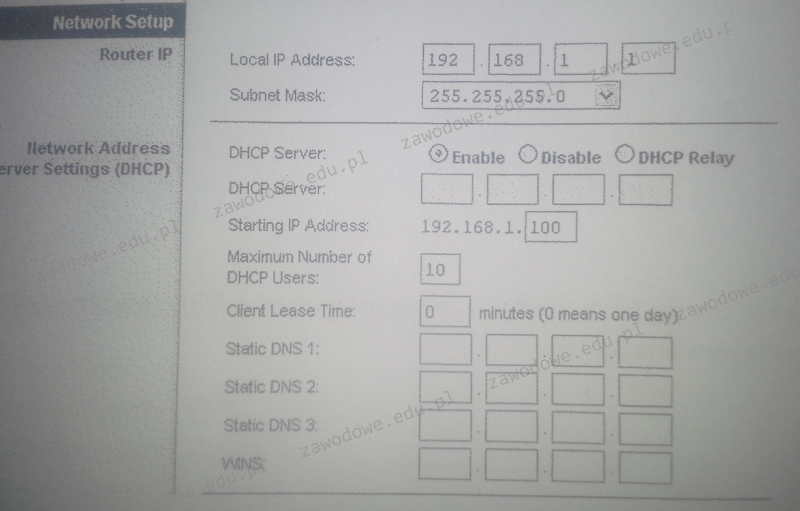

Na przedstawionym zrzucie panelu ustawień rutera można zauważyć, że serwer DHCP

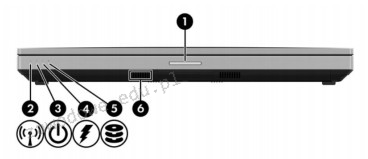

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

Jakie napięcie jest dostarczane przez płytę główną do pamięci typu SDRAM DDR3?

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

W trakcie instalacji systemu Windows Serwer 2022 istnieje możliwość instalacji w trybie Core. Oznacza to, że system zostanie zainstalowany

Jakie urządzenie w sieci lokalnej nie wydziela segmentów sieci komputerowej na kolizyjne domeny?