Pytanie 1

Jakie narzędzie w wierszu poleceń służy do testowania oraz diagnostyki serwerów DNS?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jakie narzędzie w wierszu poleceń służy do testowania oraz diagnostyki serwerów DNS?

Użytkownicy sieci WiFi zauważyli problemy oraz częste zrywanie połączenia z internetem. Co może być przyczyną tej sytuacji?

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

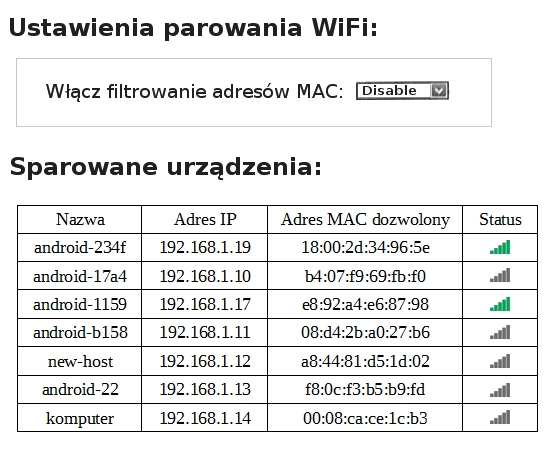

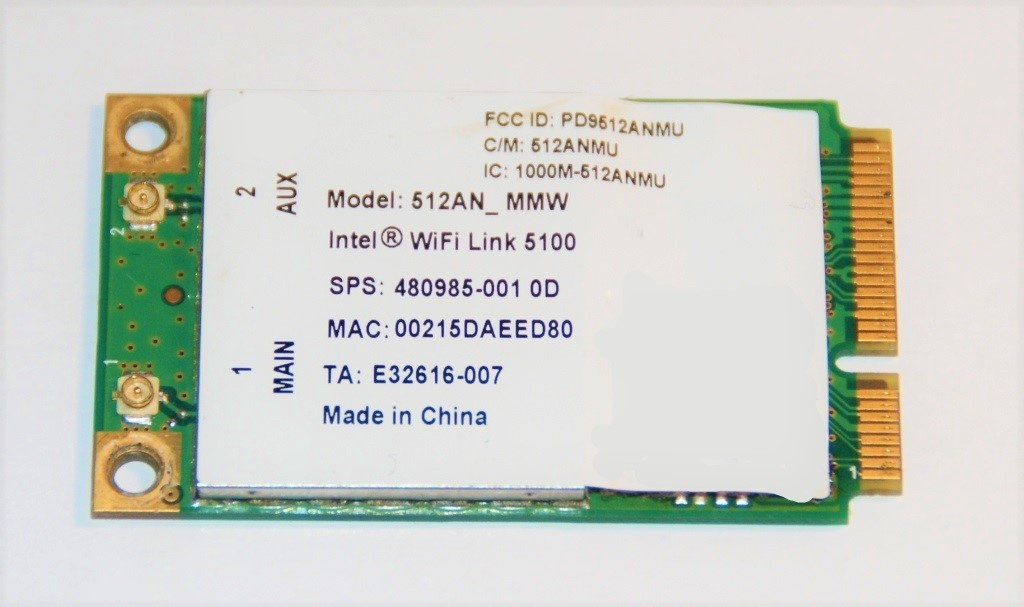

Na rysunku przedstawiono konfigurację urządzenia WiFi. Wskaż, które z poniższych stwierdzeń dotyczących tej konfiguracji jest poprawne?

Tryb działania portu równoległego, oparty na magistrali ISA, pozwalający na transfer danych do 2.4 MB/s, przeznaczony dla skanerów i urządzeń wielofunkcyjnych, to

Aby telefon VoIP działał poprawnie, należy skonfigurować adres

Które zdanie opisujące domenę Windows jest prawdziwe?

Na ilustracji zaprezentowano system monitorujący

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

W celu zabezpieczenia komputerów w sieci lokalnej przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Procesor Intel Core i3 można zamontować w gnieździe

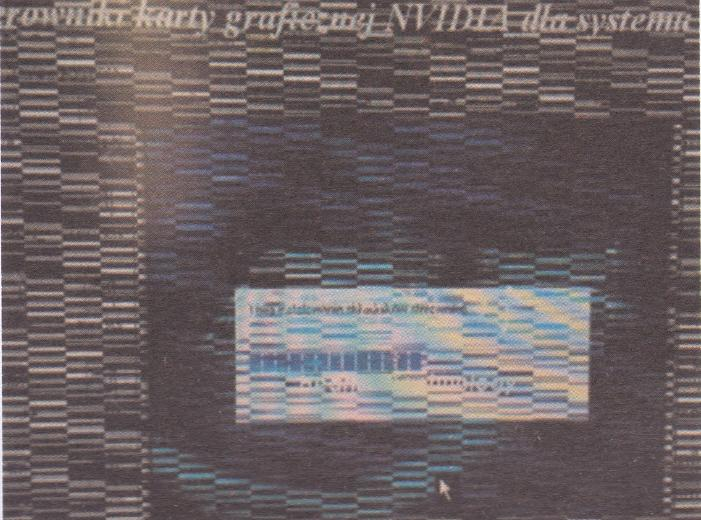

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Jaką wartość dziesiętną ma liczba 11110101(U2)?

Wskaż koszt brutto wykonanych przez serwisanta usług, jeśli do rachunku doliczony jest również koszt dojazdu w wysokości 55,00 zł netto.

| LP | Wykonana usługa | Cena usługi netto w zł | Stawka podatku VAT |

|---|---|---|---|

| 1. | Instalacja/ konfiguracja programu | 10,00 | 23% |

| 2. | Wymiana zasilacza | 40,00 | |

| 3. | Tworzenie kopii zapasowej i archiwizacja danych | 40,00 | |

| 4. | Konfiguracja przełącznika | 25,00 | |

| 5. | Instalacja i konfiguracja skanera | 45,00 |

Aby osiągnąć prędkość przesyłania danych 100 Mbps w sieci lokalnej, wykorzystano karty sieciowe działające w standardzie Fast Ethernet, kabel typu UTP o odpowiedniej kategorii oraz przełącznik (switch) zgodny z tym standardem. Taka sieć jest skonstruowana w topologii

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wskaż nośnik, który w sieciach komputerowych umożliwia najszybszą wymianę danych?

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Który adres IPv4 odpowiada adresowi IPv6 ::1?

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

Toner stanowi materiał eksploatacyjny w drukarce

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

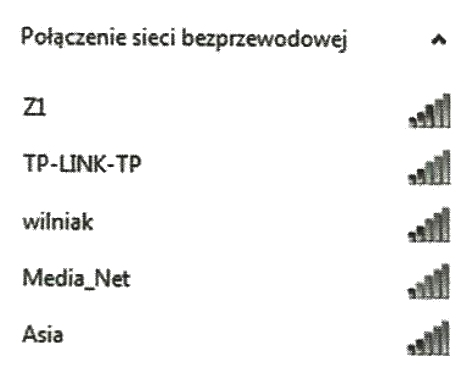

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi, jak przedstawiono na ilustracji. Przy konfiguracji połączenia z siecią Z1 musi wprowadzić

Aby podłączyć kasę fiskalną wyposażoną w złącze komunikacyjne DB-9M do komputera stacjonarnego, należy zastosować przewód

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy:

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

Jak w systemie Windows Professional można ustalić czas działania drukarki oraz jej uprawnienia do drukowania?

Magistrala komunikacyjna PCI ver. 2.2 (Peripheral Component Interconnect) jest standardem magistrali, zgodnie z którym szyna danych ma maksymalną szerokość

Jakość skanowania można poprawić poprzez zmianę

Usługi na serwerze są konfigurowane za pomocą

Na ilustracji przedstawiono

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

Substancją używaną w drukarkach 3D jest

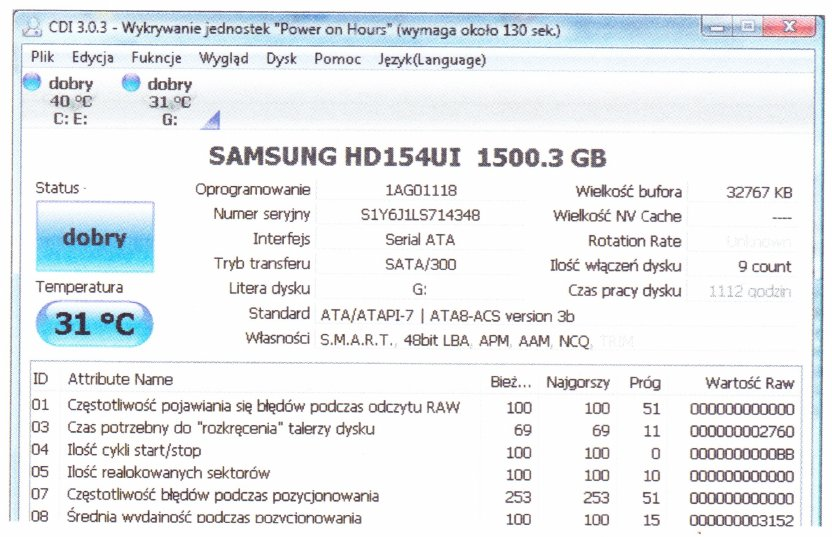

Jednym z typowych symptomów mogących świadczyć o nadchodzącej awarii dysku twardego jest wystąpienie

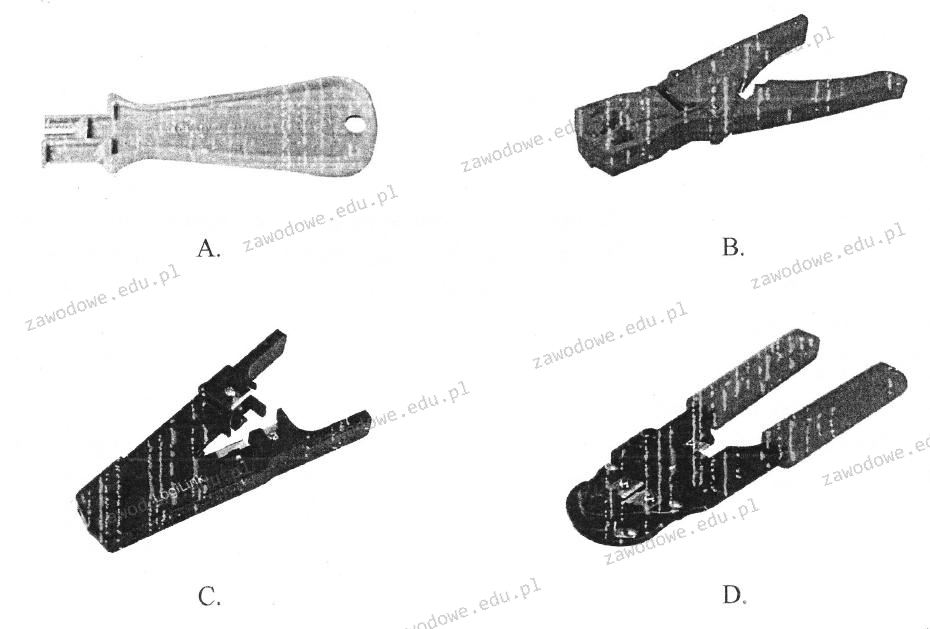

Jaki instrument jest używany do usuwania izolacji?

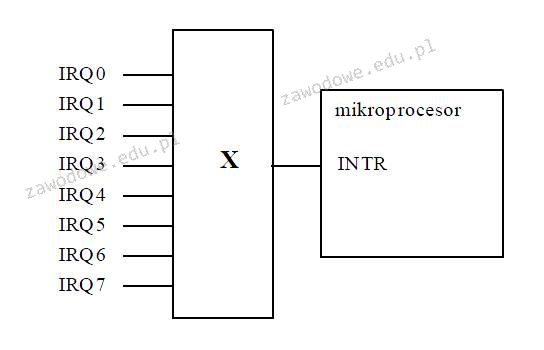

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

Redukcja liczby jedynek w masce pozwoli na zaadresowanie