Pytanie 1

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak nazywa się pamięć podręczną procesora?

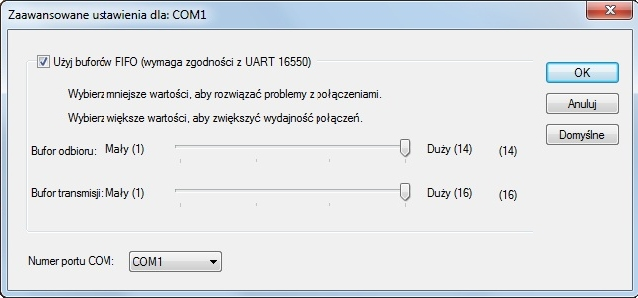

Ustawienia przedstawione na ilustracji odnoszą się do

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Jakie polecenie w systemie Linux pozwala na zarządzanie uprawnieniami do plików oraz katalogów?

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Ile warstw zawiera model ISO/OSI?

W dokumentacji technicznej efektywność głośnika podłączonego do komputera wyraża się w jednostce

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Komunikat "BIOS checksum error" pojawiający się w trakcie startu komputera zazwyczaj wskazuje na

Rysunek ilustruje rezultaty sprawdzania działania sieci komputerowej przy użyciu polecenia

Badanie wp.pl [212.77.100.101] z użyciem 32 bajtów danych: Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=27ms TTL=249

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Zanim przystąpisz do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, powinieneś zweryfikować

Która z usług umożliwia centralne zarządzanie identyfikacjami, uprawnieniami oraz zasobami w sieci?

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

Jakie urządzenie powinno być wykorzystane do pomiaru struktury połączeń w sieci lokalnej?

Jaką drukarkę powinna nabyć firma, która potrzebuje urządzenia do tworzenia trwałych kodów kreskowych oraz etykiet na folii i tworzywach sztucznych?

Urządzenie sieciowe działające w drugiej warstwie modelu OSI, które przesyła sygnał do portu połączonego z urządzeniem odbierającym dane na podstawie analizy adresów MAC nadawcy i odbiorcy, to

Który kolor żyły znajduje się w kablu skrętkowym?

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

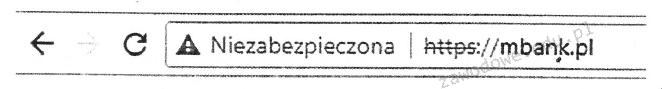

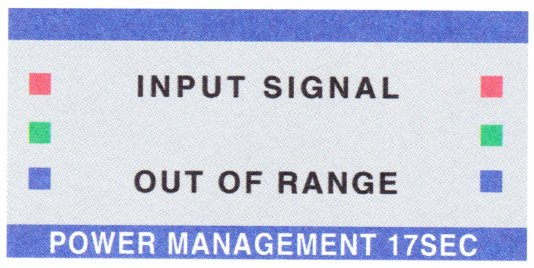

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

SuperPi to aplikacja używana do testowania

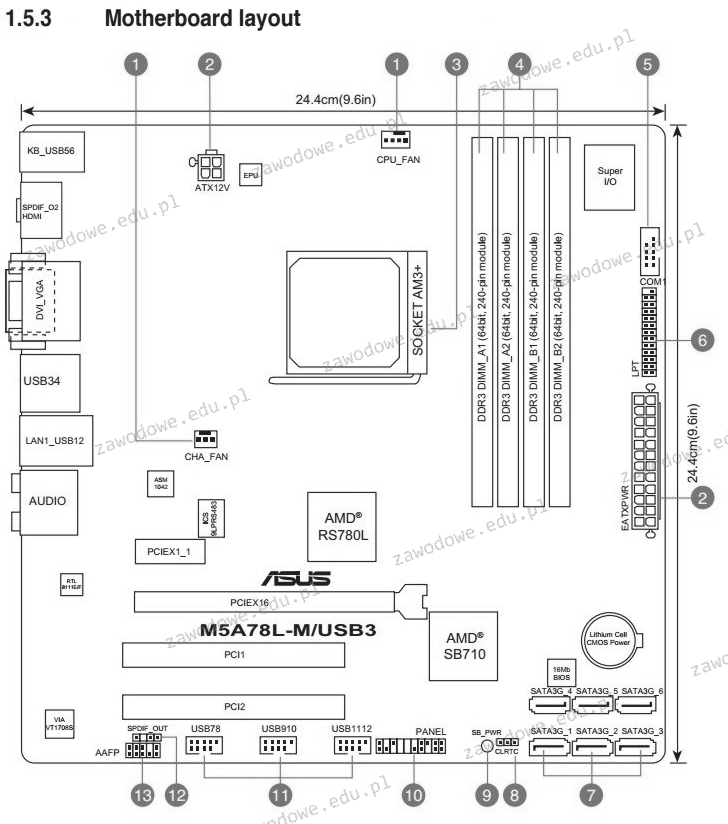

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Czym jest postcardware?

Gdy podłączono sprawny monitor do innego komputera, na ekranie pojawił się komunikat widoczny na rysunku. Co mogło spowodować ten komunikat?

W jaki sposób powinny być skonfigurowane uprawnienia dostępu w systemie Linux, aby tylko właściciel mógł wprowadzać zmiany w wybranym katalogu?

Ile portów USB może być dostępnych w komputerze wyposażonym w tę płytę główną, jeśli nie używa się huba USB ani dodatkowych kart?

Czym jest odwrotność bezstratnego algorytmu kompresji danych?

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia lub opuszczenia konkretnej grupy rozgłoszeniowej?

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

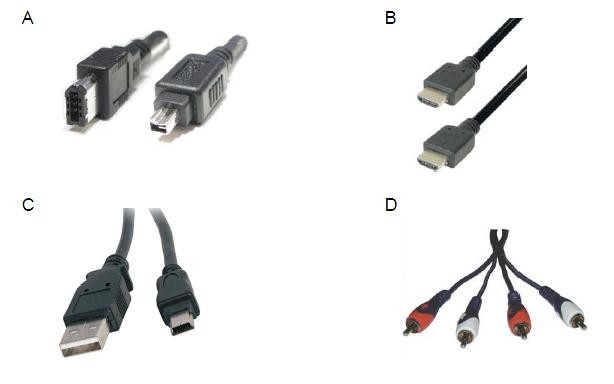

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Standardowo, w systemie Linux, twardy dysk w standardzie SATA jest oznaczany jako

Jaki adres stanowi adres rozgłoszeniowy dla hosta o IP 171.25.172.29 oraz masce sieci 255.255.0.0?