Pytanie 1

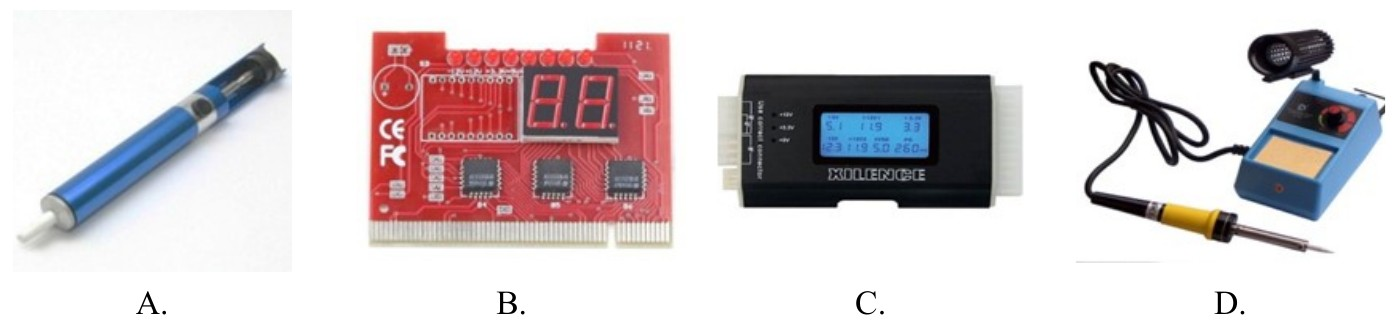

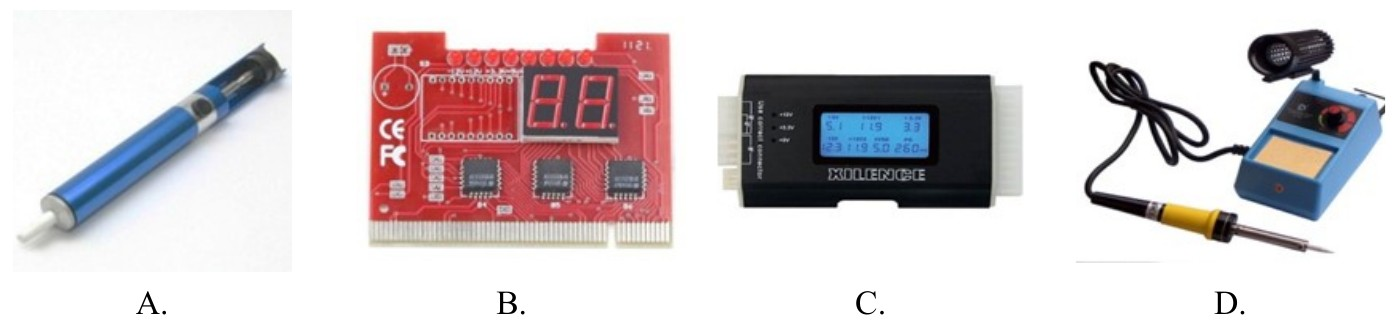

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

W systemie Windows 7 aby skopiować folder c:\test wraz z jego podfolderami na dysk zewnętrzny f:\, należy zastosować polecenie

Czym są programy GRUB, LILO, NTLDR?

Użytkownik systemu Windows może skorzystać z polecenia taskmgr, aby

Na podstawie danych zawartych w tabeli dotyczącej specyfikacji płyty głównej, wskaż maksymalną liczbę kart rozszerzeń, które można zainstalować w magistrali Peripheral Component Interconnect.

Brak odpowiedzi na to pytanie.

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

System Windows 8, w którym wcześniej został utworzony punkt przywracania, doświadczył awarii. Jakie polecenie należy wydać, aby przywrócić ustawienia i pliki systemowe?

Równoważnym zapisem 232 bajtów jest zapis

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

Wszystkie ustawienia użytkowników komputera są przechowywane w gałęzi rejestru oznaczonej akronimem

Interfejs, którego magistrala kończy się elementem przedstawionym na ilustracji, jest typowy dla

W systemie Linux narzędzie iptables wykorzystuje się do

Jaką fizyczną topologię sieci komputerowej przedstawiono na załączonym rysunku?

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Który protokół przesyła datagramy bez gwarancji ich dostarczenia?

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Na diagramie zaprezentowano strukturę

W dokumentacji technicznej efektywność głośnika podłączonego do komputera wyraża się w jednostce

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

Jak można zwolnić miejsce na dysku, nie tracąc przy tym danych?

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

Oblicz koszt realizacji okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego, wliczając wykonanie kabli łączących dla stacji roboczych. Użyto przy tym 50 m skrętki UTP. Każdy punkt abonencki posiada 2 gniazda typu RJ45.

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Która z możliwości konfiguracji ustawień dla użytkownika z ograniczonymi uprawnieniami w systemie Windows jest oferowana przez przystawkę secpol?

Jakie zagrożenie nie jest eliminowane przez program firewall?

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Jak nazywa się protokół, który pozwala na ściąganie wiadomości e-mail z serwera?

Komputery K1, K2, K3, K4 są podłączone do interfejsów przełącznika, które są przypisane do VLAN-ów wymienionych w tabeli. Które z tych komputerów mają możliwość komunikacji ze sobą?

| Nazwa komputera | Adres IP | Nazwa interfejsu | VLAN |

| K1 | 10.10.10.1/24 | F1 | VLAN 10 |

| K2 | 10.10.10.2/24 | F2 | VLAN 11 |

| K3 | 10.10.10.3/24 | F3 | VLAN 10 |

| K4 | 10.10.11.4/24 | F4 | VLAN 11 |

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Jak nazywa się licencja oprogramowania, która pozwala na bezpłatne rozpowszechnianie aplikacji?

W systemie Windows, po dezaktywacji domyślnego konta administratora i ponownym uruchomieniu komputera

Jakie są różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

W celu zbudowania sieci komputerowej w danym pomieszczeniu wykorzystano 25 metrów kabli UTP, 5 gniazd RJ45 oraz odpowiednią liczbę wtyków RJ45 potrzebnych do stworzenia 5 kabli połączeniowych typu patchcord. Jaki jest całkowity koszt zastosowanych materiałów do budowy sieci? Ceny jednostkowe materiałów są przedstawione w tabeli.

| Material | Jednostka miary | Cena |

|---|---|---|

| Skrętka UTP | m | 1 zł |

| Gniazdo RJ45 | szt. | 10 zł |

| Wtyk RJ45 | szt. | 50 gr |

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

Wskaż adresy podsieci, które powstaną po podziale sieci o adresie 172.16.0.0/22 na 4 równe podsieci.

Która pula adresów IPv6 jest odpowiednikiem adresów prywatnych w IPv4?

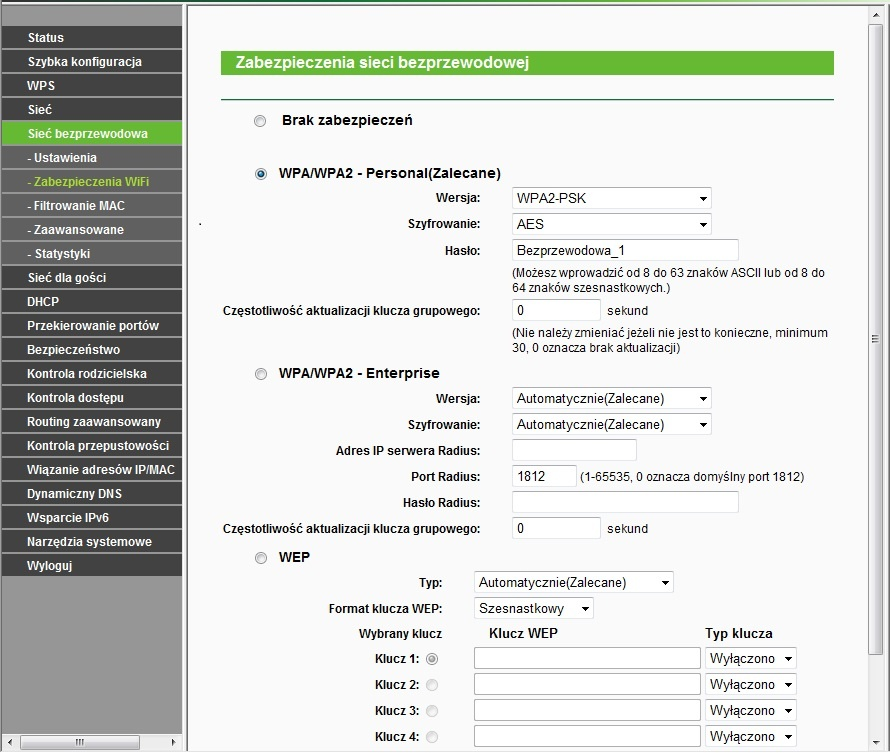

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona