Pytanie 1

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Jakie informacje można uzyskać za pomocą polecenia uname -s w systemie Linux?

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Jaki jest maksymalny transfer danych napędu CD przy prędkości x42?

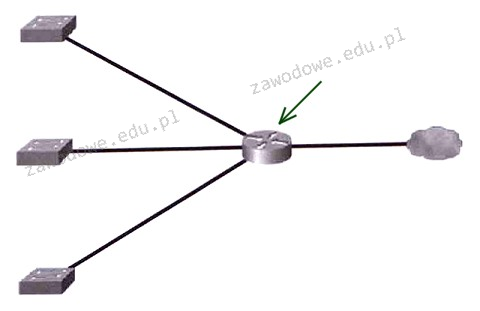

Na schemacie przedstawiono sieć o strukturze

Adres IP (ang. Internet Protocol Address) to

Jaką długość w bitach ma adres logiczny IPv6?

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?

Jaką liczbę komputerów można zaadresować w sieci z maską 255.255.255.224?

Jaką usługę trzeba zainstalować na serwerze, aby umożliwić korzystanie z nazw domen?

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

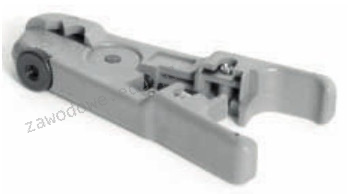

Na ilustracji zaprezentowane jest urządzenie do

Jaki protokół do obsługi poczty elektronicznej pozwala na przykład na przechowywanie odebranych e-maili na serwerze, zarządzanie różnymi folderami, usuwanie wiadomości oraz przenoszenie ich pomiędzy folderami?

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Aby możliwe było zorganizowanie pracy w wydzielonych logicznie mniejszych podsieciach w sieci komputerowej, należy ustawić w przełączniku

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Aby zapewnić łączność urządzenia mobilnego z komputerem za pośrednictwem interfejsu Bluetooth, konieczne jest

Które z podanych poleceń w systemie Windows XP umożliwia sprawdzenie aktualnej konfiguracji adresu IP systemu Windows?

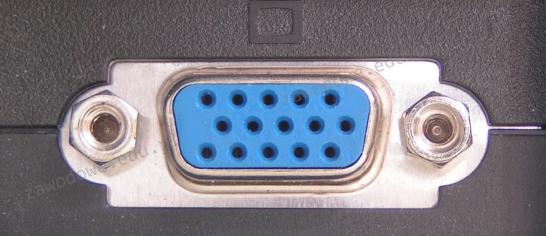

Złącze widoczne na ilustracji służy do podłączenia

ARP (Address Resolution Protocol) to protokół, który pozwala na konwersję

Cookie to plik

Mysz komputerowa z interfejsem bluetooth pracującym w klasie 2 ma teoretyczny zasięg do

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

Jaki pakiet powinien zostać zainstalowany na serwerze Linux, aby umożliwić stacjom roboczym z systemem Windows dostęp do plików i drukarek udostępnianych przez ten serwer?

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

W kontekście adresacji IPv6, użycie podwójnego dwukropka służy do

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Zarządzanie partycjami w systemach operacyjnych Windows

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Taśma drukująca stanowi kluczowy materiał eksploatacyjny w drukarce

Zasilacz UPS o mocy nominalnej 480 W nie powinien być używany do zasilania

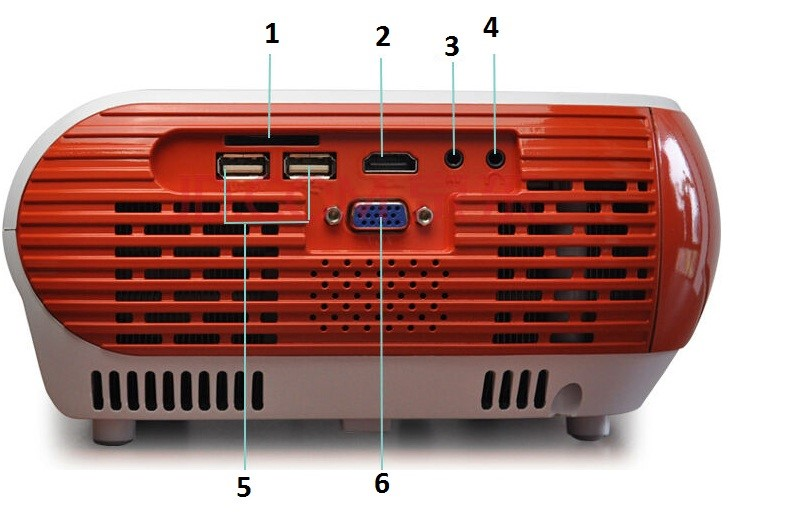

Aby za pomocą złącza DE-15F podłączyć przedstawiony projektor do laptopa, należy wykorzystać gniazdo oznaczone numerem

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?