Pytanie 1

Protokół transportowy bezpołączeniowy to

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Protokół transportowy bezpołączeniowy to

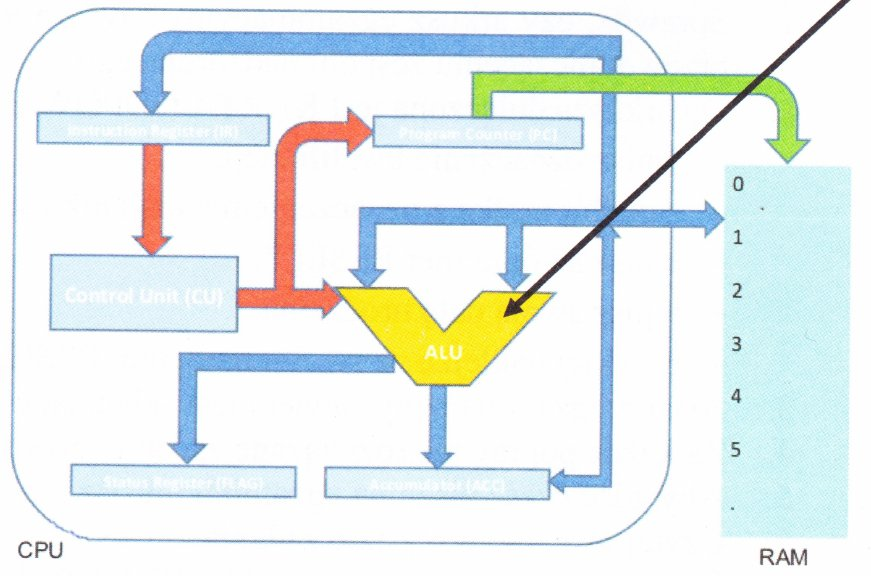

Na diagramie mikroprocesora zidentyfikowany strzałką blok odpowiada za

Sprzęt, który umożliwia konfigurację sieci VLAN, to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby zainstalować usługę Active Directory w systemie Windows Server, konieczne jest uprzednie zainstalowanie oraz skonfigurowanie serwera

Aby przeprowadzić aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykorzystać komendę

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Jakie jest oznaczenie sieci, w której funkcjonuje host o IP 10.10.10.6 klasy A?

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

Sprzęt sieciowy umożliwiający połączenie pięciu komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

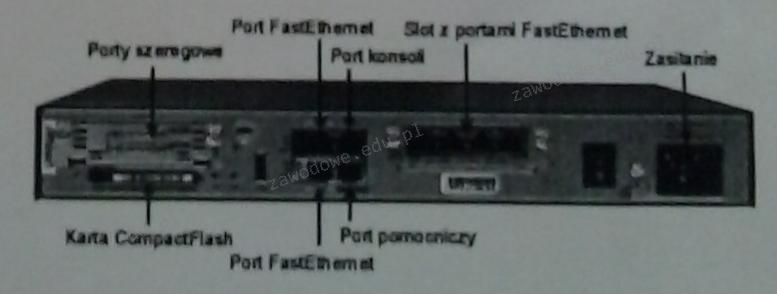

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

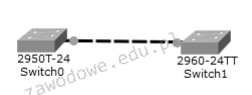

Symbol okablowania przedstawiony na diagramie odnosi się do kabla

Jaką technologię wykorzystuje się do uzyskania dostępu do Internetu oraz odbioru kanałów telewizyjnych w formie cyfrowej?

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.

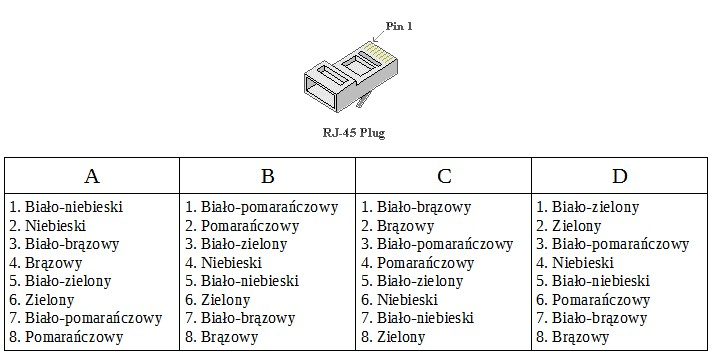

Jakie jest usytuowanie przewodów w złączu RJ45 według schematu T568A?

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Który z protokołów służy do synchronizacji czasu?

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Adres IP 192.168.2.0/24 został podzielony na cztery mniejsze podsieci. Jaką maskę mają te nowe podsieci?

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

W systemie Windows za pomocą komendy assoc można

Które z poniższych poleceń w systemie Linux NIE pozwala na przeprowadzenie testów diagnostycznych sprzętu komputerowego?

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Rozmiar plamki na ekranie monitora LCD wynosi

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

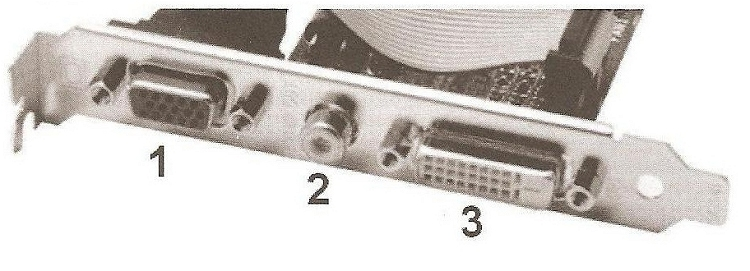

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Jaką zmianę sygnału realizuje konwerter RAMDAC?

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

Jakim modułem pamięci RAM, który jest zgodny z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/8xDDR4 2133, ECC, maksymalnie 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć?

Program Mozilla Firefox jest udostępniany na zasadach licencji

Jakie protokoły pełnią rolę w warstwie transportowej modelu ISO/OSI?

Jakie narzędzie pozwala na zarządzanie menadżerem rozruchu w systemach Windows od wersji Vista?

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie