Pytanie 1

Oprogramowanie przypisane do konkretnego komputera lub jego podzespołów, które uniemożliwia instalację na nowym sprzęcie zakupionym przez tego samego użytkownika, to

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Oprogramowanie przypisane do konkretnego komputera lub jego podzespołów, które uniemożliwia instalację na nowym sprzęcie zakupionym przez tego samego użytkownika, to

Jaką postać ma liczba dziesiętna 512 w systemie binarnym?

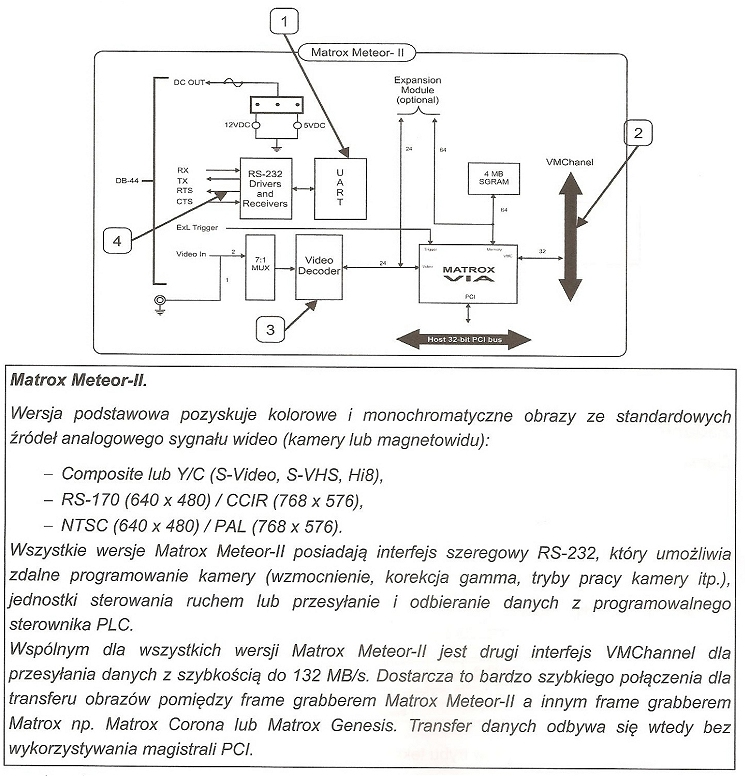

Który z elementów oznaczonych numerami od 1 do 4, ukazanych na schemacie blokowym frame grabbera oraz opisanych w fragmencie dokumentacji technicznej, jest odpowiedzialny za wymianę danych z innymi urządzeniami przetwarzającymi obraz wideo, unikając zbędnego obciążenia magistrali PCI?

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Która karta graficzna nie będzie kompatybilna z monitorem, który posiada złącza pokazane na zdjęciu, przy założeniu, że do podłączenia monitora nie użyjemy adaptera?

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Wskaż interfejsy płyty głównej widoczne na rysunku.

Które z zaleceń jest nieodpowiednie dla konserwacji skanera płaskiego?

Co oznacza skrót RAID w kontekście pamięci masowej?

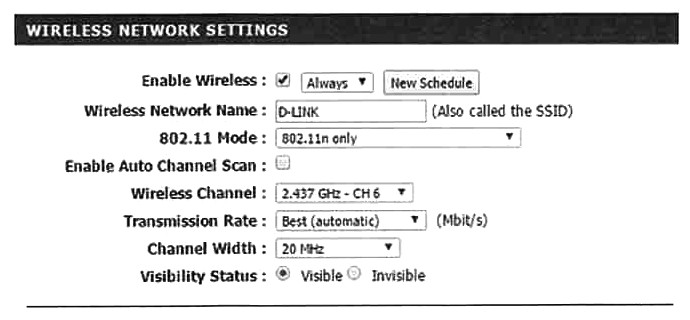

Który z parametrów w ustawieniach punktu dostępowego jest odpowiedzialny za login używany podczas próby połączenia z bezprzewodowym punktem dostępu?

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

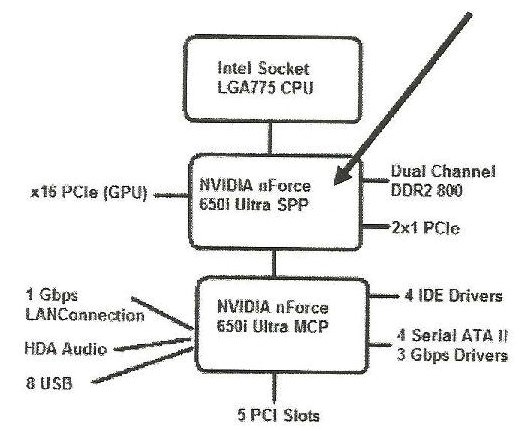

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

Jakie liczby należy wprowadzić na klawiaturze telefonu podłączonego do bramki VoIP po wcześniejszym wpisaniu *** w celu ustawienia adresu bramy domyślnej sieci?

Element elektroniczny przedstawiony na ilustracji to:

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

W standardzie IEEE 802.3af metoda zasilania różnych urządzeń sieciowych została określona przez technologię

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Za przypisanie czasu procesora do wyznaczonych zadań odpowiada

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Jak nazywa się pamięć podręczną procesora?

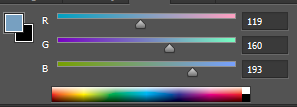

Przedstawiony na rysunku kolor zapisany w modelu RGB, w systemie szesnastkowym będzie zdefiniowany następująco

Podłączona mysz bezprzewodowa sprawia, że kursor na ekranie nie porusza się płynnie i „skacze”. Co może być przyczyną tego problemu?

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Adapter USB do LPT można zastosować w sytuacji, gdy występuje niezgodność złączy podczas podłączania starszych modeli

Po uruchomieniu komputera, procedura POST wskazuje 512 MB RAM. Natomiast w ogólnych właściwościach systemu operacyjnego Windows wyświetla się wartość 480 MB RAM. Jakie są powody tej różnicy?

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Wskaż złącze, które nie jest stosowane w zasilaczach ATX?

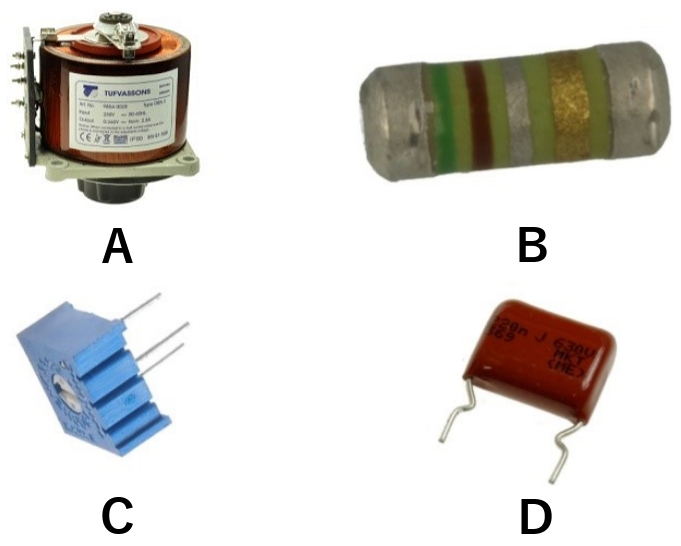

Wskaż ilustrację przedstawiającą kondensator stały?

Rysunek obrazuje zasadę działania drukarki

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

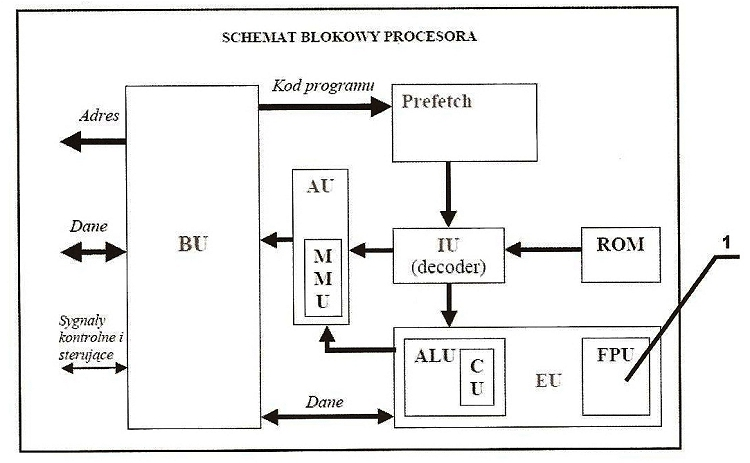

Element oznaczony numerem 1 w schemacie blokowym procesora pełni funkcję

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?