Pytanie 1

Co jest głównym zadaniem protokołu DHCP?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Co jest głównym zadaniem protokołu DHCP?

Wydanie w systemie Windows komendy ```ATTRIB -S +H TEST.TXT``` spowoduje

Na ilustracji zaprezentowano końcówkę wkrętaka typu

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

Jakie urządzenie służy do pomiaru wartości mocy zużywanej przez komputerowy zestaw?

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

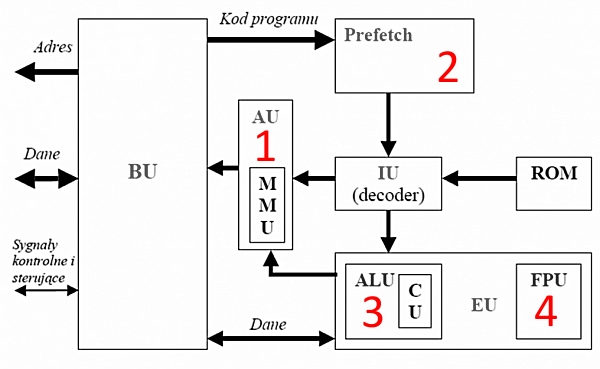

Koprocesor arytmetyczny, który pełni funkcję wykonywania obliczeń na liczbach zmiennoprzecinkowych w mikroprocesorze, został na schemacie oznaczony cyfrą

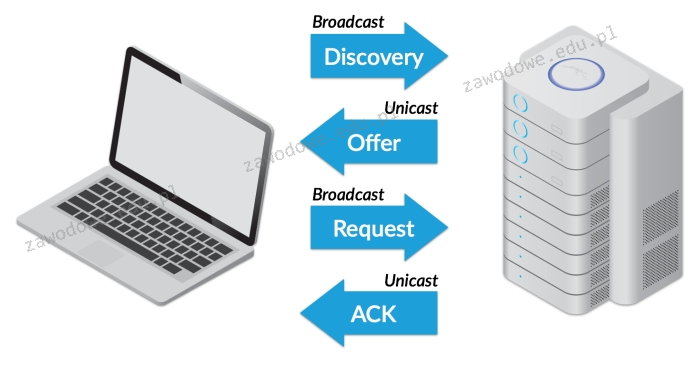

Którego protokołu działanie zostało zaprezentowane na diagramie?

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Symbol przedstawiony na ilustracji wskazuje na produkt

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na

Jakie urządzenie powinno być wykorzystane do pomiaru struktury połączeń w sieci lokalnej?

Dane dotyczące kont użytkowników w systemie Linux są przechowywane w pliku

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jaką usługę należy zainstalować na systemie Linux, aby umożliwić bezpieczny zdalny dostęp?

Element na karcie graficznej, który ma za zadanie przekształcenie cyfrowego sygnału wytwarzanego przez kartę na analogowy sygnał, zdolny do wyświetlenia na monitorze to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

Który z poniższych interfejsów powinien być wybrany do podłączenia dysku SSD do płyty głównej komputera stacjonarnego, aby uzyskać najwyższą szybkość zapisu oraz odczytu danych?

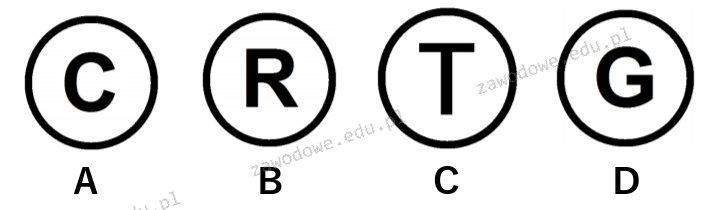

Który z symboli wskazuje na zastrzeżenie praw autorskich?

Aby naprawić uszkodzony sektor rozruchowy dysku w systemie Windows 7, należy użyć polecenia

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

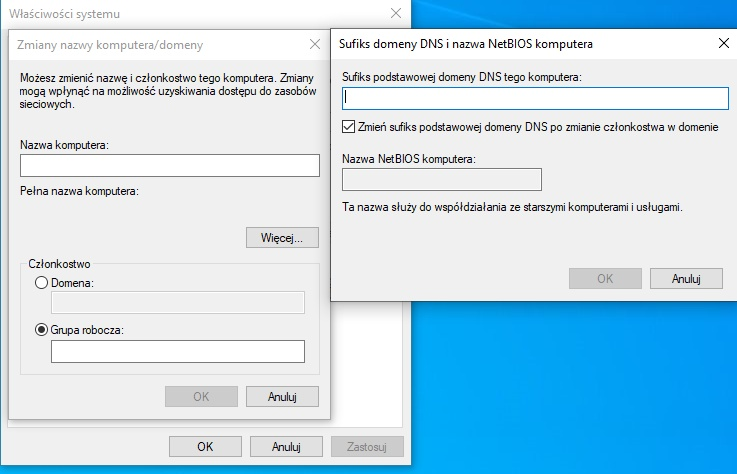

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

Do jakiego celu służy program fsck w systemie Linux?

Oprogramowanie, które często przerywa działanie przez wyświetlanie komunikatu o konieczności dokonania zapłaty, a które spowoduje zniknięcie tego komunikatu, jest dystrybuowane na podstawie licencji

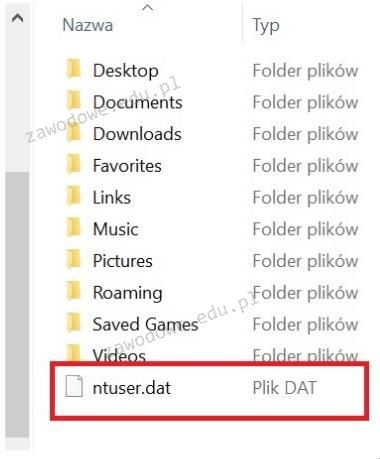

Aby zmienić profil na obowiązkowy, trzeba zmodyfikować rozszerzenie pliku ntuser.dat na

Jaką maksymalną prędkość danych można osiągnąć w sieci korzystającej z skrętki kategorii 5e?

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Określ zakres adresów IP z klasy A, który wykorzystywany jest do adresacji prywatnej w sieciach komputerowych?

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Protokół, który zajmuje się identyfikowaniem i usuwaniem kolizji w sieciach Ethernet, to

Jaki adres IP należy do urządzenia funkcjonującego w sieci 10.0.0.0/17?

Polecenie grep w systemie Linux pozwala na

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Skaner antywirusowy zidentyfikował niechciane oprogramowanie. Z opisu wynika, że jest to dialer, który pozostawiony w systemie

Wskaż poprawną kolejność czynności prowadzących do zamontowania procesora w gnieździe LGA na nowej płycie głównej, odłączonej od źródła zasilania.

| Nr czynności | Działanie |

|---|---|

| 1 | Odgięcie dźwigni i otwarcie klapki |

| 2 | Montaż układu chłodzącego |

| 3 | Zamknięcie klapki i dociśnięcie dźwigni |

| 4 | Podłączenie układu chłodzącego do zasilania |

| 5 | Lokalizacja gniazda procesora |

| 6 | Nałożenie pasty termoprzewodzącej |

| 7 | Włożenie procesora do gniazda |

Komputer, którego naprawa ma zostać przeprowadzona u klienta, nie reaguje na wciśnięcie przycisku POWER. Pierwszą czynnością harmonogramu prac związanych z lokalizacją i usunięciem tej usterki powinno być

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?