Pytanie 1

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Jakie polecenie w systemie Windows służy do analizowania ścieżki, jaką pokonują pakiety w sieci?

Jaką pamięć RAM można użyć z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, obsługującą maksymalnie 128GB, 4x PCI-E 16x, RAID, USB 3.1, S-2011-V3/ATX?

Jaki zakres grupy jest automatycznie przypisywany dla nowo stworzonej grupy w kontrolerze domeny systemu Windows Serwer?

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

Jakie urządzenie ilustruje zamieszczony rysunek?

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Użytkownik systemu Windows może logować się na każdym komputerze w sieci, korzystając z profilu, który jest przechowywany na serwerze i może być zmieniany przez użytkownika. Jak nazywa się ten profil?

Jak powinno być usytuowanie gniazd komputerowych RJ45 względem powierzchni biurowej zgodnie z normą PN-EN 50174?

W systemie działającym w trybie wielozadaniowości z wywłaszczeniem program, który zatrzymał się

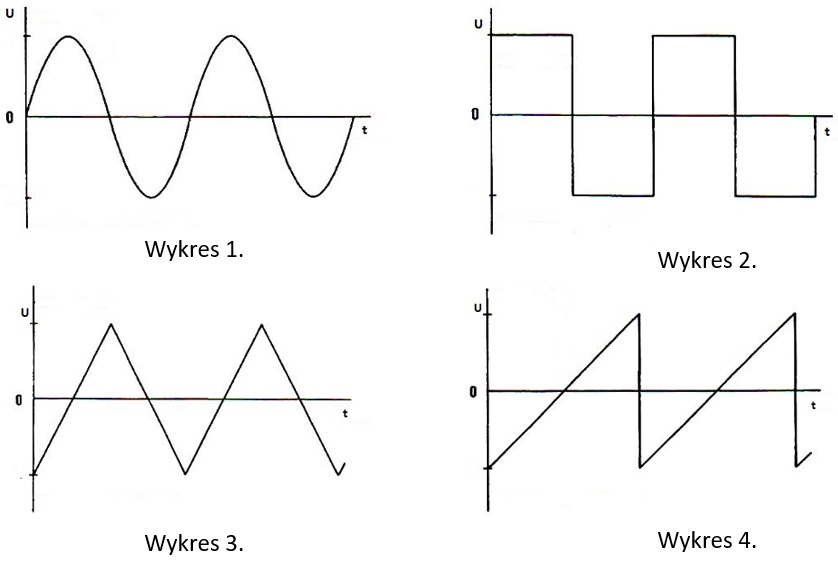

Na którym wykresie przedstawiono przebieg piłokształtny?

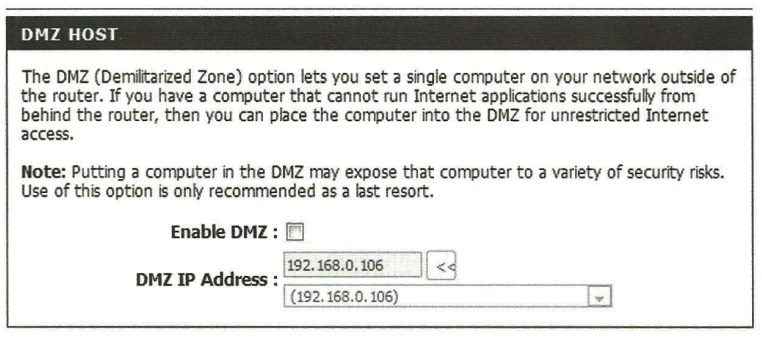

Na ilustracji zaprezentowano zrzut ekranu z ustawień DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer o adresie IP 192.168.0.106

Do czego służy oprogramowanie Microsoft Hyper-V?

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |

Który z protokołów zapewnia bezpieczne połączenie między klientem a witryną internetową banku, zachowując prywatność użytkownika?

Na ilustracji ukazano kartę

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

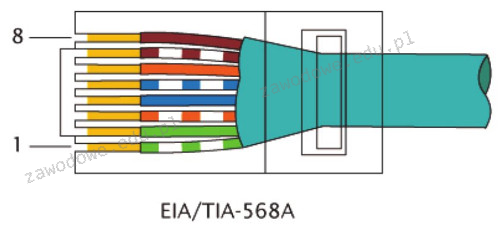

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

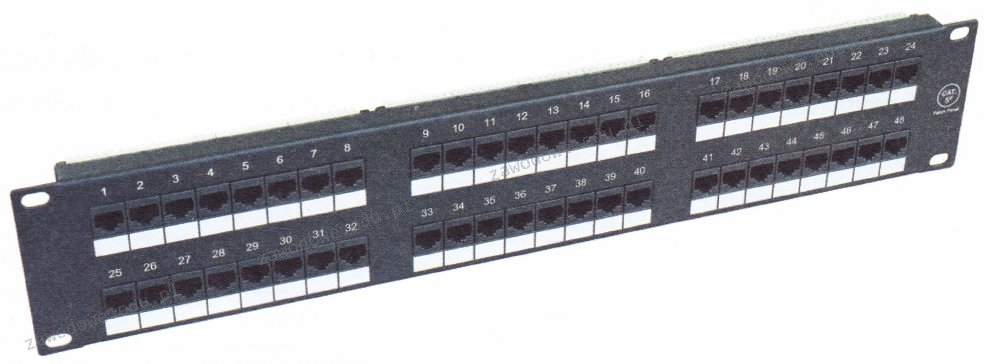

Na ilustracji widoczny jest

Standard IEEE 802.11b dotyczy sieci

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Wykonanie komendy dxdiag w systemie Windows pozwala na

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

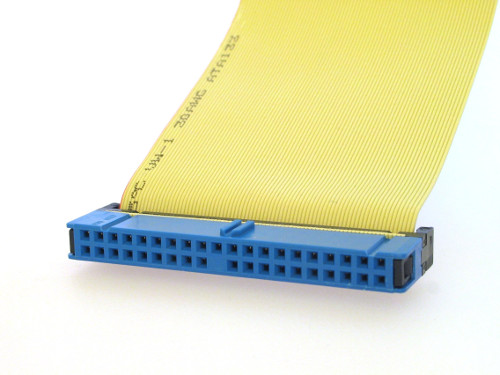

Na ilustracji pokazano wtyczkę taśmy kabel)

Program o nazwie dd, którego przykład zastosowania przedstawiono w systemie Linux, umożliwia

Które z urządzeń używanych w sieciach komputerowych nie modyfikuje liczby kolizyjnych domen?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Jakiego rodzaju adresację stosuje protokół IPv6?

Jak brzmi pełna wersja adresu IPv6 2001:0:db8::1410:80ab?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Protokół Datagramów Użytkownika (UDP) należy do kategorii

W technologii Ethernet, protokół CSMA/CD do dostępu do medium działa na zasadzie