Pytanie 1

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Włączenie systemu Windows w trybie debugowania umożliwia

Jakie zastosowanie ma polecenie md w systemie Windows?

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

Połączenia typu point-to-point, realizowane za pośrednictwem publicznej infrastruktury telekomunikacyjnej, oznacza się skrótem

Ile hostów można zaadresować w sieci o adresie 172.16.3.96/28?

Aby uniknąć różnic w kolorystyce pomiędzy zeskanowanymi zdjęciami na wyświetlaczu komputera a ich oryginałami, konieczne jest przeprowadzenie

Najefektywniejszym sposobem dodania skrótu do aplikacji na pulpitach wszystkich użytkowników w domenie będzie

W systemach Windows istnieje możliwość przypisania użytkownika do dowolnej grupy za pomocą panelu

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

Jaką maskę podsieci powinien mieć serwer DHCP, aby mógł przydzielić adresy IP dla 510 urządzeń w sieci o adresie 192.168.0.0?

Czym wyróżniają się procesory CISC?

Informacja tekstowa KB/Interface error, widoczna na wyświetlaczu komputera podczas BIOS POST od firmy AMI, wskazuje na problem

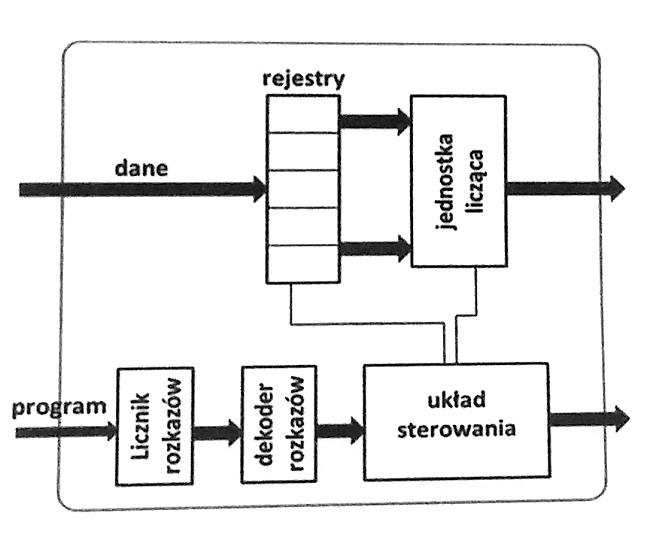

Rejestry przedstawione na diagramie procesora mają zadanie

DB-25 służy jako złącze

Jakie urządzenie sieciowe widnieje na ilustracji?

Zastosowanie programu Wireshark polega na

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

Jednym z rezultatów realizacji podanego polecenia jest

| sudo passwd -n 1 -x 5 test |

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Narzędzie pokazane na ilustracji jest używane do weryfikacji

Do sprawdzenia, czy zainstalowana karta graficzna komputera przegrzewa się, użytkownik może wykorzystać program

Uruchomienie systemu Windows w trybie debugowania pozwala na

Serwer WWW o otwartym kodzie źródłowym, który działa na różnych systemach operacyjnych, to

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Po wykonaniu podanego polecenia w systemie Windows:

net accounts /MINPWLEN:11liczba 11 zostanie przydzielona dla:

Podaj właściwe przyporządkowanie usługi z warstwy aplikacji oraz standardowego numeru portu, na którym ta usługa działa?

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

Aby chronić sieć Wi-Fi przed nieupoważnionym dostępem, należy m.in.

Wskaż adresy podsieci, które powstaną po podziale sieci o adresie 172.16.0.0/22 na 4 równe podsieci.

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

W systemie Linux, co oznacza znak "~" w ścieżce dostępu do plików?

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

Jakie właściwości posiada topologia fizyczna sieci opisana w ramce?

To narzędzie może być wykorzystane do