Pytanie 1

Sieci lokalne o architekturze klient-serwer cechują się tym, że

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Sieci lokalne o architekturze klient-serwer cechują się tym, że

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Instalacja systemów Linux oraz Windows 7 odbyła się bez żadnych problemów. Systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, przy tej samej specyfikacji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program

Impulsator pozwala na diagnozowanie uszkodzonych układów logicznych komputera między innymi poprzez

Jaką funkcjonalność oferuje program tar?

Który z protokołów służy do weryfikacji poprawności połączenia pomiędzy dwoma hostami?

Co robi polecenie Gpresult?

Jakie jest najbardziej typowe dla topologii gwiazdy?

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

W systemie Linux, co oznacza znak "~" w ścieżce dostępu do plików?

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Jakie porty powinny być odblokowane w ustawieniach firewalla na komputerze, na którym działa usługa serwera WWW?

Oprogramowanie, które często przerywa działanie przez wyświetlanie komunikatu o konieczności dokonania zapłaty, a które spowoduje zniknięcie tego komunikatu, jest dystrybuowane na podstawie licencji

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Jakie polecenie należy użyć w wierszu poleceń systemu Windows, aby utworzyć nowy katalog?

Litera S w protokole FTPS oznacza zabezpieczenie danych podczas ich przesyłania poprzez

Symbol graficzny przedstawiony na ilustracji oznacza jaką bramkę logiczną?

Okablowanie pionowe w systemie strukturalnym łączy się

Co oznacza skrót "DNS" w kontekście sieci komputerowych?

W specyfikacji technicznej płyty głównej znajduje się zapis Supports up to Athlon XP 3000+ processor. Co to oznacza w kontekście obsługi procesorów przez tę płytę główną?

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

Użycie trunkingowego połączenia między dwoma przełącznikami umożliwia

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

IMAP to protokół

W systemie NTFS do zmiany nazwy pliku konieczne jest posiadanie uprawnienia

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

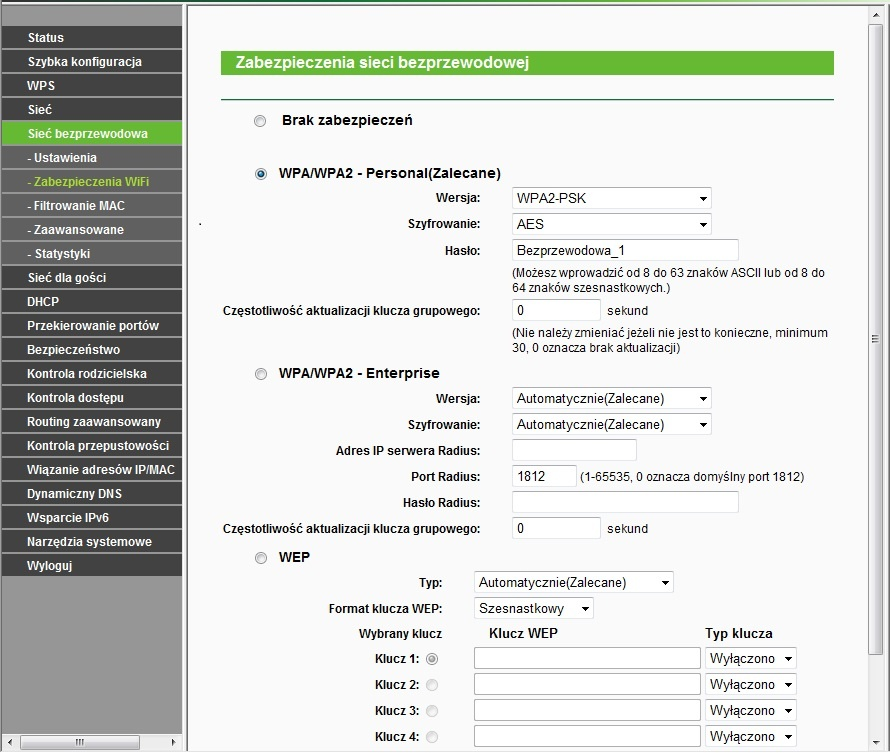

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum