Pytanie 1

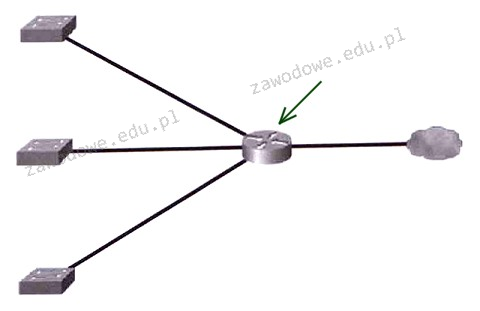

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jaki symbol urządzenia jest pokazany przez strzałkę na rysunku?

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

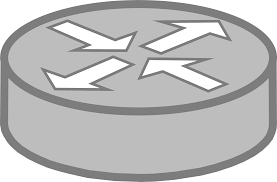

Jakie urządzenie sieciowe reprezentuje ten symbol graficzny?

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaka jest maska dla adresu IP 192.168.1.10/8?

W systemie Linux wykonanie polecenia chmod 321 start spowoduje przyznanie następujących uprawnień plikowi start:

Jakie polecenie uruchamia edytor polityk grup w systemach z rodziny Windows Server?

Który kolor żyły znajduje się w kablu skrętkowym?

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Aby zapewnić bezpieczną komunikację terminalową z serwerem, powinno się skorzystać z połączenia z użyciem protokołu

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Jak określić długość prefiksu adresu sieci w adresie IPv4?

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

W systemie Windows, aby założyć nową partycję podstawową, trzeba skorzystać z przystawki

Do wykonania obrazu dysku twardego można użyć programu

Jakie narzędzie pozwala na zarządzanie menadżerem rozruchu w systemach Windows od wersji Vista?

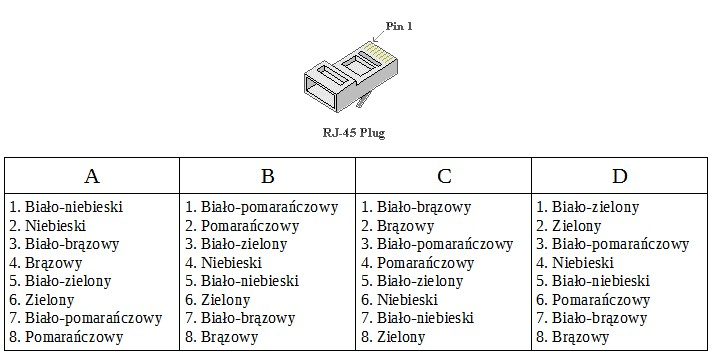

Jakie jest usytuowanie przewodów w złączu RJ45 według schematu T568A?

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Jakie medium transmisyjne w sieciach LAN zaleca się do użycia w budynkach zabytkowych?

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

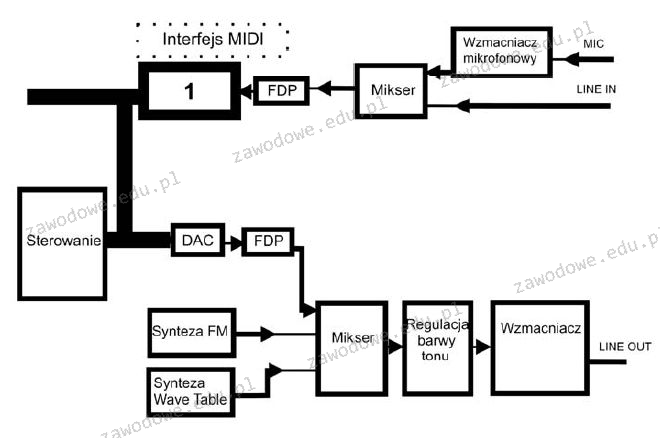

Schemat blokowy karty dźwiękowej jest przedstawiony na rysunku. Jaką rolę odgrywa układ oznaczony numerem 1?

Czym jest licencja OEM?

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

Podczas testowania kabla sieciowego zakończonego wtykami RJ45 przy użyciu diodowego testera okablowania, diody LED zapalały się w odpowiedniej kolejności, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły równocześnie na jednostce głównej testera, natomiast na jednostce zdalnej nie świeciły wcale. Jaka mogła być tego przyczyna?

Aby zabezpieczyć system przed atakami typu phishing, nie zaleca się

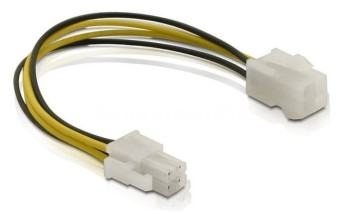

Wskaż złącze, które należy wykorzystać do podłączenia wentylatora, którego parametry przedstawiono w tabeli.

| Wymiar radiatora | 123 x 133 x 163 mm |

| Wentylator | 120 mm + 135 mm |

| Złącze | 4-pin PWM |

| Napięcie zasilające | 12V |

| Żywotność | 300 000h |

Początkowe znaki heksadecymalne adresu IPv6 przeznaczonego do link-local to

Na ilustracji pokazano interfejs w komputerze dedykowany do podłączenia

Na wydruku z drukarki laserowej występują jasne i ciemne fragmenty. Jakie działania należy podjąć, by poprawić jakość druku oraz usunąć problemy z nieciągłością?

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Co jest główną funkcją serwera DHCP w sieci komputerowej?

Na zdjęciu widać kartę

Jak nazywa się jednostka danych PDU w warstwie sieciowej modelu ISO/OSI?

Który z parametrów okablowania strukturalnego wskazuje na relację mocy sygnału testowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu przewodu?

Jakie urządzenie sieciowe widnieje na ilustracji?

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji