Pytanie 1

Zaprezentowane narzędzie jest wykorzystywane do

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Zaprezentowane narzędzie jest wykorzystywane do

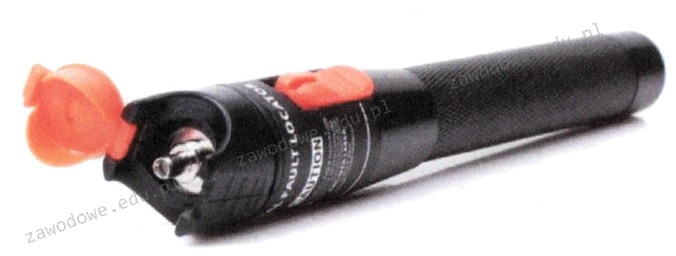

Zaprezentowany diagram ilustruje zasadę funkcjonowania

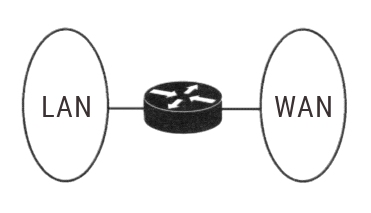

Jakie zadanie pełni router?

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Aby telefon VoIP działał poprawnie, należy skonfigurować adres

Główną rolą serwera FTP jest

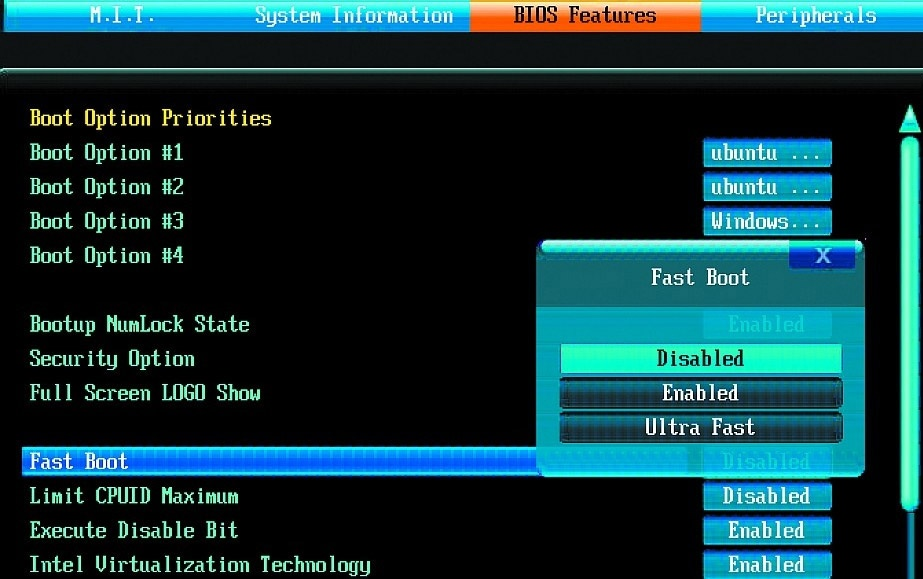

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

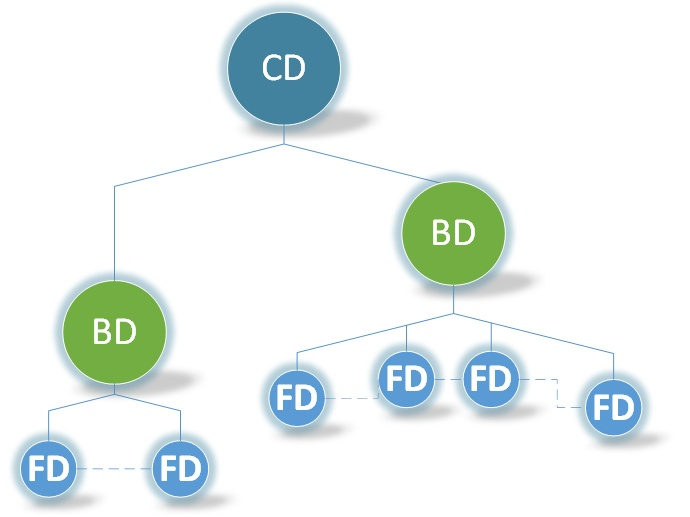

Strategia zapisywania kopii zapasowych ukazana na diagramie określana jest mianem

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

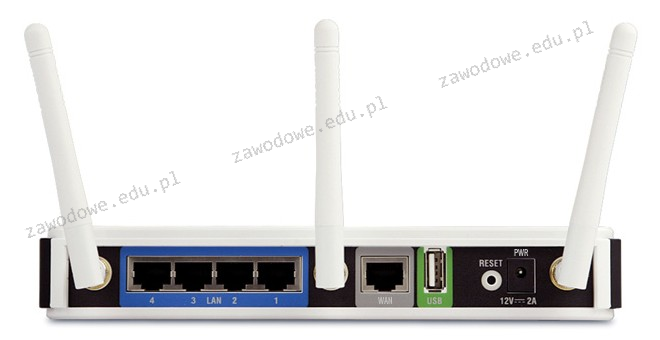

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Obudowa oraz wyświetlacz drukarki fotograficznej są mocno zabrudzone. Jakie środki należy zastosować, aby je oczyścić bez ryzyka uszkodzenia?

Osoba korzystająca z systemu operacyjnego Linux pragnie przypisać adres IP 152.168.1.200 255.255.0.0 do interfejsu sieciowego. Jakie polecenie powinna wydać, mając uprawnienia administratora?

Przedstawiony schemat sieci kampusowej zawiera

Jaki standard Ethernet należy wybrać przy bezpośrednim połączeniu urządzeń sieciowych, które dzieli odległość 1 km?

Aby przywrócić zgubione dane w systemach z rodziny Windows, konieczne jest użycie polecenia

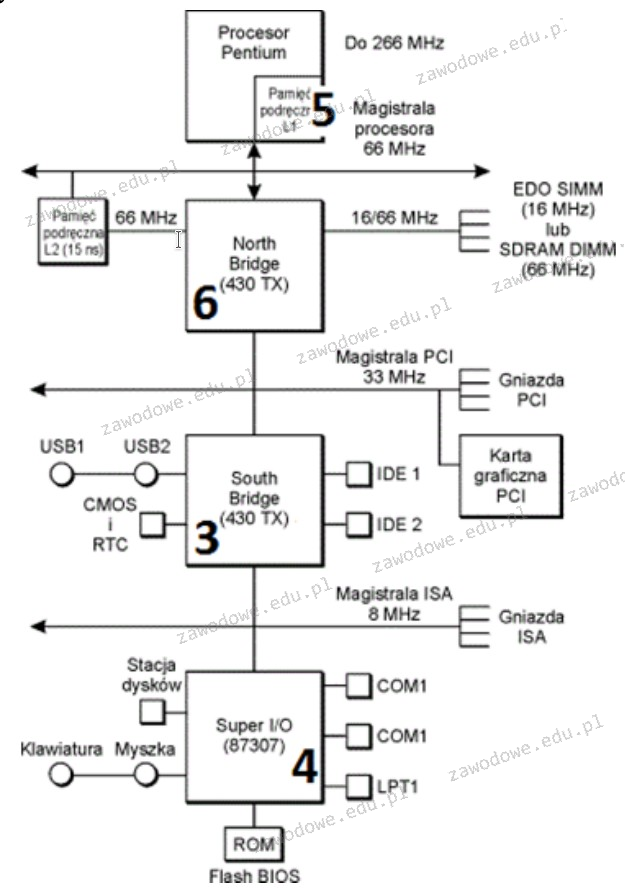

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

W systemie binarnym liczba 3FC7 będzie zapisana w formie:

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

Układy sekwencyjne stworzone z grupy przerzutników, najczęściej synchronicznych typu D, które mają na celu przechowywanie danych, to

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

W systemie Windows 7 aby skopiować folder c:\test wraz z jego podfolderami na dysk zewnętrzny f:\, należy zastosować polecenie

Przekształć liczbę dziesiętną 129(10) na reprezentację binarną.

Największą pojemność spośród nośników optycznych posiada płyta

Jakie urządzenie sieciowe zostało pokazane na diagramie sieciowym?

W którym katalogu w systemie Linux można znaleźć pliki zawierające dane o urządzeniach zainstalowanych w komputerze, na przykład pamięci RAM?

Wydanie w systemie Windows komendy ```ATTRIB -S +H TEST.TXT``` spowoduje

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest