Pytanie 1

Technik serwisowy zrealizował w ramach zlecenia działania wymienione w zestawieniu. Całkowity koszt zlecenia obejmuje cenę usług wymienionych w zestawieniu oraz wynagrodzenie serwisanta, którego stawka godzinowa wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

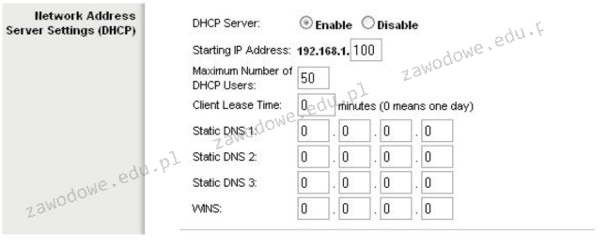

| 5. | Konfiguracja rutera | 30 | 20,00 |