Pytanie 1

Kiedy użytkownik wpisuje w przeglądarkę adres www.egzamin.pl, nie ma on możliwości otwarcia strony WWW, natomiast wpisujący adres 211.0.12.41 zyskuje dostęp do tej strony. Problem ten wynika z nieprawidłowej konfiguracji serwera

Wynik: 13/40 punktów (32,5%)

Wymagane minimum: 20 punktów (50%)

Kiedy użytkownik wpisuje w przeglądarkę adres www.egzamin.pl, nie ma on możliwości otwarcia strony WWW, natomiast wpisujący adres 211.0.12.41 zyskuje dostęp do tej strony. Problem ten wynika z nieprawidłowej konfiguracji serwera

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

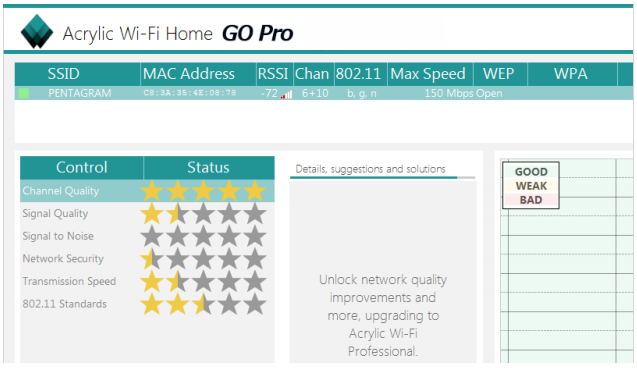

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

W systemie Windows harmonogram zadań umożliwia przydzielenie

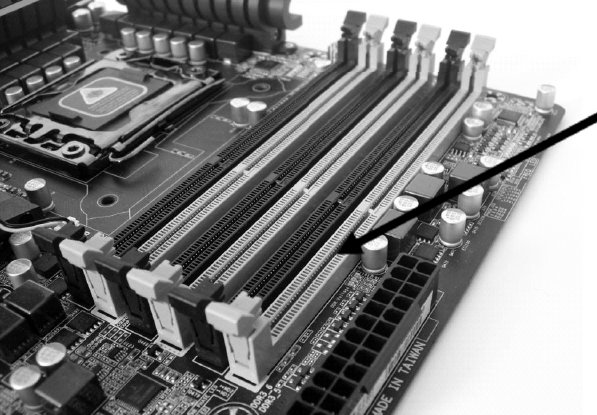

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Program, który ocenia wydajność zestawu komputerowego, to

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

Toner stanowi materiał eksploatacyjny w drukarce

Który element pasywny sieci powinien być użyty do połączenia okablowania ze wszystkich gniazd abonenckich z panelem krosowniczym umieszczonym w szafie rack?

Jakie polecenia należy zrealizować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

Transmisję danych w sposób bezprzewodowy umożliwia standard, który zawiera interfejs

W wyniku wydania polecenia: net user w konsoli systemu Windows, pojawi się

Najmniejszy czas dostępu charakteryzuje się

Który typ drukarki powinien być wykorzystany w dziale sprzedaży hurtowni materiałów budowlanych do tworzenia faktur na papierze samokopiującym, aby uzyskać kopie wydruku?

Który adres IPv4 odpowiada adresowi IPv6 ::1?

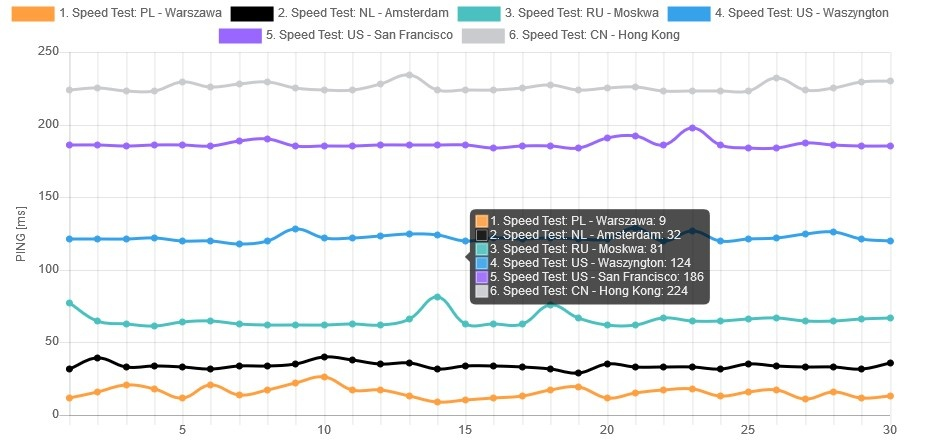

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Jakiego typu dane są przesyłane przez interfejs komputera osobistego, jak pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Aby uporządkować dane pliku na dysku twardym, zapisane w klastrach, które nie sąsiadują ze sobą, tak aby znajdowały się w sąsiadujących klastrach, należy przeprowadzić

Jakie polecenie należy zastosować w konsoli odzyskiwania systemu Windows, aby poprawić błędne zapisy w pliku boot.ini?

Podaj polecenie w systemie Linux, które umożliwia określenie aktualnego katalogu użytkownika.

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Zgodnie z normą EIA/TIA T568B, żyły pary odbiorczej w skrętce są pokryte izolatorem w kolorze

Jak nazywa się program, który pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym?

Na przedstawionym schemacie urządzeniem, które łączy komputery, jest

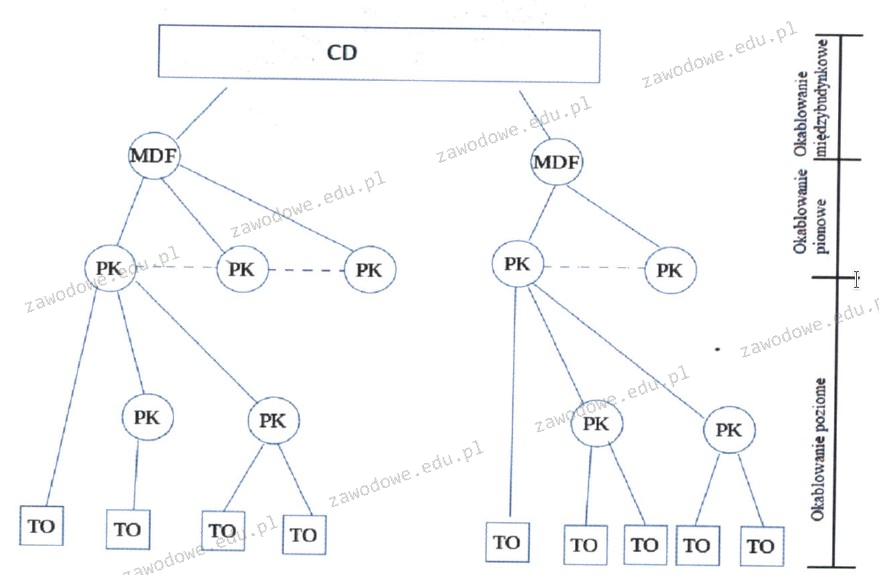

Na zaprezentowanym schemacie logicznym sieci przedstawiono

W systemie Windows dany użytkownik oraz wszystkie grupy, do których on przynależy, posiadają uprawnienia "odczyt" do folderu XYZ. Czy ten użytkownik będzie mógł zrealizować operacje

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wskaż program do składu publikacji

Administrator Active Directory w domenie firma.local pragnie skonfigurować mobilny profil dla wszystkich użytkowników. Ma on być przechowywany na serwerze serwer1, w folderze pliki, który jest udostępniony w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia opisane wymagania?

Dokumentacja końcowa zaprojektowanej sieci LAN powinna zawierać między innymi

Na podstawie przedstawionego na ilustracji okna aplikacji do monitorowania łącza internetowego można określić