Pytanie 1

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

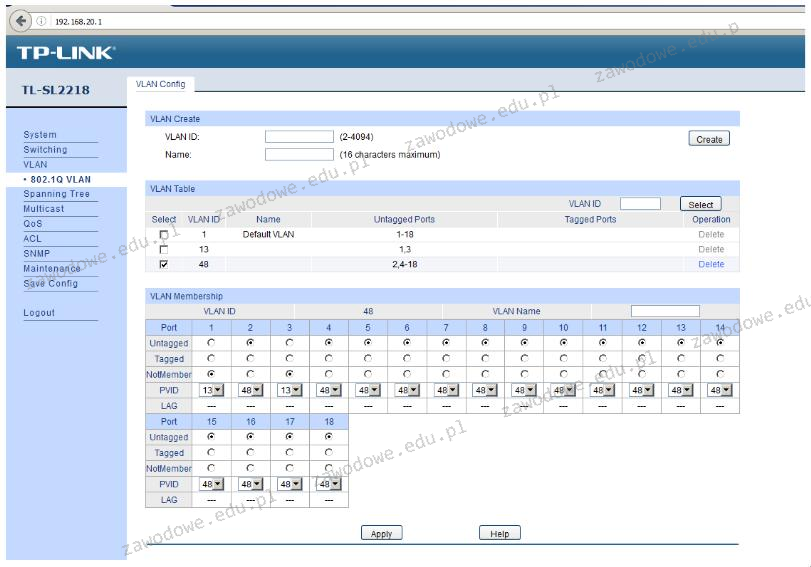

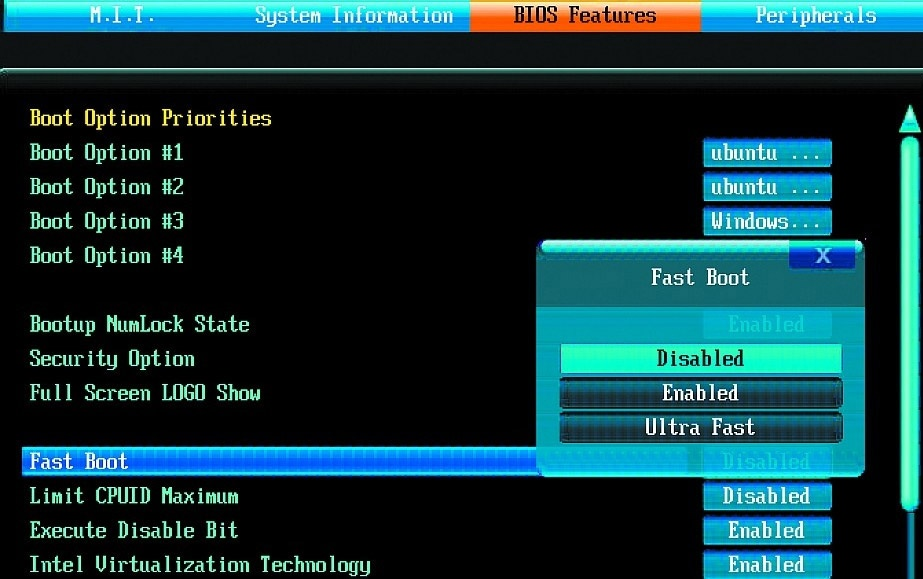

Na ilustracji zaprezentowano konfigurację urządzenia, co sugeruje, że

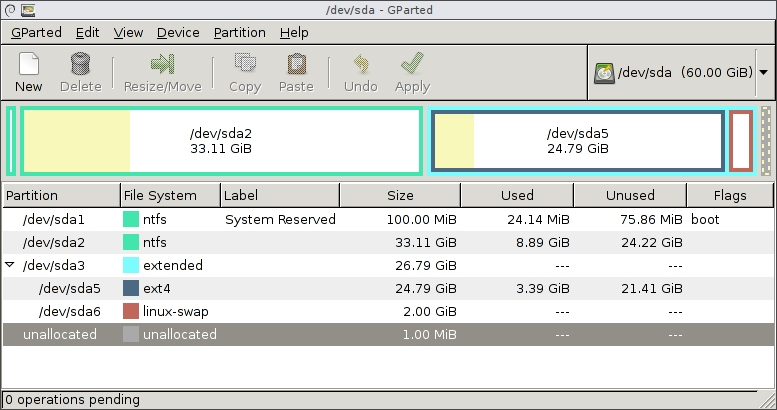

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

Atak informatyczny, który polega na wyłudzaniu wrażliwych danych osobowych poprzez udawanie zaufanej osoby lub instytucji, nazywamy

W hierarchicznym modelu sieci, komputery należące do użytkowników są składnikami warstwy

Wirus komputerowy to aplikacja, która

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

W celu konserwacji elementów z łożyskami oraz ślizgami w urządzeniach peryferyjnych wykorzystuje się

Jaką wartość w systemie szesnastkowym ma liczba 1101 0100 0111?

Napięcie dostarczane do poszczególnych elementów komputera w zasilaczu komputerowym w standardzie ATX jest zmniejszane z wartości 230V między innymi do wartości

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Według przedstawionego cennika, średni wydatek na zakup sprzętu do stanowiska komputerowego wynosi

Według normy PN-EN 50174 maksymalna długość trasy kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem rozdzielczym w panelu krosowym wynosi

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Posiadacz notebooka pragnie zainstalować w nim dodatkowy dysk twardy. Urządzenie ma jedynie jedną zatokę na HDD. Możliwością rozwiązania tego wyzwania może być użycie dysku z interfejsem

Wskaż właściwą formę maski podsieci?

Wydanie komendy chmod 400 nazwa_pliku w systemie Linux spowoduje, że właściciel pliku

Narzędziem stosowanym do osadzania w trudno dostępnych miejscach niewielkich rozmiarowo elementów, takich jak na przykład zworki, jest

Sprzęt, który umożliwia konfigurację sieci VLAN, to

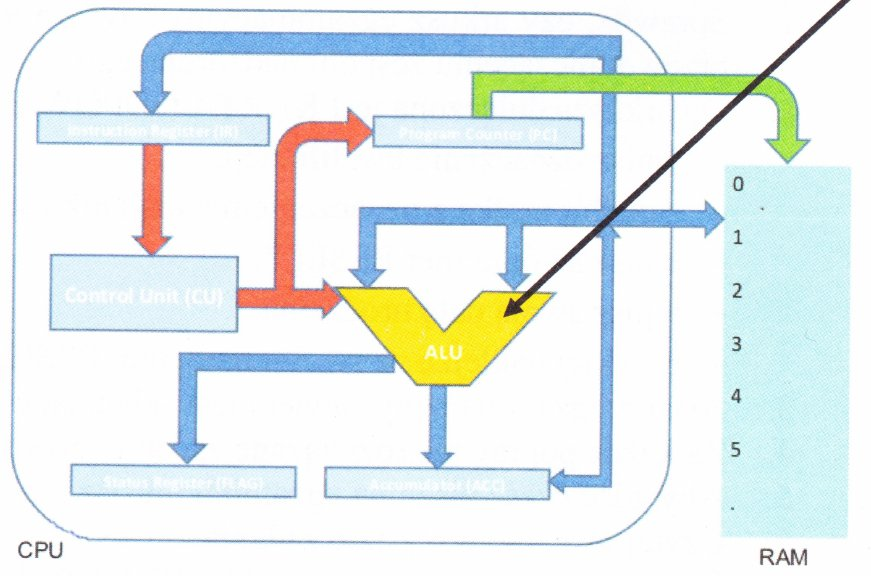

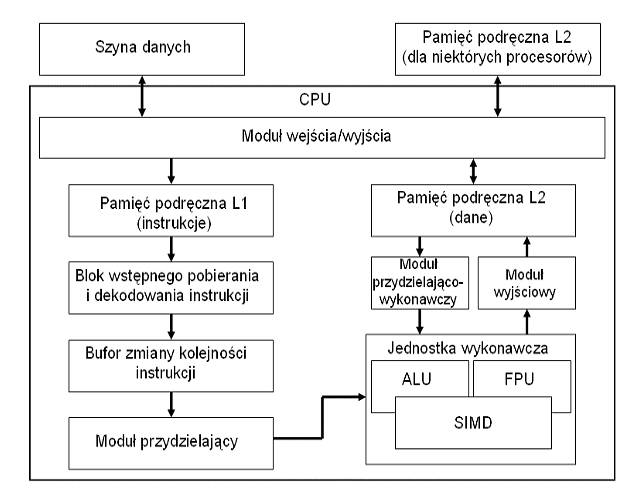

Na diagramie mikroprocesora zidentyfikowany strzałką blok odpowiada za

Jaką rolę należy przypisać serwerowi z rodziny Windows Server, aby mógł świadczyć usługi rutingu?

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

Do umożliwienia komunikacji pomiędzy sieciami VLAN, wykorzystuje się

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

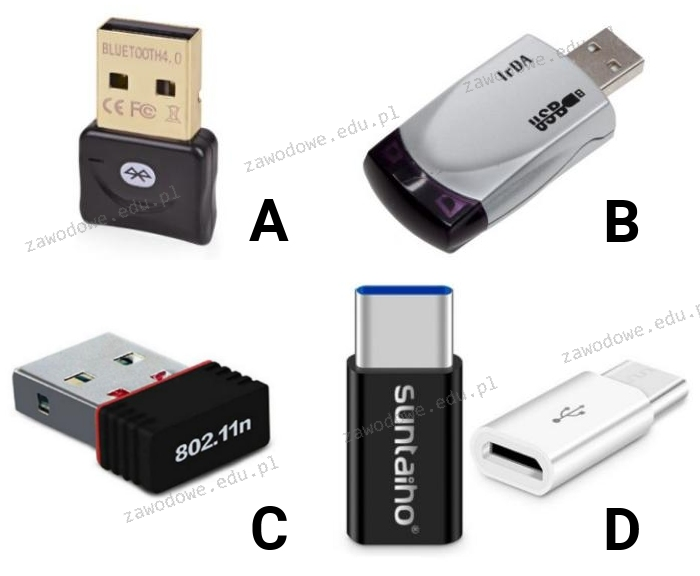

Jakie urządzenie powinno być użyte do podłączenia urządzenia peryferyjnego, które posiada bezprzewodowy interfejs do komunikacji wykorzystujący fale świetlne w podczerwieni, z laptopem, który nie jest w niego wyposażony, ale dysponuje interfejsem USB?

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Na diagramie blokowym procesora blok funkcjonalny oznaczony jako SIMD to

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Jakie polecenie służy do przeprowadzania aktualizacji systemu operacyjnego Linux korzystającego z baz RPM?

W systemie Windows 7 konfigurację interfejsu sieciowego można przeprowadzić, używając rozwinięcia polecenia

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |